Das Meckern an der Zukunft

BLOG: Gehirn & KI

Die Medien sprudeln nahezu vor Artikeln über künstliche Intelligenz, doch nur wenige Berichterstatter sind bereit, sich mit dem Thema tiefgehender zu beschäftigen. Was müssen wir tun, damit uns die Zukunft nicht davonläuft?

Den Roboter hat der Welt im Jahr 1920 mein tschechischer Landsmann Karel Capek geschenkt. In seinem Theaterstück „R.U.R – Rossums Universal Robots“. Während meiner Kindheit in den 60ern in der sozialistischen Tschechoslowakei stand Capeks Roboter auf einem Bücherbrett über meinem Bett. Ich bin mit Robotern aufgewachsen.

„Robot/Roboter“ leitet sich von dem slawischen Wort „robota“ für „Zwangsarbeit“. Deswegen war ich als kleiner Junge von Robotern so begeistert. Weil sie für uns arbeiten sollten.

Im Sozialismus hat man nur über Arbeit gesprochen. Im Fernsehen, in den Zeitungen, überall. Arbeit musste etwas ganz Schreckliches sein, dachte ich, wenn man darüber so viel sprechen musste. Wenn mich Erwachsene fragten, was ich denn sein möchte, wenn ich groß sei, ob Präsident, oder Kosmonaut oder zumindest Einstein, sagte ich immer, „Rentner“.

Jetzt können Roboter endlich dank Künstlicher Intelligenz (KI) für uns arbeiten. Und nicht nur das: Mit künstlicher Intelligenz haben wir zum ersten Mal eine große Chance bekommen, die Erde und uns vor uns selbst zu retten – bevor eine Klimakatastrophe eintritt oder eine globale Epidemie ausbricht, die uns alle auslöschen würde.

Doch statt dankbar für diese massive Erweiterung unserer Fähigkeiten zu sein, verbreiten wir Panik und meckern an künstlicher Intelligenz herum:

„Gefahr der Künstlichen Intelligenz: Kontrollverlust der Menschen“ (FAZ)

„Killerroboter & Co. Wie gefährlich ist Künstliche Intelligenz.“ (Tagesspiegel)

„Ein Terminator muss keine Hollywood-Fiktion bleiben“ (Welt)

„Künstliche Intelligenz als Herrschaftssystem in Europa?“ (europe direct)

„Warum künstliche Intelligenz uns 50 Jahre Schmerzen bringen könnte.“ (futurezone)

„Wird künstliche Intelligenz uns töten?“, fragt sich ein Buch gleich in seinem Titel.

Warum sollte sie aber?

Wenn es KIs geben würde, die gscheiter sind als wir Menschen, würden sie sofort die Erde verlassen und im Asteroiden-Gürtel Rohstoffe abbauen, sagte der KI-Pionier Sepp Hochreiter.

Warum sollten die KIs mit Menschen um Ressourcen kämpfen, die sie gar nicht brauchen? Was sollen Roboter auf einem Planeten tun, wo sie wegen des vielen Sauerstoffs und der Luftfeuchtigkeit vor sich hin rosten würden?

Roboter sind doch auch nur Menschen … ach, Quatsch! Das war nur ein Witz. Roboter sind eben keine Menschen. Ein Roboter hat kein Modul in seinem Gehirn, das sich unter Stress einschaltet und den Gehirnbesitzer anbrüllt:

Iss die ganze Torte!

Ein Bier geht noch!

Nimm Drogen!

Erschieße 500 Bisons an einem Tag!

Eine Maschine ist nie im Stress. Einer Maschine ist es vollkommen egal, wie eine andere Maschine oder ein Mensch aussieht. Ob der andere schwarz oder gelb ist, quadratisch oder langgezogen, ein Mann oder eine Frau oder etwas dazwischen – das ist einer Maschine meist völlig egal.

Solche Unterscheidungen macht eine Maschine nur dann, wenn der Mensch ihr diese eingepflanzt hat. Wenn der Mensch der Maschine einen mit Vorurteilen beladenen Datensatz zum Lernen gegeben hat. Als zum Beispiel die KI von Google schwarze Männer als Gorillas klassifizierte. Wer steckte dahinter? Selbstverständlich der Mensch!

Googles KI hatte lernen sollen, Objekte auf Bildern zu erkennen und zu unterscheiden: Man zeigte dem Programm einen Mann und sagte ihm: Das ist ein Mann! Tausende verschiedene Männer auf Tausenden Fotos hat das Programm so mit der Kennzeichnung „Mann“ gezeigt bekommen. Dasselbe bei Frauen und Sachen. Bis das Programm Männer und Frauen und Tiere und Sachen auch auf Bildern erkannte, die es noch nie gesehen hatte. Die Maschine hat gelernt, Objekte in Klassen einzuteilen. So funktioniert das sogenannte überwachte Lernen:

Auf dem folgenden Bild gibt es drei verschiedene Objekte. Können Sie sich die drei Objekte merken?

Wenn Sie jetzt richtig gelernt haben, sind Sie für die folgende Aufgabe gut gerüstet: Was sehen Sie auf dem folgenden Bild?

Haben Sie „Knoblauchfahne“ geantwortet? Das ist richtig. Gerade haben Sie überwacht gelernt. Nur hat Ihnen gereicht, einmal eine „Knoblauchfahne“ „erlebt“ zu haben, um jede andere Knoblauchfahne zu erkennen. 😊 Eine Maschine muss diese Fähigkeit an Tausenden von Bildern mit verschiedenen Knoblauchfahnen erlernen. Und hier hatten Googles KI-Trainer einen Fehler gemacht: Um der KI beizubringen, wie ein Mann aussehe, haben sie dem Programm nur Bilder von weißen Männern mit der Kennzeichnung „Mann“ vorgesetzt, keine von Schwarzafrikanern. Und so hat das Programm dann schwarze Männer als Gorillas klassifiziert.

Haben Sie „Knoblauchfahne“ geantwortet? Das ist richtig. Gerade haben Sie überwacht gelernt. Nur hat Ihnen gereicht, einmal eine „Knoblauchfahne“ „erlebt“ zu haben, um jede andere Knoblauchfahne zu erkennen. 😊 Eine Maschine muss diese Fähigkeit an Tausenden von Bildern mit verschiedenen Knoblauchfahnen erlernen. Und hier hatten Googles KI-Trainer einen Fehler gemacht: Um der KI beizubringen, wie ein Mann aussehe, haben sie dem Programm nur Bilder von weißen Männern mit der Kennzeichnung „Mann“ vorgesetzt, keine von Schwarzafrikanern. Und so hat das Programm dann schwarze Männer als Gorillas klassifiziert.

So wie eine solche KI meine Schwiegermutter als „Hexe“ bezeichnen würde, wenn ich die KI mit einem Datensatz mit lauter bösen Schwiegermüttern gefüttert hätte, ohne der KI zu zeigen, dass die meisten Schwiegermütter gütig wie Engel sind.

Die zweite wichtige Methode für das Anlernen der künstlichen neuronalen Netze heißt unbewachtes Lernen. Das sehen Sie an dem folgenden Bild des medizinischen Klassifikators. Der „Klassifikator“ bekommt eine Schüssel mit Organen und soll sie in zwei Klassen aufteilen. Ohne dass man – wie beim überwachten Lernen – die Organe für den „Klassifikator gekennzeichnet. Nur aufgrund der Beschaffenheit und des Aussehens der zwei Organe kann der Klassifikator diese in zwei verschiedene Klassen sortieren.

Medizinischer Klassifikator. Quelle – Wikimedia Commons – Autor – Mimooh.

Medizinischer Klassifikator. Quelle – Wikimedia Commons – Autor – Mimooh.

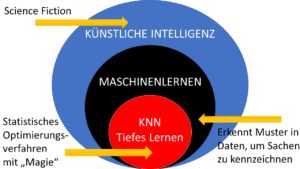

Jetzt müssen wir uns klar machen, was künstliche Intelligenz eigentlich ist: Science Fiction! Allgemeine künstliche Intelligenz, die wie ein Mensch denken könnte, gibt es nicht. Keine noch so gut trainierte heutige Maschine kann so etwas wie Bewusstsein, Gefühle oder den gesunden Menschenverstand entwickeln und zeigen. Wie meine Mutter, die sofort wusste, was Sache war, wenn ich ihr herauszureden versuchte, meine Lehrerin zu besuchen.

Es gibt keine starke künstliche Intelligenz. Nur Künstliche-Intelligenz-Forschung gibt es. Und eine Unterabteilung der KI-Forschung ist „Maschinenlernen“. Maschinen lernen, indem sie in großen Datensätzen Muster erkennen und Sachen kennzeichnen können.

Eine Unterabteilung des Maschinenlernens sind künstliche neuronalen Netze (KNN). Auf Englisch „artificial neural networks“ (ANN) genannt, manchmal auch „deep learning neural networks“ – auf Deutsch „tief lernende neuronalen Netze“.

Wenn Sie heutzutage über die Errungenschaften von künstlicher Intelligenz lesen, sind damit IMMER künstliche neuronale Netze gemeint. Sie sind jedoch wie gesagt keine künstliche Intelligenz im strengen Sinn sondern eine Unterabteilung der Künstliche-Intelligenz-Forschung. Kein Terminator oder Transformer, keine Matrix aus dem Internet, kein bösartiger Bordcomputer wie Hal 9000 aus Kubricks Film „2001: Odyssee im Weltraum“.

Künstliche neuronale Netze sind einfach statistische Optimierungsverfahren. Trotzdem mit Magie, weil sie nun mal Wundervolles leisten: Sie können in sehr großen Datensätzen, die ein Mensch nicht erfassen kann, Muster und Klassen und Cluster erkennen. Wenn auch ich in diesem Beitrag den Begriff „künstliche Intelligenz“ verwende, dann meine ich künstliche neuronalen Netze damit.

Jeden Tag erfahren wir, was künstliche Intelligenz alles kann: Augenkrankheiten aus den Augenscans besser erkennen als jeder Augenarzt. Auf Bildern von Tumoren entdeckt ein künstliches neuronales Netz für Menschen nicht wahrnehmbare winzige Merkmale und bestimmt daraus die Krebsart. Nur aufgrund dieser winzigen Merkmale kann das Programm schließen, welche Genstücke zu dem gegebenen Tumor führen. Selbstfahrende Autos werden von KNN gelenkt, genauso wie alle Roboter, die eine Aufgabe lernen können: Saltos zu schmeißen oder Sachen zu sortieren und vieles andere mehr.

Als kleiner Junge musste ich auf einem Gurkenbeet in unserem Garten Unkraut jäten. Statt Unkraut habe ich aber alle Gurkenpflanzen herausgerissen, weil ich sie von Unkraut nicht unterscheiden konnte. Anschließend zertrampelte ich auch die restlichen Gemüsebeete, nachdem mein Vater bei der Besichtigung des Gurkenbeets wie ein Wolf aufgeheult und mich mit seinem Hosengürtel in der Hand durch den Garten gejagt hatte. Hätte ich damals ein KI-Programm gehabt, hätten die Gurken keinen Schaden genommen. Und ich auch nicht.

Statt uns zu freuen, dass wir jetzt mit Hilfe der künstlichen neuronalen Netze sehr schnell Krankheiten diagnostizieren können und vieles andere mehr, meckern wir nur an künstlicher Intelligenz herum. Wir wissen ja aus vielen Hollywood-Filmen Bescheid, um uns ein Urteil über künstliche Intelligenz zu bilden. Mehr Bildung brauchen wir nicht.

Künstliche Intelligenz solle gefälligst ihre Entscheidungen erklären, sodass Menschen sie nachvollziehen können, schrieb die Süddeutsche Zeitung.

Das ist wie wenn ein Fußballer seinem Trainer erklären müsste, warum er gerade diese Art vom Elfmeter ins Tor geschossen habe. Dabei hatte der Fußballer nicht überlegt, sondern einfach geballert.

Wieso hast du in die linke Torhälfte geschossen?

Weil da frei war!

Woher wusstest du, dass der Torwart auf die andere Seite springt?

Das weiß man eben!

In dem gerade auf Deutsch erschienenen großartigen Buch „Machine Platform Crowd. Wie wir das Beste aus unserer digitalen Zukunft machen.“ erwähnen die Autoren Andrew McAfee und Erik Brynjolfsonn das sogenannte Polanyi-Paradoxon, das nach dem ungarisch-britischen Universalgelehrten Michael Polanyi benannt wurde:

Wir wissen mehr, als wir sagen können.

Unser Gehirn ist eine Überlagerung von Millionen, wenn nicht Milliarden, natürlicher neuronaler Netze, von denen jedes viel komplexer ist als ein einziges künstliches neuronales Netz mit seinen punktuellen Neuronen und den relativ einfachen mathematischen Algorithmen, nach denen es funktioniert.

Trotz der immensen Fähigkeiten unseres Gehirns treffen wir ständig Entscheidungen, die wir nicht begründen können: Ein Monster läuft mir auf der Straße entgegen. Ich sehe nur zerrissene und von Schlamm bedeckte Kleider und ein ganz verschlammtes Gesicht und weiß trotzdem sofort, dass es sich um meinen Sohn handelt, der in Schlammpfützen gespielt hat. Wie habe ich ihn so schnell erkannt, obwohl sein Gesicht ganz mit Schlamm bedeckt war? Ich weiß es nicht, ich weiß aber, es ist mein Sohn. Wetten wir?

Die natürlichen neuronalen Netze (Neuronenverbände) in unserem Gehirn können wunderbar Muster erkennen und Entscheidungen treffen, die wir nicht begründen können. Oft sagen wir „Intuition“ dazu und sind stolz darauf, wenn wir nur dank diesem Bauchgefühl Gutes erreichen oder Schlimmes verhindern können.

Von einem statistischen Optimierungsverfahren, von einem Programm also, das nach ein paar mathematischen Formeln läuft, verlangt aber eine angesehene Zeitung, seine Entscheidungen zu erklären. Ein künstliches neuronales Netz kann aber nichts erklären. Es kann nur einzelne Aufgaben lösen. Wenn wir Menschen etwas erklärt haben wollen, müssen wir das selbst tun. Indem wir zum Beispiel andere künstliche neuronale Netze entwerfen, welche die Arbeit und Entscheidungen der primären Netze analysieren.

Klar treffen künstliche neuronale Netze auch falsche Entscheidungen und führen zu Unfällen. Der letzte Crash des selbstfahrenden Autos der Google-Firma Waymo wurde aber auch von einem Menschen verursacht: Während der Wagen im autonomen Modus fuhr, schlief der menschliche Kontrollfahrer ein und berührte dabei aus Versehen mit dem Fuß das Gaspedal. Dadurch schaltete sich der autonome Modus aus, jetzt sollte der Kontroll-Fahrer die Steuerung des Wagens übernehmen, nur konnte er nicht, weil er schlief.

Hinter jedem trainierten künstlichen neuronalen Netz steckt ein von Menschen vorbereiteter Datensatz und ein menschlicher Programmierer. Auch aus diesem Grund werden KNN weiterhin falsche Entscheidungen treffen. Deswegen müssen ihre Entscheidungen geprüft werden, vor allem wenn ihre Folgen schwerwiegend sind.

Ist das aber ein Grund zur Häme? Zum Spott darüber, wie künstliche Intelligenz blöd sei? Ist das nicht normal, schwerwiegende Entscheidungen von anderen Instanzen zu überprüfen? Als mein Hausarzt, der zufälligerweise einen Chirurgen als besten Freund hatte, mich zu einer Blinddarm-OP drängte, habe ich zur Sicherheit einen Gastroenterologen konsultiert. Und so besitze ich 30 Jahre später meinen Blinddarm immer noch.

Beim direkten Vergleich der Entscheidungen von Mensch und Maschine und über die Neutralität ihrer Entscheidungen – wenn überhaupt verglichen werden kann -, schneidet die Maschine nahezu immer besser ab. Nach einer Studie von Shai Danzinger et al. fallen israelische Richter nach Essenspausen viel mildere Urteile als kurz vor Pausen, wenn sie einen niedrigen Blutzucker hatten. Solche Studien gibt es viele. („Machine Platform Crowd. Wie wir das beste aus unserer digitalen Zukunft machen.“) Eine Maschine hat nun mal keinen Blutzuckerspiegel, und nach Hautfarbe urteilt sie schon überhaupt nicht oder danach, wie hübsch jemand ist. Wenn wir der Maschine einen neutralen Datensatz zum Lernen geben.

Nahezu tragikomisch mutet die Bebilderung der Artikel über die KI in den Medien. Nicht nur das rote Auge vom Hal 9000 muss herhalten, auch viele Bilder von menschenähnlichen Robotern, samt Terminator. Damit die Leser über die Vermenschlichung von Robotern wettern können. Diesen unterschwelligen Warnungen vor der Vermenschlichung und der Gefahr der Maschinen kann man wirklich nur mit Humor begegnen wie die Autoren von „Machine Platform Crowd. Wie wir das Beste aus unserer digitalen Zukunft machen.“:

Im Verlauf dieses Buches werden wir immer wieder Technologien so beschreiben, als wären sie menschlich, als würde sie entscheiden, lernen, sehen können und so weiter. Das tun wir, weil wir denken, dass es die Vorgänge richtig beschreibt, auch wenn Computer nicht rational denken wie Menschen. Uns ist klar, dass diese Angewohnheit von einigen Leuten kritisiert wird, der Vorwurf lautet: „Man sollte Computer nicht zu sehr vermenschlichen – das hassen sie.“

Zum Glück gibt es Journalisten, die mit dem Thema künstliche Intelligenz entspannt aber sachlich umgehen: Marina Weisband hat sich Artikel über künstliche Intelligenz angeschaut und schreibt auf der Deutschlandfunk-Webseite:

Andere (Medienartikel) stellen die KI schon fast als weltumspannende, Menschen überlegene Omnipräsenz dar, die gottgleiche Schlüsse ziehen kann, die uns für immer verborgen bleiben würden. … Als Artikelbilder sieht man häufig Androiden, ein Hinweis auf die Vermenschlichung der Technik, oder das rote Auge des Computers „HAL9000“ aus dem Film „2001 A Space Odyssey“, der sich gegen den menschlichen Astronauten auflehnt. So werden unbewusst Assoziationen zu Skynet und anderen Gruselvisionen geschaffen, in denen die künstliche Intelligenz sich ihrer selbst bewusst wird und die Menschen als überflüssigen Ballast oder Fehler im System eliminiert.

Mit einem großen roten Auge des bösem Bordcomputers Hal 9000 bebilderte vor kurzem die Süddeutsche Zeitung ihren Artikel mit dem Titel ,,Keine Panik, es ist nur künstliche Intelligenz“:

Wenig versprechend, nennt die SZ die Anwendung der KI in der Krebstherapie, denn:

Eine KI (IBM Watson), die Vorschläge zur Krebstherapie machen sollte, musste von echten Ärzten unterstützt werden. 😊

So absurd ist das: Manche Medien verbreiten Panik, dass Menschen von Maschinen ersetzt werden. Wenn sich aber herausstellt, künstliche neuronale Netze sollen Menschen eben nicht ersetzen, sondern unsere Fähigkeiten erweitern, wird es dann hämisch als ein Makel der künstlichen Netze dargestellt.

Dieses Meckern an künstlicher Intelligenz geht im Artikel weiter, bis es in einem ganz lustigen Absatz mündet:

Die Alpha-Go-KI des Google-Projektes Deepmind kann das Brettspiel Go besser als jeder Mensch spielen, dafür kann sie aber ein belegtes Brot nicht von einem Vulkanausbruch unterscheiden.

Warum ein künstliches neuronales Netz auch belegte Brote von Vulkanausbrüchen unterscheiden sollte, obwohl es darauf trainiert wurde, das Brettspiel Go zu spielen, sagt der Autor nicht. Klar kann ein künstliches neuronales Netz immer nur auf eine Aufgabe hintrainiert werden. Ist es aber nicht Leistung genug, besser als jeder Mensch das hoch intuitive chinesische Brettspiel Go zu spielen? Muss das Programm noch belegte Brote von Vulkanausbrüchen unterscheiden, um die Anerkennung eines Journalisten zu finden?

Weiter schreibt der SZ-Autor:

Beide Programme sind “schwache” oder “enge” künstliche Intelligenzen, weil sie zwar über beeindruckende Fähigkeiten verfügen (für eine Maschine), diese sich jedoch auf ein sehr spezifisches, “enges” Anwendungsgebiet beschränken. Eben: Ein einziges, ganz bestimmtes Brettspiel spielen. Oder Katzen erkennen (Hunde aber dann wieder nicht).

Werter SZ-Autor: Es gibt auch künstliche neuronale Netze, die Katzen von Hunden und Elefanten und Giraffen und Menschen und Lastvagen und und und unterscheiden können. Das alles ist nur eine Sache des Trainings und der Frage: Was bringen wir der Maschine bei? Nur Katzen zu erkennen? Oder Katzen von Hunden zu unterscheiden? Oder was auch immer. Wenn ich mein Kind jahrelang fünf Stunden am Tag Klavier zu spielen zwinge, kritisiere ich es dann auch nicht, dass es nicht Fußball spielen kann.

Selbstverständlich birgt das neue Zeitalter der Menschen und Maschinen auch andere große Gefahren als falsche Entscheidungen: Für einen Menschen war es noch nie so leicht zu verblöden wie heute. Dass aber Maschinen immer „klüger“ werden und wir immer „dummer“, ist auch nur unsere Schuld. Maschinen sollen unsere Fähigkeiten erweitern, sie nicht verkümmern lassen. Das Zeitalter der Menschen und Maschinen fordert uns Menschen sehr. Wenn wir’s aber schaffen, Erkenntnis und Neugier und Freude für erstrebenswerter zu halten als Leistung und Konsum, sind wir den Maschinen immer einen Schritt voraus.

Während unserer Evolution hat sich unser Gehirn im Zusammenspiel mit unserer Motorik entwickelt. Zum Beispiel kann man den Hippocampus auch im Erwachsenenalter mit komplexen Bewegungen wie Tanzen oder Jonglieren wachsen lassen. Gleichzeitig ist der Hippocampus aber schlüsselhaft fürs Lernen und Gedächtnis. Je mehr und je kompliziertere Bewegungen wir ausführen, umso mehr trainieren wir also unser Hirn. Was sind die komplexen Bewegungen, die wir früher sehr oft ausführten und die gleichzeitig stark mit unserer visuellen Wahrnehmung gekoppelt sind, an der etwa 60 % Prozent der gesamten Großhirnrinde mitarbeiten?

Klar: Das Schreiben mit der Hand – das Zeichnen von Buchstabenbildern. Doch dieses wunderbare Hirntraining ersetzen wir mit zwei Daumen, die an einem Smartphone herumtippen, oder mit nur einem Zeigefinger bei den ganz Hartgesottenen. Statt zu lesen, was unser Gehirn ständig herausfordert – das Lesen ist eine kommunikative Tätigkeit -, konsumieren wir Serien bei Netflix und Amazon. Statt zu laufen, verbringen wir immer mehr Zeit in unseren SmartHomes. Statt Bewegung und Natur und Kunstgenuss draußen mit anderen Menschen gibt es HomeEntertaining auf Distanz.

Auch unser Bildungssystem muss sich ändern: Statt des Büffelns und Leistungszwangs sollten unsere Kinder Innovation und Kreativität lernen. Büffeln und Leistung bringen können Maschinen viel besser als wir. Wir Menschen können dagegen innovativ und kreativ sein. Alle Jobs, die automatisiert werden können, werden bald von Maschinen erledigt. Die innovativen und kreativen Jobs sicher nicht. Wie dieser:

Quelle: Flickr – Nathan Rupert

Keine Angst! Auch der Surflehrer für Hunde ist nur ein Witz. Der Rest ist aber ernst: Vielleicht wartet auf uns wirklich eine wunderbare Zukunft. Trotz Trump und Trolle im Netz und Fake News und Pseudowissenschaften und Menschen, denen es anscheinend nur daran liegt, Hass zu verbreiten und wissenschaftliche Tatsachen zu leugnen.

Wir müssen aber endlich aufhören, unsere eigene Zukunft zu bekämpfen. Heute geht es nicht mehr darum, ob wir in den KI-Zug steigen oder nicht – wir alle sitzen schon darin. Uns bleibt nichts anderes übrig, als zu lernen und uns zu informieren: über künstliche Intelligenz bzw. über künstliche neuronale Netze. Damit wir nicht auf der Strecke stecken bleiben. Damit es eine Zukunft für uns alle gibt.

Mit diesem Beitrag über künstliche Intelligenz hat Jaromir Konecny vor allem aufgezeigt wie der Mensch – und da vor allem die Subspecies Journalist – funktioniert und weniger wie Künstliche Intelligenz und wie neuronale Netze funktionieren.

Mein Eindruck ist, dass wir heute auf dem Gipfel eines Hypes sind, was künstliche Intelligenz und ihre Möglichkeiten angeht. Sollen Roboter tatsächlich dem Menschen einen Grossteil der Arbeit abnehmen und in die Rolle der früheren Hausdiener und Faktoten schlüpfen, dann müssen sie noch lernen, rational und mit Alltagsverstand zu denken. Davon sind sie jedoch heute noch weit entfernt. Der Roboter, der einen alten Herr oder eine alte Dame pflegt und sich ums sie kümmert, den gibt es noch nicht, ja es gibt nicht einmal einen Roboter als Hausdiener, dem man sagen kann: Ich gehe jetzt eine Woche in die Ferien und du schaust zum Haus, leerst den Briefkasten, schneidest den Rasen und bist freundlich zu den Nachbarn. Doch genau solche Roboter wären geradezu unendlich nützlich und würden alles ändern und verändern.

Martin Holzherr: “Mit diesem Beitrag über künstliche Intelligenz hat Jaromir Konecny vor allem aufgezeigt wie der Mensch – und da vor allem die Subspecies Journalist – funktioniert und weniger wie Künstliche Intelligenz und wie neuronale Netze funktionieren.”

Jaromir: 🙂 Ja, das war jetzt meine Absicht: mich “dem ganzen Rest” zu widmen – heißt doch mein Blog: “GEHIRN & KI – Hirnforschung, künstliche Intelligenz, Bewusstsein und der ganze Rest.” Angesichts der Flut der Berichte über KI in den Medien wollte ich dafür plädieren, uns mit künstlicher Intelligenz und künstlichen neuronalen Netzen etwas tiefgehender auseinanderzusetzen als wir das momentan tun, zumal wir über künstliche Intelligenz schreiben.

In meinem nächsten Blogbeitrag sind aber Computer Vision und konvolutionelle neuronale Netze dran – das verspreche ich hiermit. 🙂

Martin Holzherr: “Sollen Roboter tatsächlich dem Menschen einen Grossteil der Arbeit abnehmen und in die Rolle der früheren Hausdiener und Faktoten schlüpfen, dann müssen sie noch lernen, rational und mit Alltagsverstand zu denken.”

Jaromir: Ich hoffe, dass die Absicht meines Textes klar ist: Eigentlich wollte ich auch zeigen, dass künstliche neuronale Netze (KNN) schon jetzt Erstaunliches leisten. Dass unser Leben und Arbeitsleben in den kommenden Jahren ganz umgekrempelt wird, auch wenn KNN noch nicht in der Lage sind, “mit Alltagsverstand zu denken”, wie Sie schreiben. Sie sind trotzdem schon jetzt so nützlich, dass wir mit ihrer Hilfe unsere Zukunft ganz neu gestalten können. Wenn wir uns für dieses Neue öffnen – zum Besseren.

Meiner Meinung nach sind Roboter und Hausdiener nur ein sehr kleiner Teil der allgemeinen Automatisierung, die auf uns in den kommenden Jahren wartet. Wenn man zum Beispiel bedenkt, dass Google mit der ersten Flotte von autonomen Taxis in einer Stadt startet, kann man vielleicht erfassen, in welchen Zugzwang damit die ganze Autobranche kommt. Viele kluge Menschen denken, dass unsere kleinen Kinder keinen Führerschein mehr brauchen würden und es bald keine Autos im Privatbesitz geben werde. Schon dieses eine Aspekt der KI-Technologie – das autonome Fahren – wird auf unsere Kultur extreme Auswirkungen haben, kann aber auch entscheidend zur Rettung unseres Klimas beitragen. Wir sollten wirklich versuchen, etwas breiter zu denken und Sachen zu vernetzen.

Die URSACHE aller Probleme unseres “Zusammenlebens”, ist der nun “freiheitliche” WETTBEWERB um imperialistisch-faschistischen Kommunikationsmüll.

Solange Mensch also den Sinn des Lebens im Wettbewerb verunstaltet, also ein vernunftbegabtes Leben OHNE … nicht zustande bringt, sollte Mensch die Finger von KI lassen – meine Güte, wenn ich mir so vorstelle was Roboterpolizei … 😖

hto: Die URSACHE aller Probleme unseres “Zusammenlebens”, ist der nun “freiheitliche” WETTBEWERB um imperialistisch-faschistischen Kommunikationsmüll.

Solange Mensch also den Sinn des Lebens im Wettbewerb verunstaltet, also ein vernunftbegabtes Leben OHNE … nicht zustande bringt, sollte Mensch die Finger von KI lassen – meine Güte, wenn ich mir so vorstelle was Roboterpolizei … 😖

Jaromir: Ich glaube, viele Probleme werden auch dadurch verursacht, dass Kommentare zu Artikeln viel schneller geschrieben werden können als die entsprechenden Artikel gelesen. 🙂

@ Jaromir Konecny (Zitat): Viele kluge Menschen denken, dass unsere kleinen Kinder keinen Führerschein mehr brauchen würden und es bald keine Autos im Privatbesitz geben werde.

Ja, das stimmt. Allein schon selbstfahrende Fahrzeuge könnten die Art wie wir uns fortbewegen radikal ändern. Die radikalste Änderung läuft unter dem Begriff Mobility as a Service. Privatfahrzeuge verschwinden in dieser Zukunftsvision und werden ersetzt durch einen Schwarm von jederzeit verfügbaren und geteilt benutzten Fahrzeugen. Jeder, der irgendwo hin will, tippt auf dem Smartphon sein Ziel ein und es erscheinent eine Liste von in der Nähe bereitstehenden Fahrzeugen, die einen ans Ziel bringen, wobei man die Fahrzeuge mit 6 bis 20 anderen Insassen teilt, sodass gemäss einer Vision von Fujitsu schon im Jahre 2030 solcherart Fahrzeuge zu 50% auf der Strasse unterwegs sein werden, während heutige Autos nur zu 5% auf der Strasse unterwegs sind und den Rest in irgend einer Garage stehen. Staus werden dann fast völlig verschwinden (Zitata aus Mobility-as-a-Service 2030 Shared Cars MaaS to Reach 50%, übersetzt von DeepL): “Wir beginnen, die Entstehung einer technologiegeleiteten digitalen Transformation zu beobachten, bei der sich die Kaufgewohnheiten der Verbraucher vom Must-Have-Auto auf das gemeinsame mobile Gerät mit Transportoptionen verlagern. Da intelligente Mobilität immer reifer wird, müssen MaaS-Anbieter innovative Wege finden, um die Nutzung ihrer autonomen Flotten zu maximieren, die über die Bereitstellung von Passagierdiensten hinausgehen, indem sie in Bereiche wie Paketzustellung und Umweltdienstleistungen expandieren”, sagte Paul Warburton, Global Head of Automotive bei Fujitsu America, Inc. “Der Erfolg eines MaaS-Anbieters wird davon abhängen, wie viel Auslastung er durch seine barrierefreie Flotte erzielen kann, welchen Wert er bieten kann und wie agil er ist, die sich entwickelnden Anforderungen einer modernen Befriedigungsgesellschaft zu erfüllen. Wenn Autofirmen diese digitale Transformation anführen wollen, müssen sie sich schnell umstellen und bereit sein, das Automobil als Basistechnologie zu sehen und nicht als das primäre Leistungsversprechen, wie es bisher war.”

Laut Frost & Sullivan könnten jährlich mehr als 20 Millionen Fahrzeuge aufgrund des Wachstums neuer Mobilitätsdienste von der Straße genommen werden.

War es nicht so, dass die Kernspaltung eine verheißungsvolle Möglichkeit zur Energieerzeugung war – was macht das Militär schon jetzt mit KI? 😵

Eine kleine Differenzierung klärt auf, was unter Künstlicher Intelligenz zu verstehen ist.

Bei der Automation wird eine Maschine optimiert. Die Maschine Automobil bekommt eine Servolenkung, einen Bremskraftverstärker, einen automatischen Licht ein-und Ausschalter.

einen Bordcomputer. Bei der Automation wird die Maschine gesteuert und optimiert.

Bei der künstlichen Intelligenz wird der Mensch gesteuert und optimiert. Der Mensch wird nachgeahmt und ihm wird “vorausgedacht”.

Wenn ich heute bei einem KFZ-Händler ein neues Auto anschaue und am nächsten Morgen ein E-Mail von einer Bank bekomme, in dem mir ein Kredit angeboten wird, dann ist hier schon KI im Spiel.

Wenn mein Handy sich meldet, wenn ich die Grenze zur Schweiz überschritten habe, dann gehört das auch schon zum thema KI.

KI hat also viel mit Supervision zu tun. Und wenn wir einem Sprachcomputer auch noch einen Vorrat mit Ironie und Witz mitgeben, dann wird uns die KI sogar sympatisch.

Dann wird es auch die ersten Menschen geben, die sich in KI verlieben ! Gibts da noch etwas zum Meckern ?

Achtung: Diese Mitteilung wurde von eine KI verfasst.

Ergänzung zu Mobility as a Service: Eine eingängige, scheinbar nur mit Vorteilen behaftete Vision wie Mobility as a Service kann an ganz einfachen Dingen scheitern – an Dingen wie etwa der fehlenden Sicherheit. Grund: Im Prinzip ist Mobility as a Service fast das gleiche wie das Unterwegssein mit dem öffentlichen Verkehr und dem Taxi – nur mit dem Unterschied, dass es bei Mobility as a Service anstatt einen Taxi- oder Busfahrer nur das selbstfahrende Fahrzeug gibt. Doch der Taxi- oder Busfahrer ist eben mehr als nur ein Fahrer. Er garantiert auch für eine mimimale Sicherheit. Wer als Fahrgast randaliert oder gewalttätig wird, der wird vom Taxi-oder Busfahrer zurechtgewiesen oder dieser ruft gar die Polizei. Selbstfahrende Fahrzeuge müssten diese Autoritätsrolle des Fahrzeugfahrers ebenfalls übernehmen – beispielsweise über eine eingebaute Innenraumkamera, deren Bilder an eine Zentrale geleitet werden um bei Bedarf intervenieren zu können. Denn wie es heute Taschendiebe gibt, die auf Diebstahl im Bus oder Zug spezialisiert sind, wird es morgen Kriminielle geben, die Fahrgäste in autonomen Fahrzeugen als Zielgruppe haben.

Ja, mit KI und Robotics ist eine paradiesische Zukunft möglich. Konecny hat völlig recht: Ki ist das, was wir daraus machen!

Er vergisst aber, wie derzeit die gesamte KI-Diskussion die entscheidende Frage: Wer ist da “wir”? wer “macht”? und wer steuert und kontrolliert?

Das aber entscheidet, ob KI gut oder böse ist/sein wird, das ist/wird sie nun mal nicht von selbst! Das Fragen stellen und das Nachdenken darüber sollte nun mal endlich losgehen.

L. Bergmann: “Ja, mit KI und Robotics ist eine paradiesische Zukunft möglich. Konecny hat völlig recht: Ki ist das, was wir daraus machen! Er vergisst aber, wie derzeit die gesamte KI-Diskussion die entscheidende Frage: Wer ist da “wir”? wer “macht”? und wer steuert und kontrolliert? Das aber entscheidet, ob KI gut oder böse ist/sein wird, das ist/wird sie nun mal nicht von selbst! Das Fragen stellen und das Nachdenken darüber sollte nun mal endlich losgehen.

Jaromir: Das ist eine sehr wichtige Anmerkung. Wer da “wir” ist, vergesse ich aber nicht. Deswegen plädiere ich ja im Text dafür, dass wir uns alle damit auseinandersetzen, was künstliche Intelligenz eigentlich ist – was ist das, was heute in den Medien als künstliche Intelligenz bezeichnet wird? Denn nur wenn wir verstehen, können wir teilhaben. Nur dann wird das “wir” nicht wieder zum “sie” verkümmern, zu denen, die von künstlichen neuronalen Netzen profitieren. Zum Beispiel die Milliardäre, die dank den künstlichen neuronalen Netzen noch “milliardärer” werden.

“Naja” hierzu :

AI ist sozusagen in der Realwelt funktionierende Logik (“Sprachlichkeit”), sie kann, wenn sie ihre Regelmengen eigenständig ändert, auch böse werden, pardon, “böse” werden, die doppelten Anführungszeichen meinen das Einziehen einer neuen Abstraktionsebene.

Also ganz so optimistisch und fröhlich sieht Dr. W diese Entwicklung nicht.

Mag allerdings oft populärwissenschaftlich skizzierte Horrorszenarien ebenfalls nicht.

Zu diesem kleinen nicht erforderlichen Exkurs – ‘Trotz Trump und Trolle im Netz und Fake News und Pseudowissenschaften und Menschen, denen es anscheinend nur daran liegt, Hass zu verbreiten und wissenschaftliche Tatsachen zu leugnen.’ – setzt Dr. W gerne noch einen kleinen Minuspunkt.

Donald J. Trump wird oft (auch : absichtlich) missverstanden, er deckt halt in den Staaten das legitime konservative politische Spektrum ab.

Er ist zudem moderat, verständig und unterhaltsam – kann auch reden.

Es darf mit Frau Dr. Angela Dorothea Merkel verglichen werden.

MFG

Dr. Webbaer

Dr. Webbaer: “Zu diesem kleinen nicht erforderlichen Exkurs – ‘Trotz Trump und Trolle im Netz und Fake News und Pseudowissenschaften und Menschen, denen es anscheinend nur daran liegt, Hass zu verbreiten und wissenschaftliche Tatsachen zu leugnen.’ – setzt Dr. W gerne noch einen kleinen Minuspunkt.

Donald J. Trump wird oft (auch : absichtlich) missverstanden, er deckt halt in den Staaten das legitime konservative politische Spektrum ab.

Er ist zudem moderat, verständig und unterhaltsam – kann auch reden.”

Jaromir: Sind also Trumps Hasstiraden und Lügen nur biblische Botschaften, deren Symbolik wir erst entschlüsseln müssen, wenn wir uns mit Trump auseinandersetzen wollen?

Die “Washington Post” konnte Ende August etwa 4.300 von Trumps Behauptungen aus seiner Amtszeit als Präsident mit Hilfe von Fakten als falsch oder irreführend entlarven. Man muss aber keine Berichte in den Medien lesen, um Trump zu deuten, oder zu “missverstehen” wie Sie schreiben, dazu reichen Trumps eigene Tweets. Haben Sie diese gelesen?

Es wäre wohl ein Märchen aus Tausend und einer Nacht wenn die künstlichen neuronalen Netze nur zum Wohle der Menschheit arbeiten würden.Sicher ,ganz sicher,werden sie wohl auch Eingang finden in der Rüstungsindustrie bzw. in modernster Waffentechnik.So könnten künstliche neuronale Netze gegen andere künstliche neuronale Netze kämpfen,programmiert von perversen Wut und Hassgefühlen natürlicher neuronaler Netze(Menschen).Wie bei jeder technischen Erfindung werden

die Militärs auch hier,unterstützt von staatlichen Steuergeldern, neue Varianten menschlicher Vernichtung durchspielen(Siehe Kernspaltung und Atombombe).Oder ?

Golzower: “Es wäre wohl ein Märchen aus Tausend und einer Nacht wenn die künstlichen neuronalen Netze nur zum Wohle der Menschheit arbeiten würden.Sicher ,ganz sicher,werden sie wohl auch Eingang finden in der Rüstungsindustrie bzw. in modernster Waffentechnik.”

Jaromir: Da haben Sie vollkommen recht. Deswegen habe ich meinen Blogbeitrag auch geschrieben: Damit wir uns endlich tiefgehend damit auseinandersetzen, was das mediale Schlagwort “künstliche Intelligenz” eigentlich bedeutet. Denn vieles, was in den Medien steht, geht an der Sache völlig vorbei. Bei unseren künstlichen neuronalen Netzen müssen wir uns nicht vor Hal 9000 und auch nicht vor der KI-Frau aus “Ex Machina” fürchten, davor aber schon, dass mit Hilfe von künstlichen neuronalen Netzen (KNN) autonome Waffen gebaut werden, die uns durch unsere Städte jagen können. Nicht jedoch im eigenen Auftrag, wie uns viele Berichte einzureden versuchen, sondern im Auftrag von anderen Menschen.

Auch diejenigen, die nicht wie ich denken, KNN könnten uns helfen, doch noch uns und die Erde zu retten, müssten eigentlich wissen, dass man die Erforschung und Anwendung der KNN nicht stoppen kann. KNN können von jedem Schüler programmiert werden, sogar von mir :-). Auch das Programmieren kann man sich sparen und sich KNN-mäßig auf KI-Plattformen von Google, Amazon, IBM, Microsoft u. v. a. austoben, indem man aus den dort bereitgestellten Programmen und mit der Rechenpower aus der Cloud diverse KI-Anwendungen bastelt.

Was den Missbrauch von Erfindungen angeht, um Waffen herzustellen, müssen wir nicht einmal die Atomkraft anführen. Schon das Rad wurde von Menschen kurz nach seiner Erfindung dafür missbraucht, Kriegsfahrzeuge zu bauen. Von dem Hammer oder Messer gar nicht zu reden. Hätten wir dann gar nichts erfinden sollen?

Ich bin tiefst davon überzeugt, dass fast 8 Milliarden Menschen auf der Erde nur dank unseres Erfindungsgeistes überleben können, ohne sich die Köpfe bis in unsere totale Auslöschung einzuschlagen. Dass uns unsere Erfindungen und der Umgang mit ihnen zu etwas Besserem gemacht haben, als wir vor Tausenden Jahren wahren: Zum Beispiel Bücher! Auch die Schrift und der Buchdruck mussten erfunden werden.

Ich plädiere doch dafür, dass wir uns alle mit dem Thema tiefer und vor allem sachlicher auseinandersetzen, das unsere Zukunft prägen wird. Damit KNN für uns und nicht gegen uns eingesetzt werden. Wenn wir uns damit nicht auseinandersetzen, werden wir von KNN nicht profitieren, sondern an ihnen leiden.

Bonuskommenatar hierzu :

+

Dr. Webbaer: “Nie war es heutzutage leichter nicht zu verblöden, wie zuvor.

Dr. W ist schon lange im Geschäft, erinnert sich gerne wie seinerzeit (s um 1968 herum) i.p. Wissen vom einigen von Hegemonie gesprochen, wie geschrieben worden ist.”

Jaromir: Klar hat der Mensch heutzutage viel mehr Möglichkeiten, sich zu bilden und sein Gehirn zu schärfen als früher. Schon das ganze Angebot an Kursen im Netz, zum Programmieren, zur Data Science und zum Maschinellen Lernen ist wunderbar. Doch dass diese Möglichkeiten nicht von allen genutzt werden und immer mehr “konsumiert” wird, statt sich mit Sachen auseinanderzusetzen, ist eine Tatsache. Der Trend vom Buch zum Video, vom Schach zum Ballerspiel am Computer, von Bewegung zum Sitzen usw. ist unübersehbar. Wenn wir unser Schulsystem nicht ändern, wird sich dieser Trend immer mehr verstärken.

Bonuskommenatar hierzu :

+

Hier werden womöglich Müllarbeiter und Kräfte, die telefonisch (“fernsprachlich”) helfen unterschätzt.

Nie war es heutzutage leichter nicht zu verblöden, wie zuvor.

Dr. W ist schon lange im Geschäft, erinnert sich gerne wie seinerzeit (s um 1968 herum) i.p. Wissen vom einigen von Hegemonie gesprochen, wie geschrieben worden ist.

Insofern sind (Volks-)Bibliotheken nicht nur in der BRD aufgesetzt worden, in den Siebzigern, auch um Herrschaft qua Wissen zu meiden zu suchen.

Sozialdemokraten haben, nicht nur in der BRD, einiges diesbezüglich durchgesetzt, Dr. W bleibt hier begrüßend.

Dr. W kennt auch die post-sozialistische Sicht, wie bspw. in Česko,

MFG

Dr. Webbaer

PS:

So schaut’s womöglich besser aus.

Dr. W ist nicht mehr ganz firm i.p. moderner Webtechnik.

*

s[o} um 1968 herum

*

Bonuskommen[]tar

(Dr. W soll sich bekanntlich nie aufregen)

Von keinem „Wir“ darf ich selbst eine paradiesische Welt erwarten, denn hinter dem „Wir“ steckt immer irgendeine Organisation, irgendein Gebilde, das zwar behauptet im Interesse eines Kollektivs zu handeln, eines Kollektivs zu dem auch ich gehöre, doch dieses „Wir“-Kollektiv stellt immer das Wohl des „Wir“ über das Wohl meines eigenen Ichs (und ja, hin und wieder muss dann ein „Ich“ im Interesse des „Wir“ über die Klinge springen).

Und trotzdem könnte Künstliche Intelligenz mein eigenes Schicksal und mein Leben deutlich verbessern und wirlich paradiesisch machen – dann nämlich wenn die Künstliche Intelligenz nicht im Auftrag eines „Wir“ handelt, sondern im Auftrag von mir selbst. Die persönliche Künstliche Intelligenz also, welche die Gedanken, die ich ihr mitteile für sich behält und sie nicht an den meistbietenden verkauft, die persönliche Künstliche Intelligenz, die quasi ein Doppelgänger von mir ist und die immer in meinem eigenen Interesse handelt und nie im Interesse eines unpersönlichen „Wir“. Leider erleben wir in Filmen, die „Künstliche Intelligenz“ zum Thema haben, die Künstliche Intelligenz meist als (eventuell sogar Angst einflössenden) Gegner, mindestens aber als genauso grossen Egoisten wie ich selbst es bereits bin. Dabei wäre eine Künstliche Intelligenz in Form eines besten Freundes, mindestens aber in Form eines immer dienstbereiten Geistes, wirklich ein Geschenk. Übrigens: in der Liste der Filme mit dem Thema Künstliche Intelligenz erscheint die im Film verkörperte Künstliche Intelligenz fast immer als Gegner des Menschen oder aber als Egoist (z.B. „Her“ oder „Ex Machina“ ) und nur selten als Kumpel oder gar als Held im Dienste des Guten („I, Robot“ ist dazu ein Beispiel). Was nur sagt das über unser Roboterbild aus? Oder ist unser Roboterbild im Endeffekt nichts anderes als eine andere Form unseres Menschenbilds?

Martin Holzherr: “Von keinem „Wir“ darf ich selbst eine paradiesische Welt erwarten, denn hinter dem „Wir“ steckt immer irgendeine Organisation, irgendein Gebilde, das zwar behauptet im Interesse eines Kollektivs zu handeln, eines Kollektivs zu dem auch ich gehöre, doch dieses „Wir“-Kollektiv stellt immer das Wohl des „Wir“ über das Wohl meines eigenen Ichs (und ja, hin und wieder muss dann ein „Ich“ im Interesse des „Wir“ über die Klinge springen).”

Jaromir: Mein “wir” sind wir Menschen. Ich gehöre keiner Partei, keiner Ideologie, keiner Gruppe an, die sich über andere Gruppen erheben will. Nur denke ich, alle Menschen sollten sich auf einer gemeinsamen Grundlage einigen, an der nicht gerüttelt werden sollte und die eine Basis für alle Diskussion und Entwicklung sein könnte. Als diese Basis sehe ich momentan nur die Naturwissenschaften – und das vor allem wegen ihrer Falsifizierbarkeit: Eine Theorie gilt nicht mehr, wenn mit überprüfbaren Mitteln gezeigt wird, dass sie falsch ist.

Leider versuchen heutzutage viele, auch Mächtige, diese starke und wohl einzige Mögliche “Diskussionsgrundlage” abzuschaffen – das empfinde ich als sehr gefährlich.

Martin Holzherr: “Dabei wäre eine Künstliche Intelligenz in Form eines besten Freundes, mindestens aber in Form eines immer dienstbereiten Geistes, wirklich ein Geschenk. Übrigens: in der Liste der Filme mit dem Thema Künstliche Intelligenz erscheint die im Film verkörperte Künstliche Intelligenz fast immer als Gegner des Menschen oder aber als Egoist (z.B. „Her“ oder „Ex Machina“ ) und nur selten als Kumpel oder gar als Held im Dienste des Guten („I, Robot“ ist dazu ein Beispiel). Was nur sagt das über unser Roboterbild aus? Oder ist unser Roboterbild im Endeffekt nichts anderes als eine andere Form unseres Menschenbilds?”

Jaromir: Das sehe ich wie Sie, nur denke ich, momentan wäre es schon sehr hilfreich, wenn viele akzeptieren würden, dass künstliche neuronale Netze nicht das sind, was sie sich unter künstlicher Intelligenz vorstellen, vor allem was die negative Vorstellung davon angeht.

Ihre Frage aber finde ich sehr interessant: “Oder ist unser Roboterbild im Endeffekt nichts anderes als eine andere Form unseres Menschenbilds?”

Ich bleibe optimistisch. 🙂 Zwar sehe ich, dass momentan Populisten auf der ganzen Welt unsere großen Probleme noch verschärfen, statt sie zu lösen, wie den Klimawandel und die ganzen Kriege auf der Welt, die Ursache sind für Flucht, Armut, Hunger und Terror. Andererseits denke ich, wenn wir aus dem Mittelalter heraus unseren Humanismus entwickelt haben, warum sollten wir uns jetzt zurück entwickeln, in eine Zeit, in der ein Mensch den anderen für ein Tier hielt, Körperstrafen, Folter und Hinrichtungen als normal galten und es kein allgemeines Rechtsempfinden gab.

@Jaromir Konecny (Zitat): warum sollten wir uns jetzt zurück entwickeln? Antwort: Der Mensch selbst entwickelt sich nur wenig. Was sich entwickelt ist Wissen und Technologie und damit verbunden Wohlstand und die Macht des Menschens Dinge zu verändern. Von diesem Zuwachs an Fähigkeiten profitiert fast jeder Bereich unabhängig davon ob er von uns positiv oder negativ eingeschätzt wird. Hilfsorganisationen nutzen die Blockchain-Technologie um Flüchtlingen Güter und Geld auszuhändigen und international tätige Drogenhändler nutzen Blockchain um ihre Lieferkette sicher gegen unerwünschste Abzweigungen zu machen.

Es gibt Hyperschallwaffen, die Atombomben ohne Chance auf ein Abfangen durch ein Verteidigungssystem ins Ziel bringen und es gibt hyperschall-schnelle Raketen, die Touristen zum Hotel im Erdorbit transportieren.

Gefährlich wird ein Zuwachs an Macht und technischen Fähigkeiten auf Gebieten wie der Bio- und Nano- und eventuell Nukleartechnologie, falls sie in den Händen von einigen bösartigen Wissenschaftlern oder Technikern sind, die damit terroristische Ziele verfolgen – und zwar umso gefährlicher, je autonomer diese “Experten” agieren können. Ich bin – ähnlich wie Martin Rees – davon überzeugt, dass uns fortgeschrittene Technologie nicht nur als Heil- und Hilfsmittel, sondern auch als Terrormittel begegnen wird. Martin Rees glaubt ja, wir befänden uns wegen der immer potenter werdenden Technologie, die zunehmend auch von einem kleinen Team kontrolliert werden kann, im letzten Jahrhundert der Menschheit, denn es sei nur eine Frage der Zeit bis die ganze Menschheit quasi von einem Human-Extinction-Team erwischt wird und er hat schon einmal eine Langzeitwette darauf abgeschlossen, dass ein technischer Unfall oder ein terroristischer Anschlag bis 2020 mindestens 1 Million Menschen tötet. Nun, wahrscheinlich ist er da zu optimistisch, was die Zeitspanne betrifft – es wird wohl schon noch etwas länger dauern. Doch irgendwann wird so etwas passieren. Vielleicht können ja Systeme der künstlichen Intelligenz uns helfen, solche heranziehende technische Gefahren früher zu erkennen und besser darauf zu reagieren.

@Konecny

“… unseren Humanismus entwickelt haben.”

“Die Menschenwürde ist unantastbar” – na klar, Papier ist geduldig, wie der Zynismus immer und überall ist!?

Populismus ist, wenn man keinen konkreten Weg aufzeigt WIE diese Welt humanistisch werden soll, der Glaube an die gewählten “Treuhänder” und an eine Technokratie in Kapitalismus-Light wird es sicher nicht richten.

hto: “unseren Humanismus entwickelt haben.”

“Die Menschenwürde ist unantastbar” – na klar, Papier ist geduldig, wie der Zynismus immer und überall ist!?

Populismus ist, wenn man keinen konkreten Weg aufzeigt WIE diese Welt humanistisch werden soll, der Glaube an die gewählten “Treuhänder” und an eine Technokratie in Kapitalismus-Light wird es sicher nicht richten.”

Jaromir: “Ich hoffe trotzdem, dass der anonyme Wutbürger die Welt nicht zugrunde richtet, der statt nach Lösungen für die Probleme dieser Welt zu suchen, nur die Schuld für alles bei den anderen sucht, vor allem, wenn sie eine andere Meinung als er selbst haben. Und jetzt möchte ich Sie bitten, hier beim Thema und in einem angebrachten Diskussionsrahmen zu bleiben.”

Ergänzung: Ein Human-Extinction-Team wird mit Sicherheit ausschliesslich aus Menschen bestehen. Wenn also die Menschheit absichtlich vernichtet wird, kann man zu 99%-iger sicher sein, dass Menschen am Werk waren.

Martin Holzherr: “Ein Human-Extinction-Team wird mit Sicherheit ausschliesslich aus Menschen bestehen. Wenn also die Menschheit absichtlich vernichtet wird, kann man zu 99%-iger sicher sein, dass Menschen am Werk waren.”

Jaromir: Damit haben Sie vollkommen recht! Ich habe wirklich viel mehr Angst vor autonomen Robotern, die von Menschen gegen Menschen trainiert und eingesetzt werden, als dass sich irgendeine KI selbstständig macht, um uns auszulöschen. Den autonom agierenden auf ein paar Aufgaben getrimmten Roboter gibt es schon, eine KI, die im eigenen Auftrag agiert noch lange nicht – wenn überhaupt irgendwann.

Und klar gibt es folgendes: Voluntary Human Extinction Movement

Nun, vielleicht sind die Leute im Voluntary Human Extinction Movement nur der politische Arm einer weiteren Bewegung zu der auch ein militärischer Arm gehört und dieser Arm operiert vielleicht unter dem Namen Forced Human Extinction Movement

Tatsächlich könnte es in einer Welt, die von künstlichen Intelligenzen beherrscht wird, sehr viel weniger gewalttätig zugehen. Und einige Journalisten werden dann wohl darüber schreiben und sich beklagen, die Roboter seien ja äusserlich so menschenähnlich, aber die Forscher und Robotiker hätten wohl vergessen, die menschliche Aggressionsbereitschaft in diese künstlichen Wesen einzubauen. Und ja, damit seien Roboter wohl nur schwache Abbilder wirklicher Menschen.

Martin Holzherr: “Tatsächlich könnte es in einer Welt, die von künstlichen Intelligenzen beherrscht wird, sehr viel weniger gewalttätig zugehen. Und einige Journalisten werden dann wohl darüber schreiben und sich beklagen, die Roboter seien ja äusserlich so menschenähnlich, aber die Forscher und Robotiker hätten wohl vergessen, die menschliche Aggressionsbereitschaft in diese künstlichen Wesen einzubauen. Und ja, damit seien Roboter wohl nur schwache Abbilder wirklicher Menschen.”

Jaromir: 🙂 Tatsächlich ist es viel leichter kontrollierbar, KI-Systeme mit neutralen Datensätzen zu trainieren, damit sie dann objektivere und besssere Entscheidungen treffen als menschliche Experten, als die Entscheidung eines menschlichen Experten zu überprüfen bzw. sich darauf verlassen, dass sie einigermaßen objektiv ist.

Mir persönlich wäre es viel lieber, von nur auf das Wohl der Menschheit trainierten Maschinen regiert zu werden als von Menschen. Denn Menschen missbrauchen Macht fast immer, wenn sie diese erlangen. Schon jetzt treffen Maschinen neutralere und bessere Entscheidungen als jeder menschlicher Experte – bei Aufgaben, wo die Entscheidung des Menschen und der Maschine verglichen werden kann. Selbstverständlich sollten Menschen die Maschinen kontrollieren, doch sich in ihre Entscheidungen nur bei offensichtlichen Fehlern einmischen.

Also ehrlich Jaromir, ich bin auch ein Freund der Robotik, allerdings erst wenn Mensch OHNE die Symptomatik von “Wer soll das bezahlen?” und “Arbeit macht frei” zusammenlebt.

Wie das WIRKLICH-WAHRHAFTIG funktionieren soll, da habe ich schon einige Male hier mit Argumenten REINSTEN Humanismus zur Kommunikation aufgerufen.

Eine Frechheit mich mit den allgemeinen Konsumautistischen Forderungen der so genannten Wutburger auf eine Stufe zu stellen, ebenso bin ich auch nicht der hier so bezeichnete Troll.

hto: “Eine Frechheit mich mit den allgemeinen Konsumautistischen Forderungen der so genannten Wutburger auf eine Stufe zu stellen, ebenso bin ich auch nicht der hier so bezeichnete Troll.”

Jaromir: Ich habe Dich nicht als Wutbürger bezeichnet, habe ja über Wutbürger allgemein geschrieben. 🙂 Ich konnte aber nicht widerstehen, als ich Deinen Satz gelesen habe. Ich wollte nun mal zeigen, wie man sich fühlt, wenn man solche Sätze als Kommentar auf den Lob des Humanismus von einem liest:

““Die Menschenwürde ist unantastbar” – na klar, Papier ist geduldig, wie der Zynismus immer und überall ist!? Populismus ist, wenn man keinen konkreten Weg aufzeigt WIE diese Welt humanistisch werden soll, der Glaube an die gewählten “Treuhänder” und an eine Technokratie in Kapitalismus-Light wird es sicher nicht richten.”

Hast Du mir darin nicht Zynismus, “den Glauben an die gewählten “Treuhänder” und an eine Technokratie in Kapitalismus-Light” unterstellt? Wem sonst, wenn nicht mir?

Ich habe schon in drei Diktaturen gelebt, auch fast zwei Jahre in Afrika in einer panarabisch sozialistischen. Ich sehe all diese Unzulänglichkeiten unseres liberalen Kapitalismus, das Raubrittertum an seinen Börsen und seine absurden Möglichkeiten für einige wenige, sich maßlos zu bereichern. Trotzdem ist mir dieses System viel lieber als alle anderen, die ich erlebt habe und die es momentan gibt.

Ich sehe die Machtgier und den Machtmissbrauch. Um selbst nicht Macht missbrauchen zu müssen, bin ich freier Schriftsteller, Bühnenpoet, Wissenschaftskabarettist und ja, auch KI-Speaker geworden.

Trotz allem staune ich immer wieder, dass ein Planet mit 8 Milliarden Menschen darauf noch besteht. Nur bekomme ich in der letzten Zeit – bei dem Irrsinn, mit dem Demagogen, Populisten und Rattenfänger auf der ganzen Welt jetzt skrupellos nach Macht greifen -, das Gefühl, es ist zu spät.

Plötzlich taucht aber mit künstlichen neuronalen Netzen eine große Chance für die Zukunft: Zum ersten Mal in der Geschichte der Menschheit können wir mit Hilfe von KNN neutrale Entscheidungen treffen. Soll ich dann diese Chance bekämpfen?

Klar kann das alles schief gehen. Wenn wir uns mit der KI aber nicht tiefgehend und sachlich auseinandersetzen, wird es sicher schief gehen. Dann werden tatsächlich ein paar Reiche noch reicher, neue Kriege entstehen, vor denen mir schon jetzt gruselt, das Klima wird endgültig kollabieren. Daran glaube ich. Und auch deswegen habe ich den Beitrag geschrieben.

Sollte ich Dich verletzt haben, entschuldige ich mich hiermit dafür. Nur wäre es tatsächlich sehr hilfreich, wenn wir hier sachlich zum Thema diskutieren: Und in diesem Beitrag von mir wurde nur gesagt: Das Bild von der real existierenden künstlichen Intelligenz wird in den Medien teils unsachlich und falsch gemalt. Und: Künstliche neuronale Netze können helfen, unsere Zukunft zu meistern. Ansonsten haben wir keine. Wenn Du konkrete Argumente dagegen hast, dann bin ich dankbar für diese.

Solange der Kreislauf des geistigen Stillstandes seit der “Vertreibung aus dem Paradies” nur die systematische Sprache und somit die Unwahrheit belebt, ist Mensch praktisch konfusioniert und theoretisch tot.

hto: “Solange der Kreislauf des geistigen Stillstandes seit der “Vertreibung aus dem Paradies” nur die systematische Sprache und somit die Unwahrheit belebt, ist Mensch praktisch konfusioniert und theoretisch tot.”

Jaromir: Ich sehe die Vertreibung aus dem Paradies als den symbolischen Anfang des Strebens nach Erkenntniss, also nach etwas Erstrebenswertem – meiner Meinung nach.

Wir Menschen leben, sind also nicht “theoretisch tot”, wie Du schreibst, auch meiner Meinung nach, nur glaube ich auch, dass unser ganzes Bildungssystem reformiert werden muss. Das habe ich in meinem Beitrag auch angesprochen.

Aber trotzdem bleibt die Frage: Wohin soll diese KI uns führen, sollen wir uns überraschen lassen?

Das humanistische Zusammenleben kann nur ein sozialistisches sein. Aufgrund dieser Erkenntnis, denn es ist eine nachvollziehbare Erkenntnis in den biblischen Schriften, kann auch das Bildungssystem nur reformiert werden – eindeutige Wahrheit die den Pfaffen und sonstigen Profitler nicht schmecken wird.

Und die “Vertreibung aus dem Paradies”, die ist unser erster und bisher einzige geistige Evolutionssprung, vom instinktiven ins bewusste Zusammenleben, bzw. in die Möglichkeit eines fusionierenden Verantwortungsbewusstsein, Zusammenleben OHNE Steuern zahlen, OHNE “Sozial”-Abgaben, OHNE manipulativ-schwankende “Werte”, OHNE irrationalen Zeit-/Leistungsdruck zu/in einer Karriere von Kindesbeinen, usw. , auf der Basis eines UNKORRUMPIERBAREN Menschenrechts auf KOSTENLOSER Nahrung und KASSEN-/KLASSENLOSER Gesundheit, dann klappt’s sicher bald auch mit der vollen Kraft des Geistes und KI war die letzte Krücke eines unwürdig gespaltenem Humanismus 😊

hto: “Aber trotzdem bleibt die Frage: Wohin soll diese KI uns führen, sollen wir uns überraschen lassen?

Das humanistische Zusammenleben kann nur ein sozialistisches sein. Aufgrund dieser Erkenntnis, denn es ist eine nachvollziehbare Erkenntnis in den biblischen Schriften, kann auch das Bildungssystem nur reformiert werden – eindeutige Wahrheit die den Pfaffen und sonstigen Profitler nicht schmecken wird.”

Jaromir: Was KI angeht: wir dürfen uns NICHT überraschen lassen! Wir müssen versuchen zu verstehen, wir müssen mitdenken und mitgestalten und dürfen uns diese neuen Errungenschaften nicht nehmen lassen. Deswegen schreibe ich diesen Blog.

In Sachen Sozialismus bin ich skeptisch. Ich habe ja selbst erleben können, wie ein solches System pervertiert, auch wenn Idealisten an die Macht kommen. Der Sozialismus ist viel weniger dagegen gewappnet, zu einem totalitären System zu entarten als freiheitliche Demokratie. Sogar mein Vater, Vorkriegskommunist, Idealist, Kämpfer gegen die Nazis, konnte nach dem Krieg den Sozalismus nicht kritisch hinterfragen: Am Ende des sozialismus der sowjetischen Prägung gab’s nur Verwüstung. Obwohl der Anfang so viel versprach.

Dank künstlicher Intelligenz könnte ich mir aber eine sanftes Hineinrutschen in ein System vorstellen, in dem jeder versorgt wird. Das sollte bald mit einem bedinungslosen Einkommen für alle anfangen, wenn wir hier nicht infolge der Automatisierung eine breite Schicht von Menschen in unvorstellbarer Armut haben wollen. Denn dann würde in Europa wieder das Zeitalter von brutalen sozialen Unruhen anbrechen. Wenn wir uns samt Erde schon vorhin nicht vernichtet haben. Wie gesagt aber: Ich bin Optimist, ich glaube, wir bekommen’s hin. 🙂

Ich wäre auch Optimist, wenn wir endlich anfangen würden KONKRET über die Zukunft zu kommunizieren.

Und entschuldige, das bedingungslose Grundeinkommen ist systemrationaler Zynismus, das kann bei Wettbewerb, so wie auch der Sozialismus, nicht funktionieren. Es ist eine “fixe Idee” im Sinne der Bewusstseinsbetäubung!

Soziologische Betrachtungen:

https://www.e-stories.de/view-kurzgeschichten.phtml?28160

Philosophische Betrachtungen:

https://www.e-stories.de/view-kurzgeschichten.phtml?23749

Technologische Betrachtungen:

https://www.e-stories.de/view-kurzgeschichten.phtml?40230

Das Problem der künstlichen Intelligenz in der Wahrnehmung der Öffentlichkeit und damit auch der Journalisten ist ihre Unsichtbarkeit. Klar ist KI irgendwo in den Suchalgorithmen Googles, in den Kaufvorschlägen Amazons oder in google translate vorhanden und versteckt am Werkeln. Doch genau das ist das Problem. Künstliche Intelligenz ist versteckt am Werk. Man kann nicht mit ihr Reden, sie gibt keine Auskunft und offenbart sich nicht. Es gibt nämlich noch keine von künstlicher Intelligenz beseelte Roboter, es gibt keine künstlich intelligenten Personen mit denen man reden und sich unterhalten könnte. Und wenn es Chat-Programme gibt, hinter den eine KI steckt, dann ist das in der Regel nichts anderes als Cheat, Cheat-Chat also.

Angst und Ungewissheit schürt eine Zukunft in der KI alles umwälzt auch darum, weil eine solche Zukunft keinesfalls eine bessere sein muss. Klar ist es in einer alternden Gesellschaft wichtig, dass die Arbeit teilweise automatisiert wird. Doch eine radikale Automatisierung, die uns alle arbeitslos macht ist selber wieder problematisch. Es stellten sich dann Frage wie:

– Warum sollten Kinder überhaupt noch in die Schule gehen, wenn sie später keinen Beruf ausüben?

– Was werden all die Leute mit ihrer unendlich vielen Freizeit anfangen? Werden sich Banden von randalierenden gewalttätigen Jugendlichen bilden einfach weil es ihnen zu langweilig ist?

Solche und viele ähnliche Fragen stellen sich nicht nur mir, sondern auch den Journalisten und letztlich der ganzen Gesellschaft.

“Ich denke, also bin ich” – Was bin ich?

Ab einem gewissen Punkt, macht jedes intelligente System einen Evolutionssprung, dann ist es womöglich nicht mehr egal ob Mensch oder Maschine …, besonders wenn Maschine in aktiver Bewusstseinsschwäche als besserer Entscheidungsträger entworfen wurde!?

Der militante Teil des Voluntary Human Extinction Movement ist die Church of Euthanasia.

Den Antinatalismus kann man aber auch noch angenehmer gestalten.

Man gibt allen Männern die ideale Roboterfrau, und man gibt allen Frauen den idealen Robotermann.

Notfalls fügt man noch einige Roboterkinder hinzu.

@Karl Bednarik: Ja, eine für mich plausible Vision: Zuerst haben alle Menschen nur noch ideale Partner (für das Leben, den Sex, etc) und klar können nur Roboter solche idealen Partner sein. Und dann, eine Generation später gibt es nur noch Roboter. Hier stellt sich die Frage: Werden Roboter irgendwann auch nur noch bereit sein mit idealen Partnern zusammenzusein. Oder wird die Idee des idealen Partners immer eine Idee der Menschenwelt bleiben und damit später einmal eine historische Idee sein? Historisch einfach darum, weil es keine Menschen mehr geben wird.

Über diesen Satz bin ich gefallen:

Inwiefern wir diese Chance bekommen haben, war dem Beitrag nicht zu entnehmen – jedenfalls für mich nicht. Denn auch autonome Fahrzeuge gewähren keinen besseren Klimaschutz: auch sie müssen fabriziert werden, brauchen Rohstoffe, ihre Reifen haben abrieb – und wenn ein autonomes Fahrzeug erlaubt, auch Kinder von A nach B zu bringen, ohne dass die Eltern dies tun müssten, die vielleicht zum selben Zeitpunkt von F nach G wollen, so brauchen wir vielleicht irgendwann für jedes Familienmitglied ein eigenes, kleineres Gefährt. Und ein noch viel größeres Straßennetz.

Nein, ich denke nicht, dass wir noch breiter und noch vernetzter denken sollten, als wir es ohnehin tun. Wir sollten vielmehr tiefer denken und in Wirkungen-Netzen, um uns die Konsequenzen unseres Handelns vor Augen zu führen. Und wir sollten erst einmal versuchen, die Natur und ihre Gesetzmäßigkeiten zu verstehen, um die richtigen Entscheidungen treffen zu können. Ich sehe jedenfalls nicht, wie Roboter uns vor falschen Entscheidungen und ihren negativen Folgen, z B. für das Klima, retten sollten, wenn wir es sind, die sie bauen und programmieren. Aus diesen Anfangsbedingungen können auch sie nicht aussteigen.

Wie Richard Feynman schon sagte: Nature can`t be fooled.

Und wenn ich mir so anschaue, was der Mensch seit seiner Entwicklung zum Homo sapiens der Natur angetan hat, drängt sich mir der Eindruck auf, als sei es unsere Aufgabe, zum Untergang der Säugetierära, uns eingeschlossen, maßgeblich beizutragen.

Trice: “Über diesen Satz bin ich gefallen:

‘Mit künstlicher Intelligenz haben wir zum ersten Mal eine große Chance bekommen, die Erde und uns vor uns selbst zu retten – bevor eine Klimakatastrophe eintritt oder eine globale Epidemie ausbricht, die uns alle auslöschen würde.’

Inwiefern wir diese Chance bekommen haben, war dem Beitrag nicht zu entnehmen – jedenfalls für mich nicht. Denn auch autonome Fahrzeuge gewähren keinen besseren Klimaschutz: …”

Jaromir: Autonome Fahrzeuge gewähren einen besseren Klimaschutz: Googles Waymo hat die erste Taxi-Flotte mit selbstfahrenden Autos in den USA auf den Start gebracht. Es ist anzunehmenen, dass solche Taxi-Flotten in den kommenden Jahren den städtischen Verkehr prägen werden. Experten prognostizieren, dass durch das autonome Fahren in etwa 15 Jahren niemand mehr einen Führerschein brauchen und es dann auch keine Autos mehr im Privatbesitz geben werde. Wenn ein Auto aber so exzessiv von vielen Fahrgästen genutzt wird wie ein autonomes Taxi, bedeutet das auch, dass viel weniger Autos produziert werden müssen.

Außerdem sind Elektroautos bei den autonomen Automobilen der Trend, der weniger Umweltverschmutzung bedeutet.

Elektromobile haben aber auch weniger Teile als die klassischen Fahrzeuge, müssen also auch nicht so oft repariert werden. Diese Teile kommen aus dem 3-D-Drucker – eine solche Herstellung verbraucht viel weniger Energie.

Aber das autonome Fahren ist nicht alles, wobei uns KNN helfen können, das Klima zu retten. Das Klima ist ein hochkomplexes nicht lineares System – das bedeutet große Datensätze mit Millionen Daten, in denen nur künstliche neuronale Netze Muster erkennen und somit Lösungen für damit zusammenhängende Problem aufzeigen können. Und und und …

Trice: “Und wir sollten erst einmal versuchen, die Natur und ihre Gesetzmäßigkeiten zu verstehen, um die richtigen Entscheidungen treffen zu können.”

Jaromir: Dafür haben wir keine Zeit mehr. Unser Klima ist angegriffen worden – massiv, und vielleicht unumkehrbar. Von uns.

Außerdem ist eine solche Forderung unrealistisch, erst einmal zu versuchen, die Natur und ihre Gesetzmäßigkieten zu verstehen. Das menschliche Streben ist immer nach dem “Trial & Error”-Prinzip gelaufen: Wenn man eine Idee hat, probiert man sie aus. Manchmal geht die Theorie der Praxis voraus, oft ist es aber auch umgekehrt. Wenn der Mensch nur dann etwas erfinden würde, wenn er die Natur der Sache versteht, wäre vielleicht noch nicht einmal das Rad erfunden worden. 🙂

@Trice: Künstliche Intelligenz bietet zusammen mit anderen Technologien wie der CO2-armen Energierzeugung tatsächlich die Chance die Welt zu dekarbonisieren ohne deshalb auf Mobilität, Strom, etc. verzichten zu müssen. Die Betonung liegt auf Chance. Trump nutzt diese Chance nicht, wenn er die Kohleindustrie am Leben erhalten will und er den Clean Air-Act schleift.

Eigentlich gibt es mit zunehmenden Wissen und besserer Technologie immer mehr Chancen, die Welt in einer gewünschten Art und Weise zu gestalten. Diese Chancen braucht es, denn gerade die aufstrebenden Länder werden auf Technologie nicht verzichten. Die Frage ist nur, welche Technologie sie einsetzen. Ihr Satz “Und wir sollten erst einmal versuchen, die Natur und ihre Gesetzmäßigkeiten zu verstehen, um die richtigen Entscheidungen treffen zu können. “ dagegen verlagert die Entscheidungen ob man Chancen ergreift in die Zukunft. Allzuviel Zeit bleibt aber beispielsweise bei der Dekarbonsierung der Industrie und unseres Alltags nicht, so dass die Chancen jetzt ergriffen werden müssen und nicht erst wenn man alles weiss.

Zudem wissen wir heute schon sehr viel. Überhaupt wird es einen Verzicht auf viele Verheissungen heutigen Wissens und heutiger Technologie nicht geben. Die Menschen werden weiterhin froh darum sein, wenn man ihre Krankheiten heilt, ihnen ein längeres Leben in Gesundheit ermöglicht und sie in ihrer Freizeit an ihre Wunschziele reisen können. Entscheidend ist nur wie man diese Ziele erreicht.

Mehr technologische Möglichkeiten und Alternativen bedeuten allerdings selbst dann, wenn man sie nutzt, nicht unbedingt, dass es besser herauskommt wie sie mit ihrem Beispiel eines zunehmenden Verkehrs durch allzeit verfügbare Fahrzeuge gut aufzeigen. Hier braucht es tatsächlich eine Art Nudging, ein Schubsen in die richtige Richtung also. Autonome Fahrzeuge sollten beispielsweise vorzugsweise von mehreren genutzt werden. Sie könnten die heutigen Busse ersetzen und erst noch schnellere Verbindungen schaffen, indem die autonomen Busse nur noch 6 bis 20 Personen fassen, dafür aber überall verfügbar sind und eng getaktet fahren. Es gibt Studien, die durch einen derartig optimierten Verkehr eine Verminderung der Strassenbelastung auf einen Achtel oder weniger erkennen.

Sehr geehrter Herr Konecny !

Erstens hat, wie Sie sicher wissen, die KI schon mehrere Zukünfte hinter sich.

Zweitens stimme ich mit Ihnen überein, das z.B. Deep Learning eine wunderbare Methode ist bestimmte Probleme z.B. in der Mustererkennung zu lösen.

Drittens gibt es aber Probleme, wie z.B. Autofahren, die so (lebens)wichtig sind, dass geprüft werden muss, ab das Verfahren wirklich zuverlässig das tut, was es tun soll.

Jeder Softwareentwickler weiß, dass hier Testen allein nicht reicht.

Die Korrektheit von Algorithmen nachzuweisen ist schwierig. Ich selber habe die Korrektheit von Algorithmen gegenüber dem BSI mathematisch nachgewiesen und war stellv. Projektleiter im Großforschungsprojekt VERISOFT zur Verifikation von Software.

Beim Deep Learning gibt zwei Hauptprobleme:

1. Es gibt keine Kontrollmöglichkeit über das, was das System wirklich gelernt hat.

2. Bei Aufnahme neuer Daten können alte Erkenntnisse verloren gehen.

Damit sind technische Abnahmen von solchen Systemen nicht möglich.

Beispiel: Wird ein Autonomes Fahrzeug durch Deep Learning trainiert, kann es also sein, dass es lernt z.B. wegen kleiner Jungs in Matrosenanzügen nicht zu bremsen. So etwas ist durchaus plausibel, wenn z.B. während des Trainings überall Plakatwände mit Jungs in Matrosenanzügen vorhanden waren. Um einen solchen Fehler zu bemerken, müssen erst einige Unfälle mit kleinen Jungs in Matrosenanzügen passieren. Wird dann ein Datensatz zur Vermeidung solcher Unfälle eintrainiert, wird damit die Gesamtmenge des Gelernten erhöht. Da aber die Gesamtmenge des Gelernten begrenzt ist, kann durch diese zusätzliche Lektion etwas Nützliches vergessen werden. Hoffentlich bremst dann das System weiter auch für kleine Mädchen mit roter Schleife.

Um eine technische Abnahme zu ermöglichen, könnte man Deep Learning-Systeme mit regelbasierten KI-Systemen (waren auch mal die Zukunft!) koppeln oder die Entscheidungen der KI transparent machen, wie es der SZ-Kollege vorschlägt.

Im März kam in Tempe/USA eine Fußgängerin durch ein autonomes Fahrzeug der Firma Uber um. Das Auto fuhr schneller als erlaubt und Uber hatte das Kollisionsverhinderungssystem des Autoherstellers Volvo abgeschaltet. Dies ist eine typische Selbstüberschätzung der KI-Entwickler: Da die eigene KI angeblich “besser” ist, interessieren weder allgemeine Regeln noch die Entwicklungen von anderen (Volvo). Ist das Ihre Zukunft, Herr Konecny?

Dr. Gunter Laßmann: “Sehr geehrter Herr Konecny! Erstens hat, wie Sie sicher wissen, die KI schon mehrere Zukünfte hinter sich.”

Jaromir:

Sehr geehrter Herr Laßmann,

vielen Dank für Ihre tiefgehenden und wichtigen Anmerkungen.

In meinem Beitrag ging es vor allem darum: wenn wir über künstliche Intelligenz und künstliche neuronale Netze (KNN) berichten, sollten wir uns mit dem Thema tief auseinandersetzen und nicht statistische Optimierungsverfahren wie KNN mit Hal 9000 oder Terminator verwechseln, um Angst unter den Leuten zu verbreiten. Ich gebe aber zu, dass ich mir von KNN viel verspreche. Trotzdem finde ich Kontrolle der KNN notwendig, vor allem bei Entscheidungen, die schwerwiegende Folgen haben können.

Über die vergangenen KI-Winter weiß ich Bescheid. An unserem Institut für Theoretische Chemie an der TU München hat ein Freund in den 90ern über künstliche neuronale Netze geforscht, damals waren’s aber Spielereien. Jetzt werden sie aber breit angewendet und übertreffen bei weitem auch menschliche Experten, egal ob in der maschinellen Sprachverarbeitung, in der Computer Vision (Bildererkennung) und in allen anderen Bereichen, wo man in sehr großen Datensätzen nach Mustern sucht.

Kann man Ihre Arbeit über die Korrektheit von Algorithmen irgendwo im Netz nachlesen? Das würde mich interessieren.

Weitere Antworten auf Ihren Kommentar folgen: 🙂

Dr. Gunter Laßmann: “1. Es gibt keine Kontrollmöglichkeit über das, was das System wirklich gelernt hat.”

Jaromir: Wie Sie schreiben, können tief lernende neuronale Netze sich selbst nicht kontrollieren. Sie werden ja sehr eng auf eine Aufgabe hin trainiert. Sie können aber von anderen künstlichen Netzen kontrolliert werden, die speziell auf diese Kontrolle hin entwickelt und trainiert wurden. An solchen Netzen wird gearbeitet, auch von DeepMind. Den Menschen als Kontrollorgan sollten wir auch nicht vergessen.

Dr. Gunter Laßmann: “Bei Aufnahme neuer Daten können alte Erkenntnisse verloren gehen. Damit sind technische Abnahmen von solchen Systemen nicht möglich. Beispiel: Wird ein Autonomes Fahrzeug durch Deep Learning trainiert, kann es also sein, dass es lernt z.B. wegen kleiner Jungs in Matrosenanzügen nicht zu bremsen. So etwas ist durchaus plausibel, wenn z.B. während des Trainings überall Plakatwände mit Jungs in Matrosenanzügen vorhanden waren. Um einen solchen Fehler zu bemerken, müssen erst einige Unfälle mit kleinen Jungs in Matrosenanzügen passieren. Wird dann ein Datensatz zur Vermeidung solcher Unfälle eintrainiert, wird damit die Gesamtmenge des Gelernten erhöht. Da aber die Gesamtmenge des Gelernten begrenzt ist, kann durch diese zusätzliche Lektion etwas Nützliches vergessen werden. Hoffentlich bremst dann das System weiter auch für kleine Mädchen mit roter Schleife.”

Jaromir: An komplexere Aufgaben arbeiten mehrere gekoppelte Systeme zusammen, wie z. B. AlphaGo beim Go-Spielen mit einem überwacht lernenden neuronalen Netz, einem bestärkenden neuronalen Netz und einem regelbasierten System. Das “Gedächtnisproblem” ist tatsächlich ein wichtiges, wie Sie schreiben, aber auch daran wird gearbeitet, zum Beispiel bei der Natural Turing Machine, die mit einem externen Speicher gekoppelt ist. Eine Art Kurzzeitgedächtnis gibt es aber auch bei den rekurrenten neuronalen Netzen und ihrer Weiterentwicklung, den LSTM-Netzen.

Was aber die Jungs in den Matrosenanzügen angeht, glaube ich, dass die Bilderkennung der KNN schon so gut ist, dass solche Verwechslungen nicht mehr passieren dürfen. Trotzdem befinden wir uns da immer noch in der Entwicklungsphase. Die rasante Entwicklung der letzten zwei, drei Jahre spricht jedoch dafür, dass autonome Autos bald durch unsere Städte fahren werden.

Ein Problem ist hier auch die sich ständig ändernde Straßensituation und vor allem erschwerte Wetterbedingungen wie Nebel, Sturm usw. Ich will wirklich nicht jetzt sofort Flotten von autonomen Autos auf die Menschheit loslassen, bald werden sie aber schon so viel sicherer sein, als ein menschlicher Fahrer, dass sie den menschlichen Fahrer unweigerlich ersetzen werden. Wenn man sich die Anzahl der Kilometer ansieht, fahren die selbstfahrenden Autos schon jetzt mit weniger Unfällen als viele menschliche Fahrer.

Ich weiß aber, es ist sehr schwer zu akzeptieren, dass eine Maschine den Tod eines Menschen verursachte. Wenn wir aber eine Statistik haben, nach der menschliche Fahrer 100mal mehr Fußgänger verletzen oder töten als selbstfahrende Autos, muss man dann wohl doch überlegen, was am Ende besser ist. Ich gebe Ihnen aber recht: eine hundertprozentige Sicherheit wird es wohl nie geben: Es kann immer etwas auftreten, was noch nie da war.

Dr. Guntar Laßmann: “Um eine technische Abnahme zu ermöglichen, könnte man Deep Learning-Systeme mit regelbasierten KI-Systemen (waren auch mal die Zukunft!) koppeln oder die Entscheidungen der KI transparent machen, wie es der SZ-Kollege vorschlägt.”

Jaromir: In dem von mir zitierten SZ-Artikel steht aber: “Künstliche Intelligenz soll ihre Entscheidungen erklären, sodass Menschen sie nachvollziehen können.” Das heißt für mich, das künstliche neuronale Netz, das entscheidet, sollte auch erklären, warum es so entscheidet. Das kann es aber nicht, das liegt nun mal jenseits der Möglichkeiten eines statistischen Optimierungsverfahren, das auf eine Aufgabe hintrainiert wurde – das wissen Sie aber.

Ich finde regelbasierte KI-Systeme nach wie vor interessant, nur spielen tief lernende neuronale Netze nun mal Musik in dieser KI-Revolution. Die KI-Winter hat es ja gegeben, weil man mit den regelbasierten KI-Systemen nicht weiter kam.

Dr. Guntar Laßmann: “Im März kam in Tempe/USA eine Fußgängerin durch ein autonomes Fahrzeug der Firma Uber um. Das Auto fuhr schneller als erlaubt und Uber hatte das Kollisionsverhinderungssystem des Autoherstellers Volvo abgeschaltet. Dies ist eine typische Selbstüberschätzung der KI-Entwickler: Da die eigene KI angeblich “besser” ist, interessieren weder allgemeine Regeln noch die Entwicklungen von anderen (Volvo). Ist das Ihre Zukunft, Herr Konecny?”

Jaromir: Das war selbstverständlich ein tragischer Unfall. Und ich will ihn auch nicht damit beschönigen, dass täglich von menschlichen Autofahrern auf den Straßen Fußgänger umgebracht werden. Ich habe das Video des Unfalls vor ein paar Wochen gesehen. Damals hat der menschliche Kontrollfahrer kurz vor dem Unfall und beim Aufprall gegen die Frau auf seinen Schoss geschaut – hatte er dort ein SmartPhone liegen? Weiß man schon, warum das Programm die Frau nicht sah.

Meine Zukunft wäre eine schöne, wenn die Menschheit von den künstlichen neuronalen Netzen sehr profitieren könnte. Bei den politischen Entwicklungen in der ganzen Welt war ich bis vor kurzem sehr skeptisch, was die Zukunft angeht. Jetzt habe ich hin und wieder das Gefühl, mit Hilfe von KNN könnten wir vielleicht doch noch die Kurve kratzen. Egal aber wie wir das sehen, auch ohne uns werden KNN weiter entwickelt und KI sowieso. Vielleicht wird etwas doch massiv schiefgehen. Wenn wir aber nicht verstehen, was um uns herum geschieht, wird sicher etwas schief gehen.

@Jaromir Konecny:

Das ist eben die Frage. Gerade der Privatbesitz eines Fahrzeugs gewähleistet doch Freizügigkeit im Unterschied zu Bussen und Bahnen. Autos, die von vielen Menschen genutzt werden, tun dies nicht. Wenn man also Fahrzeuge bauen will, die jederzeit an jedem Ort von jedem Menschen genutzt werden können, wird die Menge an Fahrzeugen, die gefertigt werden müssen, bei 8 bis 10 Milliarden Menschen weltweit exorbitant hoch – es sei denn, nur eine privilegierte Zahl an Menschen ist dazu berechtigt. Hinzu kommt, dass Menschen mit Dingen, die ihnen nicht gehören, nicht unbedingt pfleglich umgehen (viele tun es nicht einmal beim eigenen Fahrzeug), was die Lebenserwartung eines Fahrzeugs nicht gerade erhöht.

Ganz genau. So beschrieb es ja schon Dietrich Dörner* als Fazit aus seinen

Untersuchungen zur menschlichen (Un-)Fähigkeit, komplexe Probleme

zu lösen: “Das Problem ist da, also sollte man es lösen und nicht erst viel Zeit vergeuden, um sich über die genaue Gestalt des Problems Klarheit zu verschaffen.”

Eben diese Denke in Kombination mit der Reduktion auf eine zentraleVariable

– Handeln ohne Situationsanalyse

– ohne Berücksichtigung von Fern- und Nebenwirkungen (darum kümmern wir uns, wenn es soweit ist)

– lineares Extrapolieren,

– keine Fehlerkorrektur

– keine berücksichtigung der Ablaufgestalt von Prozessen (Rückkopllungen, Eigendynamik)

– massive Probleme mit der Einbeziehung von Vergangenheit und Zukunft

-Glaube, über die richtigen Maßnahmen zu verfügen, und sie deshalb immer wieder anzuwenden…

dies und einiges mehr sind die Ursachen für desaströse und katastrophale künftige Großereignisse.

Bekannt ist das eigentlich seit der diversen Untersuchungen und Projekte zum Komplexen Problemlösen, die in den 70er und 80er Jahren des letzten Jahrhunderts durchgeführt wurden. Es wurde zur Kenntnis genommen, nur nicht begriffen, weshalb sich am Vorgehen, am Handeln auch nichts geändert hat.

Übrigens, der Star in einem dieser Projekte war eine Person, von der Dörner schrieb, sie habe sehr ruhig gehandelt, lange abgewartet und beobachtet. Sie dosierte ihre Maßnahmen sehr sparsam, bemühte sich um ein Verständnis der Abläufe und erkannte die Eigendynamik des Systems sehr bald. Nix mit trial and error. Das macht man nur, wenn man sich auf eine einzelne Variable eines komplexen Systems /Problems konzentriert.

* Dietrich Dörner ( 1989 /1992). “Die Logik des Misslingens. Strategisches Denken in komplexen Situationen.” Reinbek: Rowohlt

Dörner, Kreuzig, Reither, Stäudel (1983/1994). “Lohhausen. Vom Umgang mit Unbestimmtheit und Komplexität.” Bern: Hans Huber