Was Descartes von Data (nicht) lernen könnte

BLOG: Die Sankore Schriften

Der Funktionalismus behauptet, dass ein Computer, der das gleiche leisten kann wie das menschliche Gehirn, diesem praktisch in jeder Hinsicht gleichen müsse, also auch Bewusstsein besitze. Der Philosoph René Descartes (1596-1650) stellte sich sogar die folgende Frage: Sind wir Menschen nicht auch mehr oder weniger „denkende Maschinen“, die lediglich aus organischen Materialien bestehen? Verfolgt man seinen mechanistischen Ansatz weiter, so würde eine Maschine mit Denkfähigkeit und Bewusstsein eine neue Spezies darstellen. Künstlich erschaffen und ohne eigene Reproduktionsfähigkeit – aber mit der Fähigkeit der Selbsterkenntnis ausgestattet.

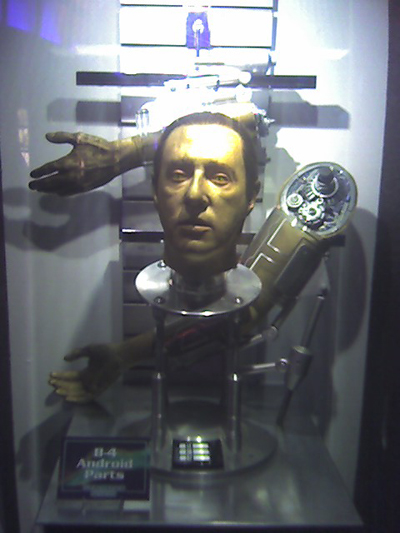

Data’s Kopf und andere Körperteile

Der positronische Android Data (*2335) in der Science-Fiction Serie “Raumschiff Enterprise” ist ein Exemplar solch einer neuen Spezies.

Data: „Ich bin konstruiert, um menschliche Fähigkeiten zu übertreffen, sowohl mental als auch physisch.“

Timothy: „Sind Androiden besser als Menschen?“

Data: „Besser ist ein höchst subjektiver Ausdruck. Ich besitze z. B. nicht die Fähigkeit Emotionen zu empfinden, so wie es die Menschen tun.“

Timothy: „Keine Emotionen? Sie meinen, Sie empfinden keine Freude oder Trauer?“

Data: „Das ist korrekt.“

Timothy: „Wieso nicht?“

Data: „Mein positronisches Gehirn ist nicht fähig diesen Zustand zu erzeugen.“

Datas größter Wunsch ist es, menschlich zu werden, so versucht er im Laufe der Serie immer wieder, seinen menschlichen Freunden (besonders Geordi La Forge) durch Imitation von Gefühlsregungen wie Lachen bis hin zu körperlichen Notwendigkeiten wie Gähnen oder Schlafen ähnlicher zu werden. „Menschlich zu werden“ bedeutet in diesem Kontext ein menschliches Bewusstsein zu haben. Was ihm dazu fehlt, ist die Fähigkeit Gefühle zu haben.

Wünsche sind mit Emotionen verbunden. Ist es glaubhaft, dass Datas Streben nach Menschlichkeit nicht in einer bestimmten Gefühlslage/Gemütsverfassung wurzelt? Offensichtlich ist er mit den anfänglichen Umständen seiner Existenz nicht mehr zufrieden. Wie ist das möglich, wenn er nicht in der Lage ist, Gefühle zu empfinden? (Das gleiche Problem habe ich übrigens mit dem Blechmann in dem Märchen “Der Zauberer aus Oz”) Data ist zwar in der Lage zwischen einem Ist-Zustand und einem Soll-Zustand zu unterscheiden aber das Problem ist, dass das menschliche Bewusstsein kein definierter diskreter Zustand ist.

Die Frage, warum Data sich wünscht, ein menschliches Bewusstsein zu haben lässt sich meiner Meinung nach nur mit der Tatsache beantworten, dass Data durch Beobachtung den evolutionären Nutzen von Gefühlen erkannt hat: Gefühle lenken die Aufmerksamkeit. Gefühle verbessern das Gedächtnis. Gefühle steuern Verhalten so, das sie uns helfen unser Überleben zu sichern: Angst lässt uns von einem Fressfeind davon laufen, Aggression hilft uns unsere Nahrung oder unseren Nachwuchs, zu verteidigen. Zu den primären Emotionen zählt man: Glück, Staunen, Angst, Traurigkeit, Abscheu und Wut.

Der Mensch ist ein soziales Wesen: Gefühle sorgen dafür, dass wir die Nähe von anderen Menschen suchen oder sie möglichst weit von uns wissen möchten. Gefühle ermöglichen uns unser Verhalten für das Zusammenleben in der Gemeinschaft anzupassen. Gefühle sind die Voraussetzung für die Entwicklung von Moral. Zu den sozialen (sekundären) Emotionen zählen: Peinlichkeit, Eifersucht, Schuld, Schande, Stolz. Bloß ist der Nutzen für Data weitaus geringer als für den Menschen. Er vergisst nicht. Er muss nicht essen oder trinken. Er ist dem Menschen mental und physisch überlegen.

Geordi: “Es sind die Gefühle, die das menschliche Urteilsvermögen stören, die uns teilweise schrecklich verwirren, so daß wir uns selbst in Frage stellen. Aber sie sind wichtig, weil sie uns helfen die fehlenden Stücke eines Puzzles zu ergänzen, weil wir fast nie alle Tatsachen besitzen.”

Data: “Das heißt, der Entsprechende ergänzt die fehlenden Teile des Puzzles mit Hilfe seiner Persönlichkeit. Das führt zu einer Schlußfolgerung, die ebenso auf Instinkt und Intuition basiert, wie auf Fakten.”

Datas Erfinder Dr. Soong hat für Data einen Emotionschip entwickelt. Data setzt ihn in seinem positronisches Gehirn ein und versteht auf einen Schlag alle Witze und Pointen, die er jemals gehört hat. Sein Positronengehirn wird mit diesen ständigen „Lachanfällen“ überlastet und der Emotionschip verschmilzt fest in Datas Gehirn. (Er kann ihn jedoch noch an- und ausschalten.) Seine Handlungsfähigkeit ist nun so stark eingeschränkt, dass Geordi entführt werden kann. Daraufhin bittet Data den Captain darum, ihn vom Dienst zu befreien. Dieser lehnt die Bitte jedoch ab, sodass Data gezwungen ist, sich der neuen Situation anzupassen, und schließlich lernt, seine Gefühle unter Kontrolle zu halten.

Was jemand witzig findet, hängt nicht nur vom Verstehen sondern auch von seiner Persönlichkeit ab. Nehmen wir als Beispiel den folgenden Witz:

„Ich hätte gern einen Tee mit Rum.“

„Was? Um die Uhrzeit?“

„Sie haben recht. Lassen Sie den Tee weg.“

Ich kann über diesen Witz lachen (und gehöre damit vermutlich zu einer Minderheit) aber kann nicht erwarten, dass andere das auch tun. Da Data keine emotionalen Erfahrungen gemacht hat, ist es für mich schwer vorstellbar, dass er bereits eine individuelle menschliche Persönlichkeit hat. In dem Kontext macht es allerdings einen gewissen Sinn, dass er über alle Witze lacht, die er erzählt bekommen hat und nicht nur über einige.

Eine anderes Problem sehe ich in der zeitlichen Bindung von Emotionen, weil manche doch stärker an ein unmittelbares Erleben geknüpft sind als andere. Natürlich kann man einen Witz Jahre später witzig oder nicht mehr witzig finden aber z. B. bei sexueller Lust ist das schwerer vorstellbar. Jemand hat Sex und empfindet dabei keine Lust. Kann sich Wochen später, dadurch das aus dem motorischen/sensorischen Gedächtnis ein motorisch/sensorisch/emotionales Gedächtnis konstruiert wird, eine sexuelle Lust einstellen, die mit dem vorangegangenen sexuellen Akt assoziiert ist?

Data hat nun ein menschliches Bewusstsein und angeregt durch die Beobachtung, dass Menschen Kinder haben, erschafft Data sich seinen eigenen Nachkommen, den er auf den Namen Lal tauft. Der vorerst als Neutrum erschaffene Androide wählt die Form einer jungen menschlichen Frau, nachdem er mehrere Optionen abgewogen hat, und wird somit zu Datas Tochter. (Dieser Punkt könnte vielleicht Leute inspirieren die sich mit Gender-Studies beschäftigen.) Als die Existenz von Lal bekannt wird, tritt die Sternenflotte auf den Plan, die Lal als ihr Eigentum betrachtet und beschlossen hat, sie Data wegzunehmen. Das löst bei Lal eine Fehlfunktion aus, die sie in die Lage versetzt, Gefühle zu empfinden und gleichzeitig ihr positronisches Gehirn überlastet. Trotz aller Bemühungen kann Data sie nicht retten und sie stirbt. Data wird sehr traurig über den Verlust von Lal und sehr wütend auf die Sternenflotte sein. Wird er der Versuchung widerstehen seinen Emotionschip auszuschalten? Ich glaube ja

Inwiefern ist es ethisch gerechtfertigt Data Lal wegzunehmen? Auch hier kann man das Handeln der Sternenflotte nur aus einer evolutionären Perspektive verstehen. Wenn Androiden, die dem Menschen mental und physisch überlegen sind, nun beginnen sich selbst zu vervielfältigen entsteht und evolviert eine neue Spezies, die für den Menschen eine potenzielle Gefahr darstellt. Wie in dem Film “Terminator” fürchtet die Sternenflotte eine Herrschaft der Maschinen.

So, jetzt wisst ihr was René Descartes mit Arnold Schwarzenegger verbindet! 🙂

Weiterführende Links

Das wahre Leben simulierter Gehirne

Bildnachweis

Beschreibung: Data’s Kopf und andere Körperteile

Quelle: Ursprünglich auf Flickr gepostet Autor: Konrad Summers

Ort: Star Trek Ausstellung im Queen Mary Spruce Goose Dome, Long Beach California, Feb 2008

Datum: 20 February 2008

Lizenz: Creative Commons Attribution-Share Alike 2.0 Generic License

Nicht vergessem

… auch ‘Star Trek – der Film’ zK zu nehmen!

MFG

Dr. Webbaer (der ansonsten derartige Überlegungen gerne der Projektion bzw. dem Sichtfeld des Beobachters anvertrauen würde, die anthropogene Theoretisierung zu diesem Thema also als lokal betrachtend)

Spock und Data

Ein sehr interessanter Artikel. In der Tat hatte ich mir als Star-Trek-Fan schon vor Jahren Gedanken bezüglich der (Nicht-)Emotionen Datas gemacht, auch im Hinblick auf seinen Serienvorgänger Spock. Während Spock ja Emotionen kannte und diese lediglich beherrschte, waren Data solche Regungen (vor dem Emotionschip) völlig fremd. Spocks Beherrschung ist nachempfindbar, Datas Manko nicht. Das fehlen jeglicher Emotionen ist einem Menschen nicht möglich; auch der “Kälteste” wird Emotionen empfinden. Gibt es eigentlich Berichte über Menschen, bei denen das limbische System zerstört ist, in dem ja Emotionen und Triebverhalten verarbeitet werden? Da wäre doch interessant, inwieweit noch Emotionen wahr genommen werden bzw. Wünsche bezüglich Nachkommenschaft vorhanden sind.

Zu der ethischen Frage, inwieweit die Sternenflotte Lal als Eigentum betrachten kann, gab es in einer anderen Folge einmal ein interessantes Gerichtsverfahren, in dem es um die Existenz Datas ging (mit ähnlichem Eigentumsanspruch). Die fand ich damals auch ethisch sehr spannend.

Emotionen für Kommunikation nötig

Wie kann Data Emotionen vermissen, wem er sie nicht hat?

Ist dazu -um etwas zu bermissen – nicht bereits etwa wie Gefühl, Emotion nötig?

Ich vermute, dass man mit einer völlig emotionslosen Maschine nicht sinnvoll kommunizieren kann. Damit sie verstanden wird muss sie mindestens Emotionen vortäuschen.

@Martin Holzherr

Data hat es ja nicht vermisst sondern nur bemerkt, dass er keine Emottionen hat und deshalb Witze nicht versteht.

Ich bin nicht der Ansicht, dass man mit einer Maschine nicht kommunizieren kann. Logik ist ja durchaus kommunikationsfähig – etwa im Frage-Antwort-Spiel.

Frage

Ich bin kein Star-Trek-Experte, deshalb: Wie funktioniert eigentlich Datas Positronengehirn, gibt es da eine Software, oder funktioniert es von selbst, aus sich heraus, einfach aufgrund seiner inneren Architektur.

@Balanus

Auf diese Frage hätte sowohl der Drehbuchautor als auch der wissenschaftliche Berater geantwortet: “Danke der Nachfrage, es funktioniert hervorragend…” 😉

Aber soweit ich das verstanden habe, wurde ihm wohl eine Grundsoftware eingespielt, die sich selbständig weiterentwickelt.

Positronisches Gehirn

@Balanus Willst Du das wirklich wissen?;-)

Der Begriff positronisches Gehirn geht auf den Science Fiction-Autor Isaac Asimov zurück. Dabei handelt es sich um ein Computersystem, bei dem statt Elektronen Positronen zum Einsatz kommen. Es funktioniert von selbst ohne Software. Für die Handhabung der Positronen sind allerdings Hyperkristalle erforderlich. In allen Geräten, die auf hyperdimensionaler Basis funktionieren, dienen hyperaktive Schwingquarze, kurz Hyperkristalle genannt, in Wandlersystemen als Schnittstellen zwischen der fünfdimensionalen und der vierdimensionalen Seite. Nur durch sie können hyperenergetische Prozesse und Wirkungen eingeleitet, gesteuert und kontrolliert werden. Verschiedene Völker des Star Trek-Universums haben aber bereits auf die noch leistungsfähigere Syntronik umgestellt,die überlichtschnelle Berechnungen ermöglicht.

@WolfgangK, @Joe Dramiga

Danke für die erschöpfende Auskunft. Jetzt sehe ich klarer 🙂

Das Positronengehirn funktioniert also eher wie ein Menschengehirn, und nicht wie ein Computer. Das ist natürlich eine wichtige Frage, wenn es um Geist, Emotionen und Ethik geht.

Data ist also zu Emotionen fähig, als man ihm Lal wegnimmt. Fühlenden Wesen gegenüber gibt es ethische Verpflichtungen. Aber Data kann seine Emotionen ausschalten. Zudem: ist Data überhaupt ein “Wesen”? Bei Maschinen stellt sich die Frage nach der Ethik nämlich nicht. Knifflige Sache…

Btw: Wenn Maschinen sich selbst replizieren, dann “evolviert” mMn keine neue Spezies, zumindest nicht im darwinschen Sinne, hyperdimensionale Wandlersysteme hin oder her… 😉

Darf Data repliziert werden? @Balanus

“Wenn Maschinen sich selbst replizieren, dann “evolviert” mMn keine neue Spezies, zumindest nicht im darwinschen Sinne…”

In einer Folge sollte Data einmal auseinandergenommen werden, weil ein Computerexperte das Geheimnis von Datas Funktionsweise lüften will, aber Data will nicht demontiert werden. “Der Wissenschafter argumentiert, dass Data eine Maschine sei und deshalb nicht mehr Recht habe, seine Demontage zu verweigern, als ein Toaster. Captain Picard argumentiert dagegen, dass Data empfindungsfähig sei und deshalb dieselben Rechte besitze wie ein Mensch. Eine schwierig zu begründende Behauptung, denn schliesslich ist Data eine Maschine. Aber zuletzt findet Picard doch noch ein Argument, um das Gericht umzustimmen: Wenn Datas Konstruktionsgeheimnis enthüllt werde, würde dies zur Schaffung einer Rasse von androiden Sklaven führen; das jedoch sei aus ethischen Gründen verwerflich.”

Siehe hier: http://www.nzzfolio.ch/…1-a914-5fad24b282ea.aspx

@Balanus/Wesen

Wenn ich die philosophische Wikipedia-Definition von “Wesen” richtig verstanden habe, lässt sie sich auch auf Maschinen anwenden. Und wenn Data fühlt ergeben sich daraus bestimmte ethische Verpflichtungen ihm gegenüber. Die Spezies evolviert nicht im darwinschen Sinne, da muss ich Dir recht geben, aber sie wird verändert. Es ist sogar so, dass man bei Data und seinen Vorgängern von Intelligent Design sprechen muss.

@Mona/Rechte

Data hat von der Sternenflotte die Zivilrechte bekommen. Menschenrechte hat er wahrscheinlich deshalb nicht bekommen, weil er kein Mensch ist. Ich glaube der Tierrechtler Peter Singer würde Data sogar den Status einer Person geben, da er über Schmerzempfindung,Selbstbewusstsein und einen Sinn für die Zukunft verfügt.

@Joe Dramiga /Wesen

“Das Wesen (gr. ousia, lat. essentia, quidditas) bezeichnet die Eigenschaften, die ein bestimmtes Ding notwendig haben muss, wenn es existiert. “

Falls Du diese Wikipedia-Definition meinst, dann liegst Du mit Deiner Annahme wohl falsch, dass der Begriff “Wesen” auch Maschinen anwendbar ist. Das Wesen einer Maschinen ist etwas anderes als das Wesen eines Wesens, also Lebewesens.

Nun hätte ich ja kein Problem damit, Lebewesen als Biomaschinen aufzufassen und die ethischen Konsequenzen zu akzeptieren, die sich daraus für empfindungsfähige abiotische Maschinen ergeben würden.

Aber wenn die abiotische Maschine seine Empfindungsfähigkeit per Knopfdruck abschalten kann, dann haben wir doch eine ganz andere Situation. Woher können wir denn überhaupt wissen, ob Datas Positronengehirn tatsächlich Schmerz und Leid empfindet und diese Empfindungen nicht nur simuliert?

@Mona /Androiden

»Aber zuletzt findet Picard doch noch ein Argument, um das Gericht umzustimmen: Wenn Datas Konstruktionsgeheimnis enthüllt werde, würde dies zur Schaffung einer Rasse von androiden Sklaven führen; das jedoch sei aus ethischen Gründen verwerflich. «

Das kann ich nun überhaupt nicht nachvollziehen. Wenn die Empfindungsfähigkeit Datas kein Argument ist, um dessen Demontage zu verhindern, wie kann dann die Empfindungsfähigkeit ein Argument sein, um den Bau weiterer Datas zu verhindern? Können Maschinen überhaupt “Sklaven” sein?

(Fragen über Fragen, aber danke für den aufschlussreichen Link :-))

The measure of a man

So heißt diese Episode übrigens. Ich erinnere mich anders an ihren Schluß (und habe die DVD gerade nicht zur Hand). Louvois, die Richterin, hält die Frage, ob Data Persönlichkeitsstatus habe, für nicht positiv entscheidbar. Sie hält allerdings die Konsequenzen einer möglichlicherweise falschen Entscheidung für den Fall, daß Data ein Lebewesen ist, für nicht akzeptabel. Daher: In dubio pro bio.

Hier eine Episodenbeschreibung:

http://www.startrek-index.de/tv/tng/tng2_9.htm

Balanus: “Aber wenn die abiotische Maschine seine Empfindungsfähigkeit per Knopfdruck abschalten kann, dann haben wir doch eine ganz andere Situation. Woher können wir denn überhaupt wissen, ob Datas Positronengehirn tatsächlich Schmerz und Leid empfindet und diese Empfindungen nicht nur simuliert?”

Woher wissen wir das von uns selbst, daß unsere Empfindungen nicht simuliert sind, innerhalb einer Matrix z.B.?

Und auch unsere Empfindungsfähigkeit kann man per Knopfdruck abschalten, indem man einen Menschen ins künstliche Koma versetzt. Niemand käme aber wohl auf die Idee, Komatösen die Persönlichkeitsrechte abzusprechen.

Und selbstverständlich lebt die Episode davon, daß jeder Trekker, auch ich, Data einfach liebt und emotional hundertprozentig auf seiner Seite steht.

Datas Emotionen

Zwar habe ich alle Folgen gesehen, aber das ist schon lange her. Insofern verblieben einige unbestimmte Fragezeichen in Bezug auf den Blog-Artikel, welche mir nun nach und nach einfallen. Datas Emotionen bspw. waren bis zum Kino-Film “Der erste Kontakt” nicht vollständig (und blieben es auch weiterhin); er konnte keineswegs körperlich fühlen, denn dies wurde ihm erst durch die Borg-Queen beschert, und das auch nur als “Ausschnitt” des gesamten Spektrums, nämlich ein bestimmtes Gefühl auf der Haut.

http://de.memory-alpha.org/…k:_Der_erste_Kontakt

Insofern war Data als Maschine dem Menschen nie wirklich gleichwertig. Wie wichtig dieser Punkt ist sieht man daran, dass viele unsere Emotionen durch äußere Einflüsse ausgelöst werden. Auch nach Einbau des Emotionschip hat Data immer noch keinen Hunger oder Durst, friert nicht, empfindet keine Schmerzen, altert nicht und weiss nicht, wie man sich bei Krankheiten fühlt. Auch durch die Erfahrungen bei der Borg-Queen wird´s nicht viel besser; die Möglichkeiten des Empfindungsspektrums bleiben für Data stark eingeschränkt.

Was also hat der Emotionschip für einen Zweck ausser Witze zu verstehen? Er kann ohne all die körperlichen Empfindungen demzufolge nicht einmal den Wunsch entwickeln, sich fortzupflanzen; es wäre eine für ihn immer noch unverständliche Situation, es sei denn, die Vorstellung wäre ihm als fertige Datenbank-Version eingespielt worden…

Soweit ich weiss, wurden Data von Geordi öfter mit Programm- oder Daten-Updates gefüttert; insofern bin ich mir nicht sicher, ob die Star-Trek-Autoren Datas Positronengehirn konsequent im Sinne Asimovs verstanden haben; immerhin ist die Serie ja grundsätzlich als Unterhaltungsserie zu verstehen und muss deshalb nicht immer schlüssig sein.

Wesen=Lebewesen

@Balanus Ich habe das eben nicht nur im Sinne Wesen=Lebewesen sondern wesentlich breiter verstanden. Ein Roboter lebt nicht aber er existiert.

@Jürgen:

»Und auch unsere Empfindungsfähigkeit kann man per Knopfdruck abschalten, indem man einen Menschen ins künstliche Koma versetzt. Niemand käme aber wohl auf die Idee, Komatösen die Persönlichkeitsrechte abzusprechen.«

Das stimmt. Die vorhandene oder fehlende Empfindungsfähigkeit scheint kein gutes Kriterium für die Zu- oder Aberkennung von Persönlichkeitsrechten zu sein. Zumindest nicht bei Wesen, die leben.

Aber dieses Data genannte Dingens, dieses Tamagotchi für Erwachsene, lebt ja nicht, es existiert bloß. Auch wenn sein Positronengehirn leistungsfähiger ist als das Elektronengehirn von HAL, und beide leistungsfähiger sind als ein Menschengehirn (zumindest in Teilbereichen), es ist und bleibt ein technisches Produkt menschlichen Erfindungsgeistes (in jeder Beziehung).

Täusche ich mich, oder sind die StarTrek-Autoren doch sehr darauf bedacht, immer wieder herauszustellen, dass ein Mensch auf jeden Fall wertvoller ist als ein Androide, und sei er auch noch so intelligent? Dass letzterem eben das entscheidend menschliche Attribut fehlt, die Seele? Oder wie soll man das sonst verstehen, dass man mit einer Vervielfältigung Datas eine neue “Rasse” schaffen würde, welche dann, was sonst, dem Menschen als “Sklaven” dienen würde.

@WolfgangK:

»…immerhin ist die Serie ja grundsätzlich als Unterhaltungsserie zu verstehen und muss deshalb nicht immer schlüssig sein.«

So isses! 🙂

(Ich hoffe, ich habe hier niemandes Gefühle verletzt… ;-))