Die Schätzung des Todeszeitpunkts mithilfe des Nekrobioms und Machine Learning

Tatortfans wissen es: Wenn der Kommissar in einem Mordfall oder unklaren Todesfall ermittelt, ist seine erste Frage “Wann”? Denn diese wichtige Information wirkt sich auf die gesamte Ermittlung aus. Das Einsetzen der Leichenstarre und die Körpertemperatur der Leiche können nur ein paar Stunden nach dem Tod bei der Schätzung des Todeszeitpunkts helfen, doch manchmal werden Leichen erst nach Tagen oder sogar Wochen gefunden. Um die Liegezeit und damit den Todeszeitpunkt eines verwesenden Körper einzuschätzen, müssen sich die Ermittler auf andere Indikatoren stützen.

In einer Studie [1], die in der Fachzeitschrift PLoS ONE erschien, hat sich ein Team von Forensikern um Nathan H. Lents vom John-Jay-College für Strafjustiz an der City University von New York (CUNY) deshalb dem Nekrobiom, der Ansammlung von Bakterien auf einer Leiche zugewandt, um den Todeszeitpunkt zu bestimmen. Wenn forensische Wissenschaftler wissen, welche Bakterien eine Leiche besiedeln wann und wie lange, können sie diese Technik nutzen, um den Zeitpunkt des Todes oder andere Aspekte eines Tatorts zu bestimmen.

Das Metagenom der Bakterien einer Leiche

Die Forensiker untersuchten Bakterien aus den Ohr- und Nasenkanälen von 21 Leichen1 über mehrere Wochen hinweg. Sie sammelten bakterielle Proben von Leichen, die an der Anthropological Research Facility (ARF) der Universität von Tennessee in Knoxville platziert waren. Das Gelände der ARF ist ein konservierter gemäßigter Laubwald mit gut durchlässigen fein strukturierten tonigen Böden. Alle Leichen wurden auf der Erdoberfläche platziert und konnten sich auf natürliche Weise zersetzen.

Die Bakteriologen analysierten das Metagenom dieser Bakterien. Das Metagenom stellt die Gesamtheit der genomischen Information der Mikroorganismen eines Lebensraums zum Zeitpunkt der Untersuchung dar. Die metagenomische Analyse ermöglicht die Identifizierung und Quantifizierung von Bakterien, auch wenn sie nicht kultivierbar sind.

Für die metagenomische Analyse benutzen die Wissenschaftler das 16S rRNA-Gen. Dieses Gen kommt in allen Bakterien vor. Es enthält einige konservierte DNA-Sequenzen, die bei allen Bakterien gleich sind. An ihnen lässt sich das Gen erkennen. Das 16S rRNA-Gen besitzt aber auch variable DNA-Sequenzen, die sich im Laufe der Evolution stark verändert haben. Sie ermöglichen es, die Bakterien voneinander zu unterscheiden.

Die Forscher isolierten die DNA aus den Bakterien und sequenzierten anschließend mit Next Generation Sequencing2 (NGS) die 16S rRNA-Gene der Bakterien. Mit NGS können Tausende bis Millionen DNA-Sequenzen gleichzeitig und in Echtzeit analysiert werden. Dies wird durch die Fixierung eines DNA-Einzelstrangs an einer Oberfläche ermöglicht, beispielsweise kleiner Kügelchen (beads) oder einer Glasoberfläche ähnlich der DNA-Chips. Dieser DNA-Einzelstrang wird anschließend vervielfacht. Die Sequenzierung erfolgt lokal begrenzt an der besagten Oberfläche und bleibt an ihr gebunden. Dadurch können parallel Tausende bis Millionen DNA-Sequenzen gleichzeitig praktisch im selben Volumen synthetisiert werden. Die aus den bakteriellen Proben gewonnenen 16S rRNA-Sequenzen wurden dann mit einer Datenbank verglichen, um die Identität der Bakterien und ihre Häufigkeit in den Proben zu bestimmen.

Machine Learning erkennt Muster in der zeitlichen Veränderung des Metagenoms

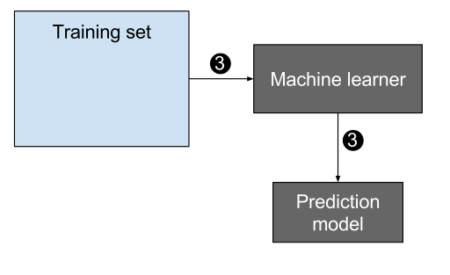

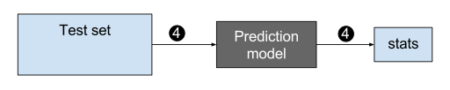

Mit diesem sehr großen Datensatz (Big Data3) der 16S rRNA-Sequenzen haben die Bioinformatiker ein maschinelles Lernverfahren (Machine Learning) trainiert, um zu herauszufinden, wie sich die Bakteriengemeinschaften verändern, während sich die Körper zersetzen. Mithilfe des maschinellen Lernens sind Computer in der Lage, auf Basis vorhandener Datensätze und Algorithmen Muster und Gesetzmäßigkeiten zu erkennen und Lösungen zu entwickeln. Damit die Software eigenständig lernen und Lösungen finden kann, müssen die Bioinformatiker einiges vorbereiten: Beispielsweise muss die Software zunächst mit den für das Lernen relevanten Daten und Algorithmen versorgt werden. Zudem sind Regeln für die Analyse der Daten und das Erkennen der Muster aufzustellen. Sind passende Daten vorhanden und Regeln definiert, können Computer mit maschinellem Lernen Vorhersagen auf Basis der analysierten Daten treffen.

Durch wiederholtes Testen und Optimieren dieses Lernverfahrens erstellten die Forscher ein statistisches Modell, das den Todeszeitpunk unbekannter Proben auf 55 akkumulierte Gradtage oder etwa zwei Tage im Sommer vorhersagt. Dieser Grad an Genauigkeit hält sich über mehrere Wochen der Zersetzung, eine wesentliche Verbesserung gegenüber den derzeit verfügbaren Methoden.

Fußnoten

1. Die Verwendung von Verstorbenen bei der ARF erfordert keine Internal Review Board (IRB)-Genehmigung, da die Körper für Forschungszwecke an die Einrichtung gespendet wurden. Darüber hinaus wurde diese Untersuchung vom IRB der City University of New York genehmigt.

Der IRB ist ein Verwaltungsorgan, das eingerichtet wurde, um die Rechte und das Wohlergehen von Personen, die an wissenschaftlichen Studien/Experimenten teilnehmen, zu schützen. (In den US-amerikanischen Vorschriften sind mehrere Kategorien von Forschungsbereichen aufgeführt, die als von der IRB-Aufsicht ausgenommen gelten.) Jede Institution, die solche Studien/Experimente durchführt muss ein IRB haben. Dem IRB obliegt die Verantwortung, alle Forschungsarbeiten (mit oder ohne Finanzierung), an denen Menschen beteiligt sind, vor ihrem Beginn zu überprüfen. Der IRB befasst sich mit dem Schutz des Wohlergehens, der Rechte und der Privatsphäre von Menschen in Studien/Experimenten. Der IRB ist befugt, Änderungen an allen Forschungsaktivitäten zu genehmigen, abzulehnen, zu überwachen und zu verlangen, die in seine Zuständigkeit fallen, wie in den Bundesvorschriften und der institutionellen Politik festgelegt.

Der IRB muss aus mindestens fünf Mitgliedern mit unterschiedlichem Hintergrund bestehen, um eine vollständige und angemessene Überprüfung der menschlichen Forschung und ihrer institutionellen, rechtlichen, wissenschaftlichen und sozialen Auswirkungen zu ermöglichen. Der Vorstand wird auch mindestens ein Mitglied, das nicht mit der Institution verbunden ist, und ein Mitglied, das kein Wissenschaftler ist, einschließen. Der IRB hat mehrere Berater, die den Vorstand beraten und regelmäßig an der Überprüfung des Protokolls beteiligt sind. Im IRB sollen Frauen und Männer vertreten sein.

2. Über 30 Jahre lang benutzten Genetiker die Sanger-Sequenzierung durch das Kettenabbruchverfahren: dabei erfolgt in einer Reaktion die Sequenzierung eines DNA-Einzelstrangs mit bis zu 800 Basenpaaren durch Kettenabbrüche und elektrophoretische Auftrennung der unterschiedlich langen DNA-Einzelsträmge. Nach einer Sanger-Sequenzierung erhalten die Wissenschaftler eine einzige DNA-Sequenz. Ein Sequenzierroboter erreicht je nach Modell etwa 100 kb pro Tag. In den großen Labors standen 20 und mehr dieser Sequenzierroboter nebeneinander, um einen höheren Durchsatz zu erlangen. Mit NGS kommt ein Genetiker in einem kleinen Ansatz bereits auf circa 20 Millionen DNA-Sequenzen.

3. Big Data ist alles das, was mit herkömmlicher IT aufgrund der Größe der Daten nicht mehr funktioniert, d. h. etwa große Datenmengen zu erfassen, zu speichern, zu durchsuchen, zu verteilen, zu analysieren und zu visualisieren. Klassische Datenbanken können das nicht liefern, da sie Datensatz für Datensatz sämtliche relevanten Felder durchsuchen müssen. Auch setzen verschiedenartige Informationstypen, etwa Texte, numerische Informationen oder Bilder ein Big-Data-System voraus. Gerade bei Big Data kann Machine Learning seine Trümpfe ausspielen.

Weiterführende Literatur

Zeig mir deine Gene und ich sag dir, was du frisst

Ja, Machine Learning, z.B. Deep Learning, kann oft auf beängstigend gute Art einen sehr komplexen, verrauschten Input auf einen diskreten Output abbilden ( hier ist der diskrete Output die Anzahl Tage seit dem Tod).

Es gibt eine Unzahl von Einsatzgebieten für solche Input/Output-Mappings nur schon für DNA-Sequenzen als Input. Ich würde zum Beispiel erwarten, dass man mit Machine Learning einer mensclichen DNA das am besten zu ihr passende Gesicht zuordnen kann. Und ja, je mehr DNA-Sequenzen von Individuen man hätte, umso besser das Mapping, das Resultat.

Der Einsatz statistischer Verfahren der Forensik kann für die Richterschaft nur ergänzend berücksichtigt werden.

“Big Data” ist vor allem ein Buzzword, das hochleistungsfähige heutige Datenverarbeitungssysteme meint, die an sich nichts Neues darstellen.

Aber auf Grund der heutzutage zur Verfügung stehender hochleistender Rechner, auf Grund hochleistender Datenspeicherung und auf Grund hochleistender Abfrage-Sprachen sozusagen Quantensprünge darstellen.

Beim sogenannten Machine- oder Deep-Learning ist Dr. Webbaer unter-informiert, vielleicht hat es ja von ihm bisher unerkannt gebliebene Fortschritte in der diesbezüglichen Algorithmik gegeben.

MFG

Dr. Webbaer

@Dr. Webbaer (Zitat): Beim sogenannten Machine- oder Deep-Learning ist Dr. Webbaer unter-informiert, vielleicht hat es ja von ihm bisher unerkannt gebliebene Fortschritte in der diesbezüglichen Algorithmik gegeben. Ja, diese Fortschritte hat es gegeben und sie haben sich in den späten 1990er Jahren darin gezeigt, dass es deep-Learning Programmen erstmals gelang, die Tiere in einer einer grossen Sammlung von Tierbildern (wobei die Tiere in allen möglichen Lebenslagen abgebildet sind). zuverlässiger zu bennen als selbst Tierkundler es vermögen.

Eine gute Einführung in die Fähigkeiten und Probleme des deep Learning gibt Gary Marcus im arxiv-Artikel Deep Learning: A Critical Appraisal

Deep-Learning könnte so funktionieren, dass (von Erkenntnissubjekten) klar umrissene Aufgaben bearbeitet werden, die in sogenannten Neuronalen Netzwerken von Algorithmik unterschiedlichem Bestands bearbeitet wird, so dass diese unterschiedlich leistet und eine Entscheider-Funktionalität hier bewertet und bedarfsweise aussortiert, um am besten automatisiert neue Algorithmik (und sich natürlich wiederum unterscheidend) zu erstellen, die dann erneut wie geschildert im Rahmen eines sogenannten Neuronalen Netzwerks geprüft wird.

Wobei es hier natürlich “einige” Probleme gibt, der helfende Eingriff erkennender Subjekte erwartet bleibt, also von Dr. Webbaer, wenn sich die ganze “Chose” in ungünstige Richtung aufmacht, sozusagen.

Ginge dies so I.E. im Allgemeinverständnis, Herr Holzherr?

@Dr.Webbaer: Im Kern funktionieren tiefe neuronale Netzwerke (die Deep-Learning ermöglichen) so, dass jedes Neuron für mehrere Eingabesignale ein (oder auch mehrere) Ausgabesignal(e) erzeugt, falls die Summe der Eingabesignale einen gewissen Schwellwert überschreitet. Die Algorithmik von der sie sprechen funktioniert so, dass man für jedes Neuron den Schwellwert so einstellt, dass schliesslich das gewünschte Verhalten resultiert. Tief nennt man die Netzwerke, weil sie aus mehreren Schichten bestehen. Die niederen Schichten, die unmittelbar auf den Sinneskanalinput (beispielsweise die Pixel eines Bildes) folgen “erkennen” kleinräumige Bildfeatures wie Kanten, Ecken, Einzelpunkte, etc. die höheren fügen dann diese Elemente zu grösseren Komplexen zusammen und so weiter und so fort, bis dann der letzte Output beispielsweise sagt: “Das ist ein Elephant”.