Teilnehmerzahl Science March: Heidelberger Datenpunkt

BLOG: RELATIV EINFACH

Gestern war also der Science March, und das in mehr als 500 Städten weltweit. (Warum ich mitgemacht habe, hatte ich hier erklärt.) Für mich war die wichtigste Botschaft der verschiedenen Märsche, wieviele Menschen das Themenfeld alternative Fakten, angemessene Berücksichtigung wissenschaftlicher Erkenntnisse, Rolle der Wissenschaft in unserer Gesellschaft so wichtig finden, dass sie dafür auf die Straße zu gehen bereit sind. (Diese Zahl hängt natürlich auch davon ab, wieviele Menschen eine solche Demonstration als geeignetes Mittel sehen, auf das Thema aufmerksam zu machen.)

Gestern war also der Science March, und das in mehr als 500 Städten weltweit. (Warum ich mitgemacht habe, hatte ich hier erklärt.) Für mich war die wichtigste Botschaft der verschiedenen Märsche, wieviele Menschen das Themenfeld alternative Fakten, angemessene Berücksichtigung wissenschaftlicher Erkenntnisse, Rolle der Wissenschaft in unserer Gesellschaft so wichtig finden, dass sie dafür auf die Straße zu gehen bereit sind. (Diese Zahl hängt natürlich auch davon ab, wieviele Menschen eine solche Demonstration als geeignetes Mittel sehen, auf das Thema aufmerksam zu machen.)

Wieviele waren denn nun da?

Insofern: Klar, es gab Ansprachen und Grußworte, es gab eine Vielzahl zum Teil sehr kreativer Schilder, aber für mich sind derzeit die Teilnehmerzahlen mit am interessantesten. (Danach wird dann am interessantesten, was als nächstes passiert – dass eine Demonstration nur der Anfang sein kann und das Engagement weitergehen muss, wenn der Science March etwas bewirken will, war ja eine zu recht häufig geäußerte Ansicht.)

Science March Germany meldete jedenfalls gestern noch:

37,217 participants in Germany, including 67 from @ScienceMarchHGL! #MarchforScience #ScienceMarchGER #yesweregermans #letsbeprecise

— ScienceMarch Germany (@ScienceMarchGER) 22. April 2017

OK, zugegeben: statt einer so pseudogenauen Zahl hätte ich gerne Fehlergrenzen gesehen. Aber der Tweet war ja offenbar eher salopp gemeint (“Yes, we’re Germans. Let’s be precise”).

Andererseits ging es ja gerade um Wissenschaftlichkeit, um Fakten statt Vermutungen; darum, Behauptungen nicht einfach zu glauben sondern nachzuprüfen.

Science March Heidelberg: 1800 Teilnehmer

Die Organisatoren in Heidelberg sind jedenfalls auf 1800 Teilnehmer gekommen:

Nach fleissigem Zählen kommen wir auf 1.800 Teilnehmer. Wer möchte zählt mit + sagt Bescheid! @mpoessel @ScienceMarchGER #marchforscience pic.twitter.com/or5ih85ceK

— ScienceMarchHD (@ScienceMarchHD) 22. April 2017

Und ja, das wollte ich in der Tat nachprüfen.  Man kann ja schlecht ein Schild herumtragen, wie ich es beim Science March Heidelberg dabei hatte, und dann die Teilnehmerzahl einfach so glauben. Siehe Bild rechts. (Das obere Schild meine ich; das untere trage ich zu dem Zeitpunkt gerade für meinen Sohn.)

Man kann ja schlecht ein Schild herumtragen, wie ich es beim Science March Heidelberg dabei hatte, und dann die Teilnehmerzahl einfach so glauben. Siehe Bild rechts. (Das obere Schild meine ich; das untere trage ich zu dem Zeitpunkt gerade für meinen Sohn.)

Und hey, wenn der Science March insgesamt mehr Menschen dazu anregt, Behauptungen nachzuprüfen, die man sonst einfach hinnimmt, dann hat er schließlich schon Wichtiges bewirkt!

Ich hatte daher über Twitter schon recht früh angefragt, ob es nicht möglich wäre, ein entsprechendes Bild des Gesamtmarsches in möglichst hoher Auflösung zu bekommen. Die örtlichen Verhältnisse waren ja auch durchaus günstig: Die Abschlusskundgebung fand auf den Stufen der Neuen Universität statt, und aus dem Unigebäude heraus hatten Fotografen die Möglichkeit, den gesamten Uniplatz zu fotografieren.

Entsprechende Bilder, von denen ich den Eindruck hatte, dass sie so ziemlich die gesamte Menge erfassten, waren auf Twitter auch schon zu sehen gewesen.

Science March Heidelberg: The Recount

Insbesondere hat mir dann freundlicherweise Jona Paul Krämer, der solche Übersichtsbilder geschossen hatte, eine Reihe hilfreicher Bilddateien überlassen. Hier ist eine verkleinerte Form des großen Bilds, das ich dann letztlich verwendet habe:

Das ganze ist ein Panoramabild, aufgenommen mit einer Sony alpha 6000 (24MP). Yay Science und Digitaltechnologie! Die Auflösung des Bildes finde ich beeindruckend. Ich selbst war relativ weit hinten, im oberen Drittel des obigen Bildes, bin aber auf einem entsprechenden Ausschnitt samt Schild gut zu erkennen:

Kommen wir damit zum Methodenteil:

Wie nachzählen?

Man kann sich beim Zählen ja herrlich verheddern. Mir war daher relativ rasch klar, dass ich das Zählen selbst würde automatisieren müssen – Computer sind ja sehr gut bei so etwas. Diejenige Software, die ich zur Verfügung habe, ist allerdings grottenschlecht dabei, in einem solchen Übersichtsbild zu identifizieren, welche und wieviele Menschen man da so sieht. Darin, nämlich in der Mustererkennung, ist aber wiederum das menschliche Gehirn sehr gut.

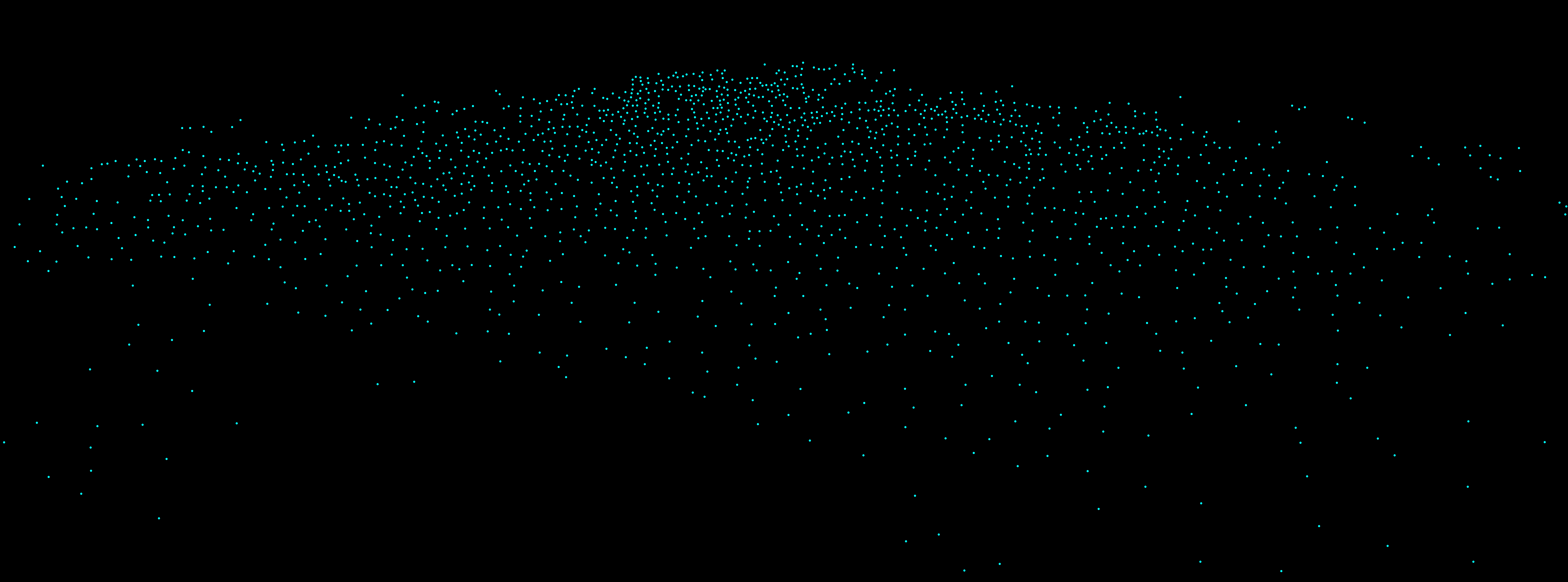

Mein Kompromissverfahren war daher: Ich habe mir das Bild bei guter Vergrößerung in dem Bildverarbeitungsprogramm Gimp angeschaut und dann per Hand auf einer gesonderten Bildebene einen türkisen, 10 Pixel großen Kreis auf jeden Menschen gesetzt, den ich eindeutig als solchen erkannt habe – meist direkt auf das Gesicht, manchmal (Gesicht hinter Transparent verborgen, Körper sichtbar) anderswohin. Das ging recht schnell – tip, tip, tip, tip, jede Identifikation nur ein Mausklick. Hier ist das Ergebnis:

Die Teilnehmer weiter vorne erscheinen im Bild natürlich größer als die weiter hinten. Insofern sieht man vorne die Punkte auch nicht so gut; hinten sind sie dichter gedrängt:

Für die Auswertung habe ich dann nur die Bildebene mit den Punkten verwandt. Hier ist sie schwarz hinterlegt:

Den Rest konnte der Computer erledigen. Die schwarzen Flächen im Bild haben den RGB-Farbwert 0,0,0. Ich habe ein kleines Skript die RGB-Werte aller Pixel in diesem Bild zusammenzählen lassen und diese Summe durch die RGB-Summe geteilt, die ein einzelner türkiser Vollkreis enthält. Das Ergebnis ist die Zahl der türkisen Vollkreise in diesem Bild, und damit die Zahl der identifizierbaren Menschen. Mein Skript sagt: 1767. Also in guter Näherung dasselbe wie die offizielle Schätzung.

Den Rest konnte der Computer erledigen. Die schwarzen Flächen im Bild haben den RGB-Farbwert 0,0,0. Ich habe ein kleines Skript die RGB-Werte aller Pixel in diesem Bild zusammenzählen lassen und diese Summe durch die RGB-Summe geteilt, die ein einzelner türkiser Vollkreis enthält. Das Ergebnis ist die Zahl der türkisen Vollkreise in diesem Bild, und damit die Zahl der identifizierbaren Menschen. Mein Skript sagt: 1767. Also in guter Näherung dasselbe wie die offizielle Schätzung.

Ist das eine hundertprozentig zutreffende Zahl? Wer sich die Punkte anschaut, insbesondere mit dem Hintergrundbild zusammen, wird sehen, dass es einige Grenzfälle gibt. Die Menschen, die direkt rechts hinten in unmittelbarer Nähe der Menge auf der Bank setzen, waren das Teilnehmer? Ich habe sie mitgezählt. Die anderen Menschen weiter hinten, deutlich getrennt von der Menge und ohne direkten Bezug (z.B. andere Blickrichtung, beim Gehen) habe ich nicht mitgezählt. Bei nochmaliger Inspektion der Randgebiete zähle ich 7 Personen, die ich mitgezählt habe, die aber Grenzfälle sind und eventuell gar nicht dazugehörten. Mein Minimum liegt damit bei 1760.

Extrapolieren

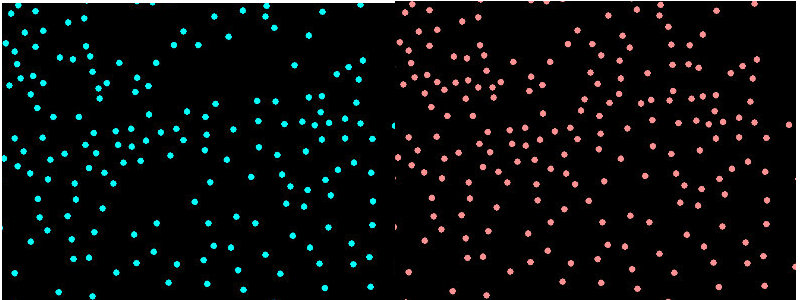

In einigen anderen Bildteilen sieht man allerdings, dass der tatsächliche Wert größer ist als dieser Minimalwert. Die Menschen wurden zum Teil schlicht durch größere Schilder verdeckt. Hier ist ein Ausschnitt, auf dem man das sieht: links das Foto mit Punkten, rechts nur die Punkte:

Ich treffe jetzt die Annahme, dass die Menschenverteilung hinter den Schildern ungefähr genau so ist wie in der direkten Nachbarschaft. Als einfachste Form der Extrapolation habe ich schlicht die Punktverteilung in der direkten Nachbarschaft kopiert und dann, copy-and-paste, in die Aussparungen hineingeklebt, wo aufgrund der Schilder nichts zu sehen war. Hier das Original (links, türkis) und die per Hand extrapolierte Verteilung (rechts, rot) für den obigen Bildausschnitt im direkten Vergleich:

(Warum ich die rechts oben noch deutlich sichtbaren Lücken nicht aufgefüllt habe? Ein Blick auf den Bildausschnitt, ein Bild weiter oben, zeigt, dass das tatsächlich Lücken waren, keine Menschen, die durch Schilder verdeckt waren.)

(Warum ich die rechts oben noch deutlich sichtbaren Lücken nicht aufgefüllt habe? Ein Blick auf den Bildausschnitt, ein Bild weiter oben, zeigt, dass das tatsächlich Lücken waren, keine Menschen, die durch Schilder verdeckt waren.)

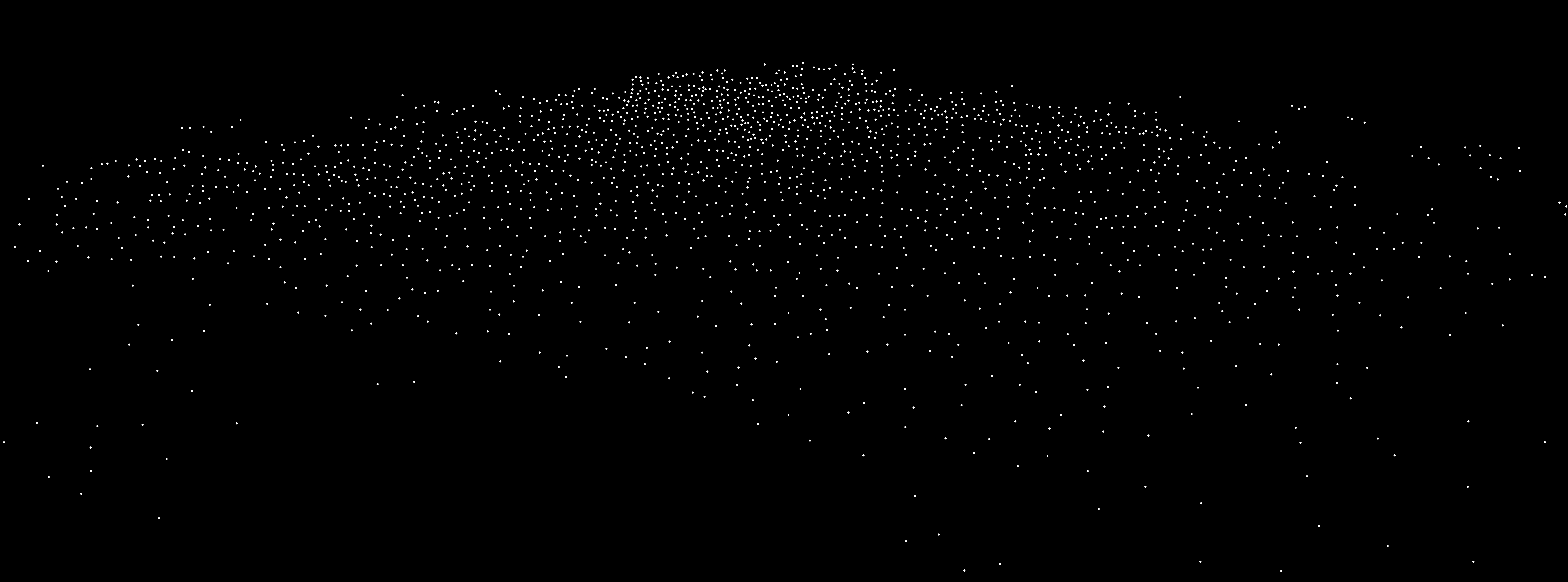

Das Ergebnis war die folgende Punktverteilung (hier weiß statt rot nach einem Bearbeitungsschritt [Threshold], der die Kreise wieder gestochen scharf – Pixel eindeutig schwarz oder eindeutig weiß – gemacht hat). Das sind jetzt also nicht nur identifizierbare Menschen, sondern auch Extrapolationen hinter Schildern:

Das Skript zählt auf diesem Bild 1834 weiße Kreise. (Genauer betrug der Wert 1834,5767 – ein bisschen scheint mein Schema durch das Umfärben doch in Mitleidenschaft gezogen worden zu sein. Für eine wissenschaftliche Veröffentlichung müsste man auch diesem Fehler nachgehen und ihn verstehen.)

Das Skript zählt auf diesem Bild 1834 weiße Kreise. (Genauer betrug der Wert 1834,5767 – ein bisschen scheint mein Schema durch das Umfärben doch in Mitleidenschaft gezogen worden zu sein. Für eine wissenschaftliche Veröffentlichung müsste man auch diesem Fehler nachgehen und ihn verstehen.)

Dazu kamen noch die Menschen, die aus der Perspektive des Fotografen nicht sichtbar waren, weil sie nahe am Gebäude standen – dazu gehörte die Band Balsamico von Peter Saueressig, die für die Musik sorgte. Ich habe zum Vergleich mal ein selbstgemachtes Foto herangezogen, das ich aus der Menge in Richtung Bühne gemacht hatte:

Vergleiche ich das mit dem großen Foto, dann sind die Redner (rechts im Bild) sogar fast vollständig in der Übersicht zu sehen. Mindestens 6 Personen kommen aber noch hinzu; meine endgültige Schätzung beläuft sich daher auf 1830 bis 1840 Personen. Der offizielle Wert der Veranstalter, 1800 Teilnehmer, ist damit gut belegt und eher noch konservativ-vorsichtig.

Vergleiche ich das mit dem großen Foto, dann sind die Redner (rechts im Bild) sogar fast vollständig in der Übersicht zu sehen. Mindestens 6 Personen kommen aber noch hinzu; meine endgültige Schätzung beläuft sich daher auf 1830 bis 1840 Personen. Der offizielle Wert der Veranstalter, 1800 Teilnehmer, ist damit gut belegt und eher noch konservativ-vorsichtig.

Warum der Aufwand?

War das jetzt zuviel des Aufwands für eine einzige Demonstration? Ich finde nicht. Wieviele Menschen beim Science March Heidelberg waren, ist eine einigermaßen gut definierte Frage. Es ist sicher keine eindeutig definierte Frage – manche Teilnehmer sind früher gegangen, andere später dazu gekommen. Aber wenn man die Frage etwas präzisiert, etwa wie hier auf einen Moment recht früh bei der Abschlusskundgebung, dann kann man mit den verfügbaren Daten eine nachvollziehbare und sichere Antwort bekommen.

Dass mindestens 1767 Menschen da waren, ist eine Tatsache, ein Fakt. Soviele Menschen lassen sich auf dem Foto identifizieren.

Einige Kollegen haben im Vorfeld des Science March beklagt, schon die Vereinfachung von “Fakten” vs. “alternative Fakten” sei eigentlich unwissenschaftlich; ebenso mindestens einer der Musterslogans, die für den Science March im Umlauf waren:

Das sehe ich zwiespältig. Einerseits: in der Tat, wer behauptet, es gebe eine einzige wahre Teilnehmerzahl für den Science March in Heidelberg, macht es sich zu einfach. Aber es gibt eine nachvollziehbare Weise, das, was die meisten Menschen mit der Alltagsfrage “Wieviele Menschen waren denn nun wirklich/in Wahrheit da?” meinen, so zu konkretisieren, dass eine messbare Größe dabei herauskommt. In meinem Falle: Wieviele Menschen lassen sich in dem oben genannten Foto als Zuhörer der Abschlussveranstaltung identifizieren? Die Antwort auf solche konkret messbaren Fragestellungen, nachvollziehbar und transparent präsentiert, ist das nächste, wie wir in der Wissenschaft oder auch sonstwo der Feststellung von Tatsachen kommen können.

Und der Unterschied, um den es beim Science March ging, war ja nicht der Unterschied zwischen solchen konkreten Tatsachenbehauptungen und einem idealisierten Tatsachenbegriff, sondern doch wohl folgender:

Der Unterschied zwischen einer nachvollziehbaren und transparenten Darstellung, wie ich sie hier für meine Tatsachenbehauptung versucht habe, dass beim Heidelberger Science March 1800 Teilnehmer waren, und dem Vorgehen, wie wir es z.B. von Pressesprecher Sean Spicer, bei der Pressekonferenz zur Zuschauerzahl von Trumps Amtseinführung gesehen haben: grandiose Behauptungen, das sei das größte Publikum – sowohl “in person” vor Ort als auch rund um den Erdball – gewesen, das je einer solchen Amtseinführung beigewohnt habe. Keine begleitende Veröffentlichung der Daten, aus denen diese Aussage gewonnen wurde – keine direkte Möglichkeit, die Aussage nachzuvollziehen, und ein gehöriges Maß an Falschaussagen.

Wenn bereits bei solch einem Thema die Nebelkerzen gezündet und falsche Behauptungen aufgestellt werden, ist das Besorgnis erregend. Nicht zuletzt kam die Formulierung der “alternative facts” genau in diesem Zusammenhang auf, nämlich als Trumps Beraterin Kellyanne Conway diesen Unsinn frisch-froh-unverzagt mit der Formulierung verteidigte, Spicer habe da nicht die Unwahrheit gesagt, sondern eben nur alternative Fakten präsentiert.

Da fragt man sich natürlich: Wenn sich nicht mal mehr bei einer so vergleichsweise einfachen Frage wie der nach der Teilnehmer- oder Zuschauerzahl ein Konsens erzielen lässt, was für eine Chance haben wir dann bei der Diskussion komplexerer Themen? Beim Klimawandel, um das Standardbeispiel zu nehmen? Oder bei Themen, die hier in Deutschland deutlich umstrittener sind: dem Umgang mit der Gentechnik beispielsweise, oder mit Tierversuchen?

So habe jedenfalls ich den Science March und die vielen Schilder der Teilnehmer verstanden, dass wir Fakten statt alternative Fakten wollen: als Aufruf zu einer Diskurskultur, in der Nachvollziehbarkeit und Transparenz so selbstverständlich werden, dass niemand mehr mit bloßen Behauptungen durchkommt. Und in solch einer Diskussionskultur würde dann auch ein Blogbeitrag wie dieser hier niemanden mehr die Augenbrauen lüpfen lassen, sondern es wäre ganz selbstverständlich: wenn ich behaupte, dass beim Science March Heidelberg 1800 Teilnehmer waren, dann muss ich auch erklären, wie ich auf diese Behauptung komme.

Wir können den Science March gerne noch als Anlass für viele weitere Diskussionen nutzen – auch darüber, was im Wissenschaftssystem selbst nicht so läuft, wie es sollte, ob Wissenschaftlerinnen und Wissenschaftler noch besser kommunizieren müssen und wie und einiges mehr. Aber die Grundlage für diese und weitere Diskussionen muss dieselbe sein: Nachvollziehbarkeit, Transparenz, offen zur Verfügung gestellte Daten. Eine Diskussionskultur, in der es nicht darum geht, das letzte Wort zu haben oder gegen die andere Seite zu “gewinnen”, sondern in der Argumente sowohl ernst gemeint vorgebracht als auch ernst gemeint beantwortet werden.

Nachtrag 25.4.2017: Auf Bitte eines Twitterers: hier ist das Skript samt den zur Auswertung benötigten Bildern als .tgz – klar, elegant ist etwas anderes, aber es hat funktioniert.

Tatsachenbehauptungen lassen sich überprüfen, das zeigt dieser Beitrag. Gefühlte Fakten (Tatsachen) müssen nicht den wirklichen Fakten entsprechen – und tun dies auch häufig nicht. Trump hat in seinem Wahlkamp und sogar als Präsident mehrmals gezeigt, dass zu seinem Weltbild “Fakten” gehören, die nicht der Wirklichkeit entsprechen. So gibt es die von ihm aktuell gefühlte Zunahme von Gewalt in den US-Innenstädten nicht, etwas was sich statistisch belegen lässt. Schwieriger wird es mit der Behauptung, die USA habe vom Freihandel mit China und den Nafta-Partnern nicht profitiert, sondern sei über den Tisch gezogen worden und habe durch den Freihandel Jobs und seine Vormachtstellung verloren. Denn wie so oft spielen hier viele weitere Dinge eine Rolle und auch die Bedeutung von Worten wie “Vormachtstellung” ist nicht für alle die gleiche.

Jedenfalls gibt es neben Meinungen (zum Glück) auch Fakten und jede Meinung muss sich an Fakten messen lassen. Mit dem Satz “Es gibt keine Tatsachen, nur Interpretationen.” liegt Nietzsche für einmal völlig falsch, wenn er mit dieser vor allem unter Geisteswissenschaftlern kursierenden Ansicht auch nicht allein ist. Harald Lesch sagt dazu prinzipiell richtig, wenn auch überspitzt: “Viele Geisteswissenschaftler beschäftigen sich mit Bereichen, wo die Interpretation einen großen Raum einnimmt. Ich als Astronom kann hingegen sagen: Das sind die Fakten; da gibt es nichts zu interpretieren.”

http://www.rnz.de/nachrichten/heidelberg_artikel,-Heidelberg-March-for-Science-in-Heidelberg-Weil-es-keine-Alternative-zu-Fakten-gibt-plus-Fotogale-_arid,270538.html

Inkl. Verweis auf diese Analyse.

Danke für Hinweis und Link – den entsprechenden Ausschnitt hatte ich heute morgen auch schon auf meinem Schreibtisch!

Alles Fake! Auf dem detailausschnitt erkenne ich glaube ich deine Frau, aber wo sind die Kinder? Schon beim quallenforschen?!?

Guter Punkt, das Problem hatte ich eigentlich noch erwähnen wollen. Kleine Kinder sieht man da in der Tat nur bedingt (wie in unserem Falle). Nicht so kritisch weil ich ja versuche eher konservativ zu schätzen, aber sicher der Erwähnung wert!

Kinder würde ich ohnehin nicht als Demonstrationsteilnehmer zählen, weil sie noch nicht mündig sind.

Danke! Einfach nur ein großes, dickes, fettes Dankeschön dafür, dass Sie Fakten ernst nehmen und unaufgeregt, transparent, nachvollziehbar präsentieren.

Mich stört schon einige Zeit, dass nirgends genaue Teilnehmerzahlen zum Science March genannt werden es ist immer nur von tausenden weltweit die Rede. Bei uns in Dresden waren es ca 1500, also ähnlich wie in Heidelberg. Wenn man diese Zahl auf die 577 Städte Weltweit extrapoliert, kommt man auf fast eine Million Teilnehmer weltweit. Das ist nun aber leider eine sehr grobe Schätzung, da einige Große Städte deutlich mehr Teilnehmer hatten und andere vermutlich deutlich weniger. Wir bräuchten also eine Crowd-Lösung, wo wir alle Teilnehmerzahlen für alle Orte sammeln und so eine gute Schätzung für die weltweiten Zahlen bekommen.

Selber in einer Fotographie die Personen zählen und das Resultat in einer News-Seite festhalten könnte in der Wikitribune, dem geplanten Wikipedia-Nachrichtenportal zu einem gängigen Arbeitsschritt von Freiwilligen werden.

Wikitribune will evidenzbasierten Journalismus realisieren.

Wikitribune strebt eine ähnliche Arbeitsweise wie die Wikipedia an (alles ist editierbar: bestehende News-Texte können korrigiert oder umformuliert werden) , allerdings werden die Texte vor Veröffentlichung von einem festen Mitarbeiter-Team (bestehend aus Factchecker, etc.) geprüft.

Falls Wikitribune funktioniert, könnte es zu einer neuen Referenz werden und gleichzeitig den meisten anderen News-Portalen den Garaus machen.

Im Wikipedia-Eintrag zu Wikitribune liest man (von mir übersetzt):“Dies wird das erste Mal sein, dass professionelle Journalisten und Bürgerjournalisten Seite an Seite als Gleiche unter Gleichen arbeiten werden um Stories zu schreiben, die gerade geschehen, um sie zu bearbeiten, wenn sie sich entwickeln und das immer mit dem Rückhalt einer Gemeinschaft, die alle Tatsachen prüft und überprüft.”,..