Von Reisen mit Gehirn-Landkarten Teil III-Wie Zebrafische Entscheidungen treffen

Wer von euch hatte in der Schule Integralrechnung? Und wer von euch hatte Probleme damit?

Was wäre wenn ich euch sage dass jeder von euch in jeder Sekunde in der ihr diesen Artikel lest Integralrechnung in eurem Gehirn betreibt. Was das mit Entscheidungs -findung und den Gehirnlandkarten zu tun hat, das erfahrt ihr jetzt.

Rückblick

In Teil I der Connectomics Reihe haben wir uns damit befasst wie detaillierte Karten vom Gehirn erstellt werden können. In Teil II ging es darum, wie die Signale der Neuronen durch ein eingebrachtes Gen sichtbar gemacht werden und dann die Gehirnkarte mit der Gehirnfunktion verknüpft werden kann. Wer die Artikel noch nicht gelesen hat und das gerne nachholen möchte, findet diese hier (Teil I) und hier (Teil II).

Die oben beschriebenen Methoden wurden in einer Publikation aus dem Jahr 20201 genutzt, um den Entscheidungs Schaltkreis von Zebrafischen zu erforschen.

Der Versuchsaufbau

Ein Zebrafisch ist in freier Wildbahn davon anhängig, nicht von der Strömung abgetrieben zu werden. Abtreiben kann dazu führen, dass der Fisch in gefährliche Gewässer gelangt wie eine schnelle Strömungen oder einen Wasserfall. Um festzustellen ob er abgetrieben wird, misst der Fisch nicht etwa die Strömung, sondern beobachtet den Untergrund. Fliegt dieser zu schnell und für längere Zeit an ihm vorbei, weiß der Fisch, dass dies nicht nur eine kurze Turbulenz war und fällt die Entscheidung dagegen anzuschwimmen. Dieses Verhalten kann auch unter Laborbedingungen nachgestellt werden. Dabei wird von oben mit einem Projektor ein Muster auf den Boden eines Fischgefäßes geworfen. Das Muster besteht aus kleinen Punkten die sich leicht hin und her bewegen. Dies sollen etwa Steine im Flussbett darstellen. Dann blendet der Projektor eine Bewegung der Teilchen nach rechts oder links ein. Nach kurzer Zeit fällt der Fisch die Entscheidung dagegen anzuschwimmen und schwimmt los. Währenddessen wird das Fischgefäß so gedreht, dass der Fisch im Kreis schwimmt und das Experiment beliebig lange wiederholt werden kann ohne dass der Fisch den Rand des Gefäßes erreicht. Es ist möglich den Fisch stundenlang im Kreis schwimmen zu lassen da er nicht „lernt“, dass er ausgetrickst wird. Dies macht das Model um einiges einfacher.

In die Fische wird ein in der Biotechnologie häufig verwendetes Gen eingebracht, welches wandernde Signale der Neuronen zum Leuchten bringt. Da die Fische als Larven transparent sind, kann das Feuern der Neuronen sogar während dem Schwimmen mit einem Mikroskop beobachtet werden.

Der Schaltkreis

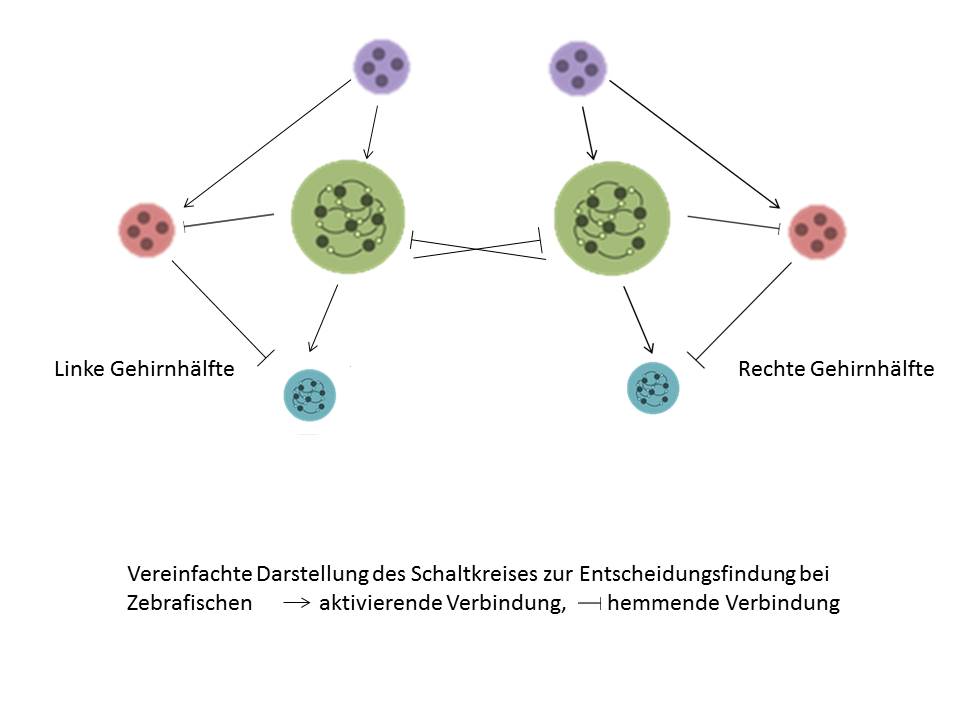

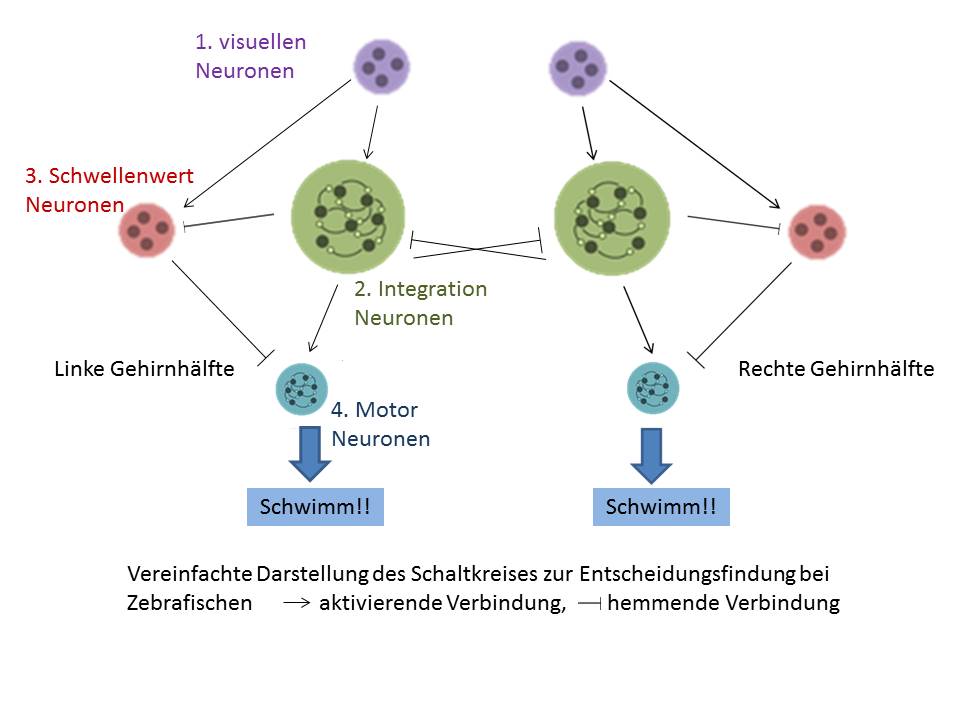

Nachdem die beteiligten Zellen (=Funktional Connectomics mehr dazu in Teil II) identifiziert wurden, wurden ALLE Verbindungen zwischen den einzelnen Zellen mit einem hochauflösenden Rasterelektronenmikroskop(= Connectomics mehr dazu in Teil I ) aufgezeichnet. Mit dieser Ultraauflösung ist es möglich zu unterscheiden, ob die Neuronen Verbindungen aktivierend sind oder ob sie die Aktivierung der anderen Neuronen Gruppe hemmen. Das ganze wurde dann in ein Modell übertragen und sich Gedanken gemacht, welche Neuronen Gruppe wohl für was zuständig sein könnte.

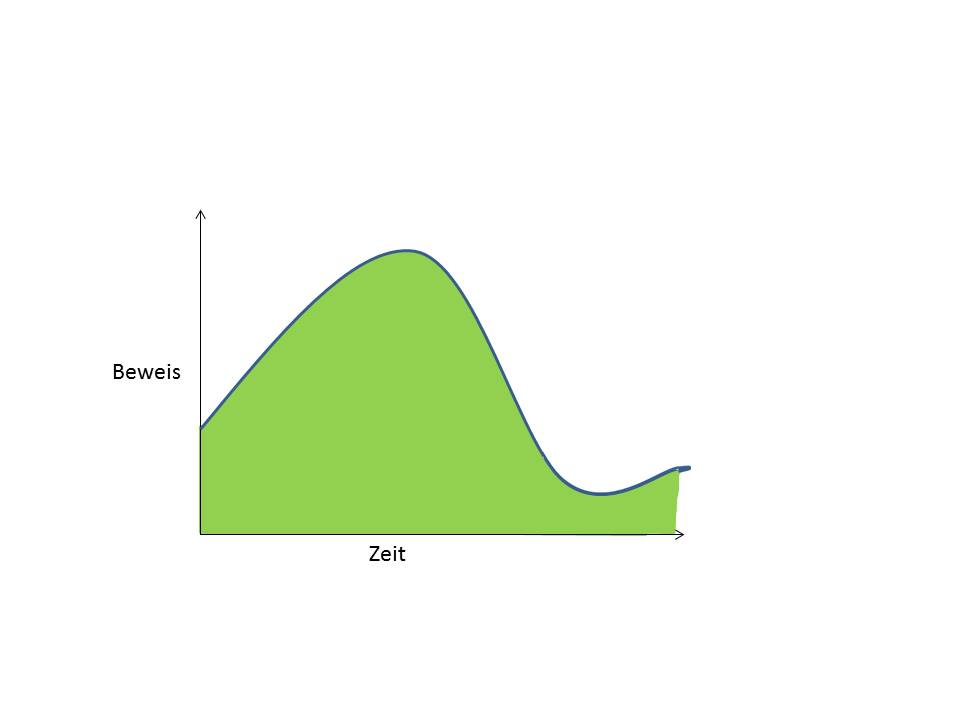

Forscher haben nun herausgefunden, dass vier Neuronen für den Entscheidungs-prozess der Fische wichtig sind. Erst die visuellen Neuronen, die den Stimulus aufnehmen. Sie senden die visuelle Information an sogenannte Beweis-Integration Neuronen. Vielleicht können sich manche noch an Integralrechnung aus der Schule erinnern. Ein Integral ist die Berechnung der Fläche unter einer Kurve mit definierten Grenzen. Gehen wir nun davon aus, dass X die Zeit ist und Y die Beweise, dass der Fisch tatsächlich abtreibt, dann wir der Gesamtbeweis größer, je mehr Zeit vergeht (ähnlich wie ein Eimer, der sich immer weiter füllt).

Genau so funktioniert Beweis-Integration. Damit jedoch lange zurückliegende Ereignisse den Entscheidungs-prozess nicht beeinflussen, leckt der Eimer jedoch ein wenig. Wenn über einen längeren Zeitraum keine neuen Beweise hineinlaufen, leert sich der Eimer. Aus diesem Grund werden Daten für sensorische Integration nur etwa wenige Sekunden( etwa 2.2 – 34s im Menschen) gespeichert.

Schwellenwert Neuronen

Die Beweis-Integration Neuronen sammeln so lange Beweise, bis ein bestimmter Schwellenwert erreicht ist. Um beim Eimer Beispiel zu bleiben; Es werden so lange Beweise gesammelt bis der Tropfen fällt, der den Eimer zum Überlaufen bringt. Die Grenze wird von den Schwellenwert Neuronen bestimmt (die dritten Neuronen Gruppe). Die Schwellenwert Neuronen aktivieren dann die vierte Gruppe von Neuronen, die Motor Neuronen, welche die Bewegung einleiten. Zusammen bilden diese Neuronen Teilstrukturen von entscheidungssteuernden Schaltkreisen für ein vergleichsweise einfaches Netzwerk1.

Was kann man daraus über dem Menschen lernen?

Auf den Menschen lässt sich das natürlich nicht 1:1 übertragen, da wir ein deutlich komplizierteres Entscheidungs Netzwerk haben, was noch weit davon entfernt ist vollständig verstanden zu werden. Doch auch im Menschen nimmt man an, dass Entscheidungen durch Integration von Information über einen gewissen Zeitraum erfolgen können. Als Information ist hier vor Allem die Integration von sensorischen Information (also Sehen2, Riechen, Haltung3…..)

Wenn ihr eure Augen nun von links nach rechts beim Lesen über den Bildschirm bewegt, wird der Standpunkt des Auges zum Bespiel durch Integration der Augengeschwindigkeit ermittelt2.

Also an alle die am Integralrechnen verzweifeln, nicht verzagen, das wird schon … auch Fische können Integral.

“Goldfish do Integrals”

Übersetztes Zitat- Michael Fee, MIT

Quellen:

- Bahl, Armin; Engert, Florian (2020): Neural circuits for evidence accumulation and decision making in larval zebrafish. In Nature neuroscience 23 (1), pp. 94-102. DOI: 10.1038/s41593-019-0534-9

.

- Sanchez, Katherine; Rowe, Fiona J. (2018): Role of neural integrators in oculomotor systems: a systematic narrative literature review. In Acta ophthalmologica 96 (2), e111-e118. DOI: 10.1111/aos.13307

.

- S. E. Haggerty (2017): A shared neural integrator for human posture control. In the American Physiological Society 118 (2), pp. 894-903.

Interessant, dass die Steuerung von Regelkreise wie hier für das Fluchtverhalten von Zebrafischen in starken Strömungen beschrieben, sehr an die globale Steuerung von Lernprozessen in der Künstlichen Intelligenz, im Deep Learning, erinnern. In der heutigen künstlichen Intelligenz spricht man von der objective function oder loss function, die es zu optimieren gilt. Zitat Wikipedia (übersetzt von google translate):

Im obigen Beispiel könnte man die Integrationsneuronen als die Neuronen betrachten welche den Zahlenwert liefern, der optimiert werden muss und die Schwellenwertneuronen nutzen den von den Intrgrationsneuronen gelieferten Wert dann um beim optimalen Wert eine Aktion auszulösen.

Im Prinzip sind das recht einfach gestrickte Regelkreise, deren Realisation wohl auch nur wenige Neuronen nötig macht. Tatsächlich besteht das gesamte Zebrafisch-Gehirn, welches noch viel mehr macht als gegen gefährlichen Strömungen anzukämpfen, nur gerade aus 100‘000 Neuronen was ungefähr den Anzahl künstlicher Neuronen in einem anspruchsvollen tiefen neuronalen Netzwerk der späten 2010-er Jahre entspricht. Heute gibt es in einem begrenzten Kreis der Deep-Learning-Community die Ansicht, es genüge einfach die Anzahl der Neuronen zu erhöhen um zu im Anwendungsfall intelligenteren/ja sogar allgemein intelligenteren KI‘s zu kommen, was darauf hinausläuft zu sagen, dass der Unterschied zwischen Zebrafisch und Mensch in Bezug auf die Intelligenz einfach die unterschiedliche Zahl der Neuronen sei.

Die neueste Errungenschaft der künstlichen generativen Intelligenz, GPT-3 scheint diese Annahme bis zu einem gewissen Grad zu bestätigen, scheint doch GPT-3 sehr viel sprachkompetener als seine Vorgänger, kann es doch neben Übersetzungen in verschiedene Sprachen bei Bedarf auch lyrische Texte produzieren oder ganze, recht überzeugende Geschichten, erfinden. Und der wichtigste Unterschied von GPT-3 im Vergleich zu seinen Vorgängern sind die Anzahl der Parameter, was der Anzahl der Synapsen in einem Nervensystem entspricht. Mit 175 Milliarden Parametern/Synapsen übertrifft GPT-3 mit Sicherheit den Zebrafisch, denn bei etwa 7000 Synapsen pro Nervenzelle kommt man bei GPT-3 auf 25 Millionen Neuronen, was immerhin 250 Mal mehr Neuronen sind als beim Zebrafisch – aber immer noch 3000 Mal weniger als beim Menschen.

Frage: Ist der Mensch von der Intelligenz her einfach ein Zebrafisch mit 800‘000 mehr Neuronen als der Zebrafisch?

Antwort: Einige „Optimisten“ glauben das und wollen es durch Hochskalieren (Grössermachen, dessen was es schon gibt) beweisen.

@Einstieg in die Wirklichkeit von Nervensystemen

Sieht so aus, als wären wir inzwischen in der Lage, nachzuvollziehen, wie Nervensysteme tatsächlich im Detail funktionieren. Und doch erscheint mir das beschriebene Verfahren ziemlich aufwändig zu sein. Wenn ich das richtig verstanden haben, zeichnet man erst die Aktivierungen der Aktionspotenziale auf, macht dann die Röntgenaufnahmen und muss dann aber das untersuchte Nervennetz in Scheiben schneiden, und damit zerstören, um an die genaue Verschaltung der Synapsen zu kommen.

Das heißt, dass man damit immer nur recht kleinräumige Sachverhalte aufklären kann, und vor allem komplexe Lernprozesse, die über längere Zeit ablaufen, nicht erkennen kann.

@Holzherr 29.06. 13:00

„Frage: Ist der Mensch von der Intelligenz her einfach ein Zebrafisch mit 800‘000 mehr Neuronen als der Zebrafisch?“

Wohl kaum. Hier liegen wohl noch die vielfältigsten Systeme und Wechselwirkungen vor, wovon wir immer noch nicht die geringste Ahnung haben. Und wir haben ja noch nicht mal den Zebrafisch wirklich komplett kartiert, sondern nur die einzelne Funkion, die das Schwimmen gegen die Strömung steuert.

„Antwort: Einige „Optimisten“ glauben das und wollen es durch Hochskalieren (Grössermachen, dessen was es schon gibt) beweisen.“

Sollen sie es probieren. Man wird dann schon merken, was dann doch wieder ganz anders funktioniert.

„…scheint doch GPT-3 sehr viel sprachkompetener als seine Vorgänger, kann es doch neben Übersetzungen in verschiedene Sprachen bei Bedarf auch lyrische Texte produzieren oder ganze, recht überzeugende Geschichten, erfinden“

Ich bin mir nicht sicher, dass GPT-3 so funktioniert, wie Sprache in unserem Gehirn verarbeitet wird. Insbesondere hat GTP-3 kein eigenes Bewusstsein und versteht nicht wirklich, was es produziert. Es läuft schon von Grund auf in einer Abstraktionsebene, die unser Gehirn so wahrscheinlich gar nicht besitzt. So erklärt sich auch die enorme Leistungsfähigkeit dieser „Sprachmaschine“.

Das kommt mir so ähnlich vor wie der gute alte Taschenrechner, der so spezifisch effektiv arbeitet, dass er mit ein paar hundert Byte Arbeitsspeicher 1000 mal schneller Wurzeln zieht als ein Mensch mit 1,5 Kg Gehirn und Papier und Bleistift. Hier hat die Technik wirklich riesengroße Abkürzungen gefunden. So ähnlich könnte es sich auch mit der Effektivität von GPT-3 verhalten.

So hat man auch zu den Zeiten von Taschenrechnern gedacht, dass man mit den Computern, die wir heutzutage tatsächlich haben, wohl was schon viel intelligenteres hätten, als wir Menschen selber sind. Das haben wir tatsächlich in manchen speziellen Bereichen, aber das wirkliche wilde Leben von 1,5 KG Nervenzellen, das haben wir noch lange nicht technisch erfasst. Und mit den hier im Beitrag beschriebenen Verfahren werden wir das auch nicht finden können. Wir bräuchten was von der Menge her millionenfach leistungsfähigeres, das zerstörungsfrei arbeitet und über Jahre das Wachstum der Nervenzellen beobachten kann.

“Der Fisch misst die Strömung…”

Letzteres beinhaltet dass er die Situation bewertet. Der Sehsinn gibt also Informationen über die Neuronen bzw. andere Sinne an eine Art Bewertungssystem (Gehirn) im Fisch, was auf Grund genetischer ,angeborener, Muster gewisse sensible Neuronen entwickelt hat, die die Situation auf der Basis von möglichen Gefahren einschätzen können.

Da er für andere Reize nicht sensibilisiert wurde, schwimmt er stundenlang im Kreis, was Pferde mit Scheuklappen in einer Arena auch machen. Auch hier werden die Außenreize “ausgeblendet” und das Gehirn des Pferdes “ausgetrickst”.

@ Tobias Jeckenburger (Zitat):

Doch, ich behaupte unser Gehirn, unser Sprachzentrum funktioniert wohl ähnlich wie GPT-3 und der Vergleich von GPT-3 mit einem Taschenrechner geht vollkommen daneben. GPT-3 erzeugt Sprache ohne nachzudenken (wie wir auch hin und wieder), einfach indem es die ihm bekannten Sprachbausteine und die ihm bekannten Fakten so verknüpft wie das in einem der Millionen von Artikeln und anderen Texten im Durchschnitt gemacht wird. GPT-3 verhält sich also ähnlich wie eine vielbelesene Person, die einfach so daherredet. Die (Zitat) „enorme Leistungsfähigkeit“ dieser Sprachmaschine kommt einfach daher, dass GPT3 das gesamte Internet inklusive die gesamte Wikipedia „verspeist“ hat.

Was GPT3 fehlt ist ein robustes, auch logisch abgestütztes Weltbild. Das merkt man sobald man ihm unsinnige Fragen stellt. So antwortet GPT-3 etwa auf die Frage „Wieviel Augen hat ein Fuss?“ meist mit : „ein Auge“. Es begreift also nicht, dass das eine unsinnige Frage ist.

@Holzherr 02.07. 12:01

„GPT-3 erzeugt Sprache ohne nachzudenken (wie wir auch hin und wieder), einfach indem es die ihm bekannten Sprachbausteine und die ihm bekannten Fakten so verknüpft wie das in einem der Millionen von Artikeln und anderen Texten im Durchschnitt gemacht wird.“

Unser Gehirn hat eben nicht das ganze Internet als Trainingsmaterial zur Verfügung, und muss das mit Weltverständnis ausgleichen. Das Ergebnis dürfte also von daher schon anders ausfallen. Zusätzlich vermute ich, dass das Gehirn auch prinzipiell anders arbeitet, insbesondere, dass wir nicht wirklich wissen, wie genau. Insofern kann GPT-3 doch eine Abstraktionsebene nutzen, die wir gar nicht haben.

Wir haben zwar sicher auch eine eigene Abstraktionsebene für Sprache, da stimme ich Ihnen zu, aber wohl eben eine andere als GPT-3.

„Doch, ich behaupte unser Gehirn, unser Sprachzentrum funktioniert wohl ähnlich wie GPT-3 und der Vergleich von GPT-3 mit einem Taschenrechner geht vollkommen daneben.“

Der Taschenrechner nutzt jedenfalls eine Abstraktionsebene, eben die einprogrammierten Algorithmen, die unser Gehirn leider nicht kann. Deshalb ist Wurzelziehen für uns ja soviel schwieriger als für simple Taschenrechner.