Sprachenlernen und die Evolution des menschlichen Gehirns

Zoosemiotiker erforschen die verschiedenen Formen der tierischen Kommunikation. Einige von Ihnen haben versucht Hunden, Affen und Vögeln eine menschliche Sprache beizubringen. Nach langem Training lernten diese Tiere Wortassoziationen. Es gab kein Tier, das nur dadurch, das es Sprache ausgesetzt war, Worte und die mit ihnen verbundenen Bedeutungen gelernt hat – es wurde immer explizit und mühsam dafür trainiert. Das ist ein kritischer Unterschied zu dem Spracherwerb bei Kindern, die ab einem bestimmten Alter ohne irgendeine Anleitung Sprache verstehen und erzeugen können. Diesen Unterschied erklärt eine Gruppe von Neurolinguisten damit, dass das menschliche Gehirn spezifische Sprachmodule hat, die nur im menschlichen Gehirn vorkommen. Eine andere Gruppe vertritt die neuere Meinung, dass Sprache wie ein Trittbrettfahrer auf bereits existierende Mechanismen zurückgreift, unabhängig davon, ob sich diese für die neuen Funktionen (evolutionsbiologisch oder entwicklungsbiologisch) weiter spezialisiert haben oder nicht.

Dieses deklarativ-prozedurale (DP)-Modell des Sprachenlernens sagt voraus, dass, da Lexikon und Grammatik einer Sprache erlernt werden müssen, das Lexikon stark vom deklarativen und die Grammatik stark vom prozeduralen Gedächtnis abhängig ist. Darüber hinaus sagt das DP-Modell voraus, dass sich bei einem Sprachenlerner das Grammatiklernen in der frühen Lernphase stärker auf das deklarative in der späten Lernphase stärker auf das prozedurale Gedächtnis stützen wird, weil das Lernen mit dem deklarativen Gedächtnis schneller erfolgt als mit dem prozeduralen Gedächtnis.

Semantisches und prozedurales Gedächtnis beim Sprachenlernen

Das semantische Gedächtnis, eine Form des deklarativen Gedächtnisses, beinhaltet das bewusste Faktenwissen. Es speichert unser Wissen über die Welt und die Sprache und ist im Gegensatz zum autobiografischen Gedächtnis nicht emotional gefärbt und frei von eventuellen Rahmenbedingungen, d. h. wir erinnern die Gegebenheit nicht in Verbindung mit einem Ort oder einem bestimmten Zeitpunkt. Das semantische Gedächtnis ermöglicht uns “automatisch” zu erinnern, dass die Hauptstadt von Frankreich Paris ist. In der Regel erinnerst du dich aber nicht daran, wann, wo und von wem du diese Tatsache das erste Mal gehört hast. Das semantische Gedächtnis dient uns als mentales Lexikon. Dafür sind im Gehirn der Temporallappen und der Hippocampus wichtig.

“Diese Hirnsysteme sind auch bei Tieren zu finden – Ratten verwenden sie zum Beispiel, wenn sie lernen, in einem Labyrinth zu navigieren”, sagt Koautor Phillip Hamrick, “Unabhängig von den Änderungen, die diese Systeme zur Unterstützung der Sprache durchlaufen haben, ist die Tatsache, dass sie eine wichtige Rolle in dieser typisch menschlichen Fähigkeit spielen, bemerkenswert.”

Das prozedurale Gedächtnis ist das Gedächtnis für unbewusste Bewegungsabfolgen wie Laufen oder Fahrradfahren. Wenn wir einen Bewegungsablauf oft genug wiederholt und geübt haben, können wir ihn ausführen, ohne darüber nachdenken zu müssen. Dafür sind im Gehirn vor allem das Kleinhirn und die Basalganglien zuständig.

Sprachforscher aus den USA, England und Australien haben das DP-Modell jetzt in einer Metaanalyse von 16 Studien statistisch überprüft und diese in der Fachzeitschrift PNAS veröffentlicht [1]. In ihrem Artikel beschreiben sie wie Kinder ihre Muttersprache und Erwachsene Fremdsprachen mit evolutionär alten Gehirnstrukturen lernen, die es bereits vor der Entstehung des Menschen gab und die auch für so unterschiedliche Aufgaben wie das Erinnern an Omas Geburtstag und Fahrrad fahren lernen verwendet werden – also nicht spezifisch für Sprache sind.

Die Ergebnisse zeigen, wie gut wir uns an die Wörter einer Sprache (oder Vokabeln bei Fremdsprachen) erinnern, hängt davon ab, wie gut wir mit dem semantischem Gedächtnis lernen können, mit dem wir uns das kleine Einmaleins merken.

Die Grammatikfähigkeiten, die es uns ermöglichen, Wörter gemäß den Regeln einer Sprache zu Sätzen zu kombinieren, zeigen ein anderes Muster. Die Grammatikfähigkeiten von Kindern, die ihre Muttersprache lernen, korrelierten am stärksten mit dem Lernen des prozeduralen Gedächtnisses, mit dem wir Aufgaben wie Fahrradfahren lernen. Bei Erwachsenen, die eine Fremdsprache lernen, korrelieren die Grammatikfähigkeiten jedoch mit dem semantischen Gedächtnis in frühn Stadien des Fremdspracherwerbs, jedoch mit dem prozeduralen Gedächtnis in späten Stadien.

Die Korrelationen waren stark und wurden in Sprachen wie Englisch, Französisch, Finnisch und Japanisch und Aufgaben wie Lesen, Zuhören und Sprechen konsistent gefunden, was darauf schließen lässt, dass die Verbindungen zwischen Sprache und Gehirnsystem robust und zuverlässig sind.

Die Ergebnisse zeigen, dass Menschen beim Sprachenlernen auf kognitive Allzwecksysteme angewiesen sind. Die Allgemeinheit dieser Systeme schließt jedoch nicht die gleichzeitige Existenz domänenspezifischer Substrate für die Sprache aus, entweder aufgrund einer ontogenetischen (Entwicklungs-) oder phylogenetischen (evolutionären) Spezialisierung innerhalb dieser Systeme oder aufgrund zusätzlicher spezialisierter Schaltungen.

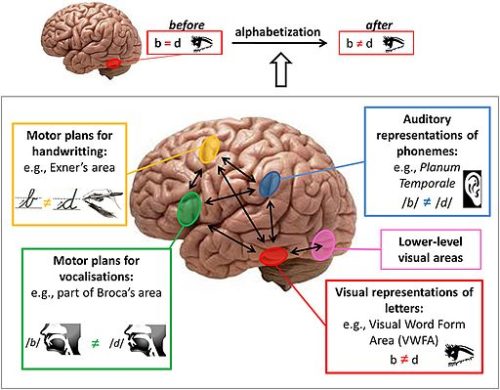

Ein Schlüsselaspekt der Alphabetisierung besteht darin, die als “Phonem-Graphem-Entsprechung” bekannte audio-visuelle Abbildung festzulegen, wobei elementare Töne von Sprache (d. h. Phoneme) mit visuellen Darstellungen (d. h. Graphemen) verknüpft werden. Credit: Pegado F, Nakamura K and Hannagan T [CC BY 3.0 (https://creativecommons.org/licenses/by/3.0)], via Wikimedia Commons

Evolution des Gehirns bei Wirbeltieren

Das Studium der Evolution der Gehirnbereiche, die dem semantischen und dem prozeduralen Gedächtnis zugrunde liegen, kann uns vielleicht neue Erkenntnisse über den Spracherwerb beim Menschen liefern. Evolutionsbiologen haben bisher drei wichtige Schlussfolgerungen aus der Evolution des Gehirns bei Wirbeltieren gezogen [2]:

1. Alle Wirbeltiere, mit Ausnahme der Kieferlosen (Agnathen), denen ein Kleinhirn fehlt, haben die gleiche Anzahl Gehirnglieder.

2. Die Gehirngröße hat bei einigen Mitgliedern jeder Wirbeltierklasse unabhängig zugenommen. Sowohl Vögel als auch Säugetiere haben ein Gehirn, das 6–10 Mal größer ist als das Gehirn von Reptilien der gleichen Körpergröße.

3. Zunahme der Gehirngröße hat häufig zu einer Zunahme der Anzahl neuronaler Zentren, einer Zunahme der Anzahl neuronaler Zellklassen innerhalb eines Zentrums und wahrscheinlich einer Zunahme der Verhaltenskomplexität geführt. Das auffälligste Beispiel für eine Zunahme der Nervenzentren mit Zunahme der relativen Gehirngröße fanden die Neurobiologen bei den Säugetieren. Von den Nagetieren zu den Primaten steigt die Anzahl der kortikalen Unterteilungen um das Fünffache.

Die meisten Neurobiologen nehmen an, dass die Komplexität des Gehirns und die Komplexität des Verhaltens irgendwie miteinander verbunden sind. Gehirne existieren, um Informationen zu verarbeiten, die es einem Tier ermöglichen, Probleme zu lösen, was wiederum zur Fitness dieses Tieres beiträgt. Mit zunehmender Größe des Gehirns nehmen auch die Anzahl der Nervenzellen und ihrer Verbindungen zu, wodurch die verfügbare Ausrüstung für die Informationsverarbeitung erweitert wird. Diese gesteigerte Fähigkeit, Informationen zu verarbeiten, ermöglicht es einem Tier, eine komplexere Wahrnehmungswelt aufzubauen, die wiederum erhöhte Möglichkeiten zur Problemlösung aufzeigen und dazu führen soll, dass Verhalten komplexer und anpassungsfähiger wird.

Pyramidenzellen eignen sich für Deep Learning

Die KI-Forscher Blake Richards und Jordan Guerguiev haben in der Fachzeitschrift eLife einen Algorithmus publiziert [3], der simuliert, wie Deep Learning in unserem Gehirn funktionieren kann. Das Netzwerk zeigt, dass die neokortikalen Pyramidenzellen von Säugetieren die Form und die elektrischen Eigenschaften besitzen, die sich für Deep Learning eignen.

“Die meisten dieser Neuronen sind wie Bäume geformt, mit “Wurzeln” tief im Gehirn und “Ästen” in der Nähe der Oberfläche”, sagt Richards. “Interessant ist, dass diese Wurzeln andere Eingaben erhalten als die Äste, die ganz oben im Baum stehen.”

Mit dem Wissen über die Struktur der Pyramidenzellen bauten Richards und Guerguiev ein Modell, das auf ähnliche Weise Signale in getrennten Kompartimenten empfing. Diese Kompartimente ermöglichten es simulierten Neuronen in verschiedenen Schichten, zusammenzuarbeiten und Deep Learning zu erreichen.

“Es handelt sich lediglich um eine Reihe von Simulationen, so dass wir nicht genau sagen können, was unser Gehirn tut. Es ist jedoch ausreichend, um weitere experimentelle Untersuchungen zu rechtfertigen, wenn unser eigenes Gehirn die gleichen Algorithmen verwendet”, sagt Richards. Langfristig hofft er, dass die KI-Forscher die großen Herausforderungen meistern können, beispielsweise durch Erfahrung lernen, ohne Feedback zu erhalten.

Weiterführende Literatur

Auf Dr Doolittles Spuren: Lautlernen und Interspecies-Kommunikation

Plato und die Papageien: Zur Naturgeschichte des Geistes

Nature vs Nurture: Universalien der Intonation bei Singvögeln und Menschen

Wenn Zoosemiotiker versuchen, Tieren die menschliche Sprache beizubringen – dann zeigt dies einen groben Mangel vom Verständnis des Sprachenlernens.

Experimente mit menschlichen Foeten im Mutterbauch zeigen, dass diese bis zum Ende der Schwangerschaft bereits gelernt haben, einzelne Laute, Silben und sogar Sprachmelodien zu unterscheiden. Lautmessungen von Baby-geschrei zeigen, dass diese nach der Geburt im Rhythmus der Muttersprache schreien.

D.h. bereits bei der Geburt ist die Fähigkeit zur Mustererkennung für akustische Signale(Sprache) beim Menschen vorhanden. Die Experimente der Zoosemiotiker – bei denen dieser foetale Lernprozess komplett ignoriert wird – sind daher wenig aussagekräftig. Ich würde solche Experimente als unnötige Tierversuche betrachten.

(off topic: ich habe hier bei SciLogs schon oft darauf hingewiesen, dass sich das Phänomen´Nahtod-Erfahrung´(NTE) als strukturierter Erinnerungsprozess erklären lässt – bei dem man bewusst erleben kann, wie das Gehirn einen einzelnen Reiz verarbeitet. Beim Erinnern sind zwei Strategien eindeutig erkennbar, mit denen Inhalte des episodischen Gedächtnisses verarbeitet werden

A) in zeitlich absteigender Reihenfolge – sind Erlebnisse ab dem aktuellen Alter bis zum 2.-4. Lebensjahr erinnerbar. Diese Grenze des Erinnerns ist als ´infantile Amnesie´ bekannt.

B) in zeitlich aufsteigender Reihenfolge – sind Erlebnisse ab dem 5. Schwangerschaftsmonat erkennbar und zwar in der gleichen Reihenfolge, wie sich die Sinne entwickeln: Fühlen(Hautkontakt) > Hören > Sehen > Geburt(indirekt) > …

ABER – dass wir Sinnes-/Lernerfahrungen ab dem 5. Schwangerschaftsmonat bewusst erinnern können, wird von der Gehirn-/Gedächtnisforschung bisher komplett ignoriert!

Einen der allerwichtigsten Lernzeiträume einfach zu ignorieren – ist eine Schande für die Wissenschaft. Per Google-suche [Kinseher NDERF denken_nte] ist eine frei lesbare PDF mit meinem NTE-Erklärungsmodell zugänglich. Mein Buch/e-Buch ´Kinseher Richard: Pfusch, Betrug, Nahtod-Erfahrung´ ist imHandel erhältlich.)

Nichts gegen Ihren obigen Beitrag Herr Dramiga – aber wenn einer der wichtigsten Zeiträume zur Erlernen von Sprache in Überlegungen überhaupt nicht erwähnt wird, dann fehlt es grundsätzlich an Verständnis von Entwicklungsbiologie.

Das prozeduale Gedächtnis oder das implizite Gedächtnis ist das dem Verstand nicht zugängliche Gedächtnis. Es ist das evolutionär älteste Teil des Gehirns und dient der Verarbeitung von Reizen auf unbewusster Ebene. Sprache ist meiner Ansicht nach

eine Anneinanderreihung von Reizen(von Buchstaben) um ein BILD,ein MUSTER zu schaffen und zu beschreiben.Diese Muster werden im Neo Cortex abgespeichert und mit neu eingehenden Reizen auf der Basis von Assoziationen bewertet.Der Mensch greift bei seiner Sinnsuche auf bereits gelernte Muster zurück.Wenn also Tiere eine menschliche Sprache “sprechen” ist das unrealistisch, da sie zu diesen Begriffen keine menschlichen Assoziationen aufbauen können.(Sie werden immmer nur wie ein Papagei nachplappern)

Sprache ist also für mich eine Möglichkeit,bestehendes Wissen zu strukturieren um es dann zu speichern…

Sprachenlernen scheint mir eine Unterabteilung der Evolution des menschl. Gehirns zu sein. Wobei man E. d. m. G. auch als (komprimiert gesagt) das Denken/Bewusstsein sehen kann (Herr Schleim hat sich in seinen beiden letzten threads, gewissermaßen, auch mit dem Thema befasst).

Wie bzw. was wir denken (unser Bewusstsein) ist lt. Herrn Dramiga (zutreffend) hauptsächlich von 2 Arten geprägt. 1) Denken aufgrund gelernter/erklärter (in der Schule z.B.) – deklarativer/deklarierter – Dinge. 2) Denken infolge angeeigneter (evolvierter, emergierter) – prozeduraler – Dinge. Vererbungen gehören, m. A. n., auch dazu. Phylogenese (Stammesentwicklung) u. Ontogenese (individuelle Entwicklung – autobiografisches) ebenfalls. Wobei das von mir (ich bin kein Fachmann auf diesen Gebieten) sicher etwas vereinfacht formuliert ist.

Dass die Komplexität des Gehirns und die Komplexität des Verhaltens irgendwie miteinander verbunden sind

kann man wohl definitiv sagen.

1 und 2 kann man auch (laienhaft) als Reaktion auf Wahrnehmungen (“äußere Einflüsse“) zusammenfassen. Hr. Kinseher hat dann zumindest insofern Recht, als dass die Wahrnehmungen eines Kindes in der Gebärmutter ebenfalls wichtig sind.

@Krüger

Dass wir im Rahmen von NTEs Erfahrungen ab dem 5. Schwangerschaftsmonat erinnern können – zeigt einige wichtigen Grundlagen zur Arbeitsweise/Struktur des menschlichen Gehirns

1) bei NTEs werden Erfahrungen des episodischen Gedächtnisses reaktiviert – d.h. das Gehirn hat diesen Bereich selektiv ausgewählt um einen bestimmten Reiz zu verarbeiten

2) es ist bei NTEs eine hierarchisch/zeitliche Struktur erkennen, die der Entwicklung der Sinnesorgane ab dem 5. SSM entspricht – d.h. Erfahrungen sind in dieser Reihenfolge abgespeichert bzw. der Suchvorgang beim Reaktivieren erfolgt in hierarchischer Reihenfolge

3) akustische Erlebnisse aus der Foetus-Zeit werden lebenslang erinnert – d.h. weil das Erkennen und Verarbeiten akustischer Reize eine Grundlage von Sprache bzw. Spracherwerb ist, sollte man das episodische Gedächtnis in wissenschaftlichen Theorien zum Spracherwerb nicht ignorieren.

K Richard

“akustische Erlebnisse werden lebenslang erinnert…”

Ich würde ergänzen:Sie werden lebenslang erinnert,weil sie mit Emotionen bewertet sind. Ein Foetus kann meiner Ansicht nach, nur über Emotionen erreicht/geprägt werden, da das explizite Denken in dem Stadium noch nicht stattfindet. Ein Foetus übernimmt in dem Stadium auch das emotionale Erlerben der Mutter als sein eigenes Erleben.(Das ICH hat sich noch nicht gebildet).Ist die Mutter im Stress oder voller Ängste, wird dieser Zustand auch auf das Nervensystem des Foetus abfärben und entsprechende neuronale Verbindungen herstellen.Spätere Psychische Störungen können hier also bereits “vorgeprägt” werden.Wenn die Mutter also auf einen akustischen Reiz stark emotional reagiert,reagiert auch der Foetus und speichert dieses Signal incl. der Reaktion der Mutter entsprechend den freigesetzten Hormonen und Neurotransmittern ab…

@Golzower :

Dass Erlebnisse aus der Foetus-Zeit lebenslang erinnert werden können – ist wegen der akustischen Erinnerungen für das Thema ´Sprachenlernen´ von grundsätzlichem Interesse.

Zusätzlich wird mit solchen Erinnerungen auch belegbar, dass die Fachliteratur zum Thema ´infantile Amnesie´ diskutiert und umgeschrieben werden muss. Bisher gilt die Lehrmeinung.

Infantile Amnesie: “Unfähigkeit von älteren Kindern, Jugendlichen und Erwachsenen, sich an Ereignisse aus den ersten Lebensjahren zu erinnern.” (Quelle: DORSCH, Lexikon der Psychologie, 16. Auflage)

off topic

Bei NTEs sind Erinnerungen ab dem 5. Schwangerschaftsmonat erkennbar und zwar genau in der gleichen Reihenfolge wie sich die Sinne entwickeln: Fühlen > Hören > Sehen > Geburt(indirekt) > …

Der Grund dafür, dass solche Erfahrungen lebenslang verfügbar sind, dürfte die Arbeitsweise des Gehirns sein – welches Erlebnisse in hierarchischer Reihenfolge abspeichert und erinnert

Ob in der Foetus-Zeit bereits Emotionen mit den Sinnesreizen verknüpft abgespeichert werden – dazu kann ich keine belegbare Aussage machen.

Fakt ist allerdings, dass Erlebnisse, die aus der frühen Baby-Zeit stammen – eindeutig mit Emotionen verknüpft sind; denn diese Emotionen werden beim Erinnern dieser Erlebnisse im Rahmen von NTEs wieder aktiviert und erkennbar.

Dass sich länger andauernder starker negativer Stress der Mutter auf den Foetus auswirken kann, ist mittlerweile gut belegt – da deswegen sogar Veränderungen im Gehirn des Kindes beobachtet werden können.

Es scheint mir höchst plausibel, dass die Sprachfähigkeit des Menschen eine enge Verbindung zu seiner hohen allgemeinen Intelligenz hat (viele Zugänge zu einem Problem) und dass diese hohe allgemeine Intelligenz als wichtigsten Mechanismus die Zweckentfremdung von bereits beim Tier vorhandenen kognitiven Fähigkeiten für ganz andere Zwecke benutzt.

Das bedeutet auch, dass das menschliche Hirn bessere Verbindungen zwischen den verschieden Hirnzentren haben muss (besserer “Cross-Talk”) und dass es besser in der Lage sein muss, vorhandene Fähigkeiten für ganz andere Zwecke zu “missbrauchen”.

Diese Superfähigkeit des Menschen alles was es im Hirn gibt für alle denkbaren Aufgaben anzuzapfen, die läuft grösstenteils unter der Bewusstseinsschwelle ab, aber bei komplizierteren Aufgaben wird uns dieses Entlehnen von Grundfähigkeiten als Tools durchaus bewusst. Man denke nur daran, wie man in der Schule Kopfrechnen lernt: Dazu benutzt man – unter anderem – das Gedächtnis indem man das kleine Einmaleins nach einem Training fest abspeichert. Kopfrechenaufgaben (z.B berechne 5 Prozent von (120 Euro * 12)) werden dann in sequentielle Schritte aufgeteilt, wobei bei jedem Schritt eine Kombination von Rückgriff auf im Gedächtnis abgespeicherte Tabellen und simplen Operationen (wie der stellenweisen Addition oder Multiplikation) stattfindet. Natürlich ist Kopfrechnen viel zu langsam und zu spät erlernt, als dass es mit Prozessen beim Sprachverständnis oder der Sprachgenerierung verglichen werden könnte, doch ich finde es naheliegend, dass auch bei der natürlichen Sprachverarbeitung ähnliche sequentielle (in der Kindheit erlernte) Vorgänge ablaufen wie wir sie uns beim Kopfrechnen (erst in der Schulzeit) angeeignet haben – nur eben unterhalb der bewussten Schwelle.

Überhaupt sind sehr viele bemerkenswerten Leistungen der menschlichen Zivilisation wie etwa das Bauen von Hütten und Häusern gemäss lokaler Tradition oder das Zubereiten von Gerichten durch die Fähigkeit des Menschen gekennzeichnet, Aufgaben in sinnvolle Unteraufgaben aufspalten zu können und diese dann sequentiell anzuwenden. Zwar kann ein Dompteur auch Tiere zu “Kunsttücken” trainieren, doch der Mensch ist hier sehr viel flexibler und die Flexibilität entstammt auch einem tieferen Verständnis des Menschen für die Logik, die hinter einem Lösungsprozess steht. Um wieder auf das Beispiel mit der Kopfrechnung “berechne 5 Prozent von (120 Euro * 12)” zurückzukommen, so ist jedem Menschen bewusst, dass diese Rechnung auf unterschiedliche Weise in mehreren möglichen Schrittreihenfolgen im Kopf gelöst werden kann, während Tiere, die Kunststücke lernen die innere Logik dieser erlernten Kunsstücke in der Regel nicht verstehen.

Ich behaupte nun einfach, dass auch unbewusst ablaufende Prozesse wie die Sprachverarbeitung bereits diese grundlegende Flexibilität des menschlichen Denkens ausnutzt.

Auf eine Formel gebracht bedeutet dies: Für den Menschen ist alles was er kann und was er an eingebauter Hardware hat in ganz verschiedenen Kontexten und in immer neuen Aggregationen verfügbar. Auch die Sprachfähigkeit des Menschen benutzt das Gehirn wie eine Toolbox. Nur ein kleiner Teil der Sprachfähigkeit ist damit wohl auf sprachspezifische Gehirnareale und sprachspezifische Gene zurückzuführen. Der grösste Teil der menschlichen Sprachfähigkeit ist einfach Ausdruck der hohen allgemeinen Intelligenz des Menschen und diese hohe allgemeine Intelligenz hat viel mit einer Flexibilität im Denken zu tun, die Tieren fehlt.

@KRichard

“ab dem 5. Schwangerschaftsmonat bewusst erinnern”

Das würde dann das autobiografische Gedächtnis betreffen. An welche persönlichen Ereignisse in der Fruchtblase erinnert sich das Kind denn nach der Geburt? Kann sich das Kind z. B. daran erinnern, dass es im 6. Schwangerschaftsmonat von der Mama eine rote Wollmütze gestrickt bekommen hat? Und wenn ja, woher weiß das Kind das dies im 6. Schwangerschaftsmonat geschah – außer von der Mutter.

“Experimente mit menschlichen Foeten im Mutterbauch zeigen, dass diese bis zum Ende der Schwangerschaft bereits gelernt haben, einzelne Laute, Silben und sogar Sprachmelodien zu unterscheiden.”

Ungeborene hören im Fruchtwasser der Fruchtblase anders als Erwachsene Schall in der Luft hören. Zunächst nehmen sie vor allem tiefe Töne wahr, nach und nach können sie auch höhere Frequenzen hören. Außerdem sind die Nerven zwischen Innenohr und Gehirn noch nicht voll ausgereift. Daher meine Frage: Wie wurden diese Experimente durchgeführt? Haben Sie Links zur peer-reviewten Fachliteratur in der diese Experimente beschrieben werden?

@Dramiga

Ich habe nur ein komplettes Erklärungsmittel für das Phänomen ´Nahtod-Erfahrung´(NTE) entwickelt, aber kein Mittel gegen Dummheit erfunden. Dies möchte ich deutlich klar stellen.

Wenn Sie mein NTE-Erklärungsmodell auch nur ein einziges Mal durchgelesen hätten – dann hätten Sie den Begriff ´zustandsabhängiges Erinnern´ gefunden:

Das WAS und WIE wir erinnern, hängt von unseren sinnlichen, körperlichen und intellektuellen Fähigkeiten ab – a) zu dem Zeitpunkt wo wir eine Erfahrung machen und im Gedächtnis abspeichern und b) zu dem Zeitpunkt wo diese Erfahrung wieder reaktiviert/erinnert wird.

Dies bedeutet, dass erlernte Erfahrungen beim Erinnern neu bewertet werden und zwar auf Grundlage unserer Fähigkeiten zum Zeitpunkt der Neubewertung. Dabei kann unser Wissen (deutlich) verändert werden.

Mit dem Begriff ´zustandsabhängiges Erinnern´(state dependent retrieval) kann man erklären, wie Erlebnisse beim Erinnern verändert werden (wie ALTE Erfahrungen in NEUES Wissen umgewandelt werden) – aber auch, wieso wir uns lebenslang als die gleiche Person empfinden, obwohl wir uns doch dauernd verändern.

Und nun zu Ihrer Frage zurück:

– um den 5. Schwangerschaftsmonat kann der Foetus Berührungen der Haut wahrnehmen – aber weder Gehör noch Sehsinn arbeiten: werden solche Erlebnisse erinnert, dann kann dies als angenehmes Körpergefühl bei vollkommener Ruhe/Stille erlebt werden *

– um die 20. Schwangerschaftswoche beginnt das Gehör zu arbeiten, im Mutterbauch sind Atem-, Verdauungs-, Sprach- und Herzschlag-geräusche zu hören: werden solche Geräusche erinnert, so werden diese oft als unangenehm empfunden (da wir in der Zwischenzeit ein Gefühl für Rhythmus entwickelt haben) **

– Wenn der Sehsinn arbeitet, so arbeiten zunächst wenige Sehzellen, aber die Anzahl der Sehzellen nimmt immer mehr zu. so dass mehrere Erlebnisse mit unterschiedlicher Lichtfläche nacheinander abgespeichert werden: werden diese Erlebnisse sehr rasch nacheinander erinnert, so entsteht die optische Illusion, sich auf ein größer werdendes Licht hin zu bewegen. (parallel dazu können akustische Erlebnisse erinnert werden) ***

– Wandelt sich die Lichtwahrnehmung von matt zu leuchtend hell – so entspricht dies gespeicherten optischen Erlebnissen vor(matt) bzw. nach(leuchtend hell) nach der Geburt. (D.h. die Geburt wird nur indirekt über die veränderte Lichtwahrnehmung erkennbar) ****

Erlebnisse in der Reihenfolge * > ** > *** > **** > … werden in vielen NTEs erlebt und berichtet. Diese erlebte/berichtete Reihenfolge stimmt genau mit der Entwicklung des Foetus zusammen. Korrelation = 1

D.h. dass man sich bei NTEs an Erlebnisse ab dem 5. Schwangerschaftsmonat erinnern kann, ist eine Annahme für die es nachvollziehbare Gründe gibt.

Es gibt viele Hundert NTEs, wo gleichartige Strukturen berichtet werden, solche nachvollziehbaren gleichartigen Strukturen nicht zu untersuchen ist ein wissenschaftliches Versäumnis. Und – um auf das Thema ´Sprachenlernen´ zu kommen: werden die lebenslang vorhandenen Erinnerungen an akustische Erfahrungen aus der Foetus-zeit in wissenschaftlichen Theorien ignoriert, dann fehlen diesen Theorien wichtige Grundlagen.

@Dramiga

DOI: 10.1073/pnas.1302159110/-/DCSupplemental ´babies learn to recognize words in the womb´, ´learning-induced neural plasticity of speech processing before birth´.

DOI: 10.1371/journal.pone.0078946 ´prenatal music exposure induces long-term neural effects´

DOI: 10.1093/cercor/bhq242 ´mother and stranger: an electrophysiological study of voice processing in newborns´(schon in den ersten 24 Std. nach der Geburt werden unterschiedliche Gehirnareale aktiv – je nachdem ob die Mutter oder eine fremde Frau gehört wird: d.h. das Baby erkennt und unterscheidet!)

http://www.sciencedaily.com/releases/2016/08/160819084631.htm ´maternal language shapes infant cry melodies´

DOI: 10.1016/j.infbeh.2013.12.007 ´emergence and retention of learning and memory in early fetal development´ (ab. 34. SSW ist Habituationseffekt auf bekannte Geräusche erkennbar = lernen und unterscheiden)

http://www.sciencedaily.com/releases/2017/07/170718084600.htm ´language development starts in the womb´ (Foetus erkennt/unterscheidet verschiedene Sprachen)

Die obigen Arbeiten zeigen, dass ein Foetus bereits akustische Reize intensiv verarbeitet und dabei lernt.

Und hier noch ein Beispiel für einen anderen Sinn:

DOI: 10.1093/chemse/25.6.729 ´human foetuses learn odours from their pregnant mother´s diet´

@all

Versuchen Sie durch mehrmaliges Lesen den Sinn der folgenden Notiz zu entschlüsseln:

A) “Leesn Sie enimal deiesn Txet. Wtteen Sie vetsehern ihn, owbhol er egitenilch uverntsädnilch ist.”

Wenn Sie zu dem folgenden Ergebnis kommen – dürfen Sie sich als Glückspilz betrachten:

B) “Lesen Sie einmal diesen Text. Wetten Sie verstehen ihn, obwohl er eigentlich unverständlich ist.”

(beide Zitate aus: Zeit Wissen 1/09: Was ist Realität?)

Wenn Ihr Gehirn aus einem völlig unsinnigen Buchstabensalat A) den sinnvollen Text B) gebildet hat – dann wurden dabei 10 von 14 Worten gefälscht; dies ist eine Fehlerquote von 71,4 %. Und Sie dürfen sich als Glückspilz betrachten – weil Sie ein Mensch sind: Ein Auto bei dessen Funktion 71,4 % Fehler auftritt – wäre sofort verschrottet worden.

Das obige Beispiel zeigt auch, dass unser Gehirn Sprachinformationen per Mustervergleich verarbeitet: Als Reaktionen auf neue Reizmuster A) werden im Gedächtnis vorhandene Reizmuster B) reaktiviert.

Chomsky’s universelle Grammatik welche eine Grammatik-Gen voraussetzt scheint mir wenig plausibel und die Entwicklungen im Bereich künstliche neuronale Netze verweisen auf ganz andere Mechanismen, welche uns beim Spracherwerb helfen: Nämlich

1) unsere Gabe komplexe und verrauschte Muster zu erkennen und

2) unsere Gabe komplexe Abbildungen von einer Repräsentation auf eine andere Repräsentation vorzunehmen.

Zu 2) Schon Tiere denken und haben wohl eine “Gedankensprache”, die etwa ein Subjekt mit einem Objekt verknüpft. Man kann ziemlich sicher sein, dass Schimpansen in ihrer “Gedankensprache” etwa Sätze kennen wie “Schimpanse B gibt mir eine Banane”. Wobei “Gedankensprache” eben nur bedeutet, dass der Schimpanse gedanklich dem Vorgang eine Bedeutung, eine Semantik zuordnet. Bevor es irgendeine menschliche Sprache gab, gab es bereits Vorgänge, die von den Mitgliedern einer (Tier-)gemeinschaft bewertet wurden, die eine Bedeutung, eine Semantik hatten. Bei der Entwicklung der menschlichen Sprache war es nun nur noch nötig, die Semantik in ein sprachliches Gewand zu hüllen. Umgekehrt erschliesst sich einem Mitglied der Gemeinschaft die Bedeutung eines Satzes, indem es dem Satz eine Semantik, eine Bedeutung zuordnet und diese Zuordnung erfolgt intuitiv, denn derjenige, der Sprache erwirbt ist/muss bereits mit Bedeutungen von Handlungen etwa vertraut sein noch bevor er mit dem Spracherwerb beginnt.

Sprachen erlernen

interessant dabei ist, dass man nach traumatischen Erlebnissen eine erlernte Sprache auch wieder “vergessen” kann.

In einem konkreten Fall wurde einem Mann das Bein amputiert, danach konnte er eine vorher gut beherrschte Fremdsprache nicht mehr sprechen.

Chomskys Universelle Grammatik versus “Usage-Based Models” des Spracherwerbs

Chomsky behauptet, Menschen besässen ein Sprachgen, welches Grammatikschablonen bereitstellt, die dann von Kindern, die die Sprache lernen nur noch mit konkreten Worten ausgefüllt werden müssen.

Als Konkurrenz gibt es schon lange das sogenannten “Usage-Based” Modell des Spracherwerbs gemäss dem man die Sprache über die Beobachtung der Häufigkeit der Verwendung von Worten, über das Erkennen von Mustern, die gewissen Sätzen/Aussagen gemeinsam sind und ähnlichem erlernt.

Chomsyky versus Usage – Unterscheidungsmöglichkeit: Wenn Chomsky recht hätte, könnten Kinder Sprache lernen noch bevor sie die Bedeutung der sie umgebenden Dingen verstehen. Sie würden einfach gehörte Worte ohne jedes Verständnis verwenden wobei sie für die Sprachgenerierung diese Worte in bereitstehende Sprachschoblonen füllen würden. Gemäss dem Usage-Modell wäre es wohl aber nötig, dass Kinder, die Sprache erlernen, die Gegenstände und die Welt über die sie reden bis zu einem gewissen Grad verstehen.

Oder noch plakativer formuliert: Ein Chomsky-Kind könnte sagen: “Gib mir den Apfel” obwohl es nicht weiss was ein Apfel ist ( es hat einfach das Wort gehört), während ein “Usage-Kind” diesen Satz vor allem sagen würde, weil es wirklich will, dass die angesprochene Person ihr den Apfel gibt, so dass das Kind mit dem Apfel spielen oder ihn essen kann.

K.Bednarek:

Betrifft lebenslange Erinnerungen an die Foetus Zeit…:

Ein sehr interessantes Thema ! Man kann davon ausgehen, dass hier keine bewusste Erinnerung zum Zwecke der Aufarbeitung erfolgen kann. Da der Foetus aber bereits für Emotionen zugänglich ist, Situationen somit bereits werten und bewerten kann, ist es vorstellbar, dass hier eine unbewusste Abspeicherung von ExtremSituationen der Außenwelt bzw. vom psychischen Zustand seiner Mutter in seinem “Körper” auf der Basis von positiven und negativen Empfindungen stattfindet.

Dieses geschieht generell unbewusst und wenn dieser Foetus zum Kind oder Erwachsenen reift, hat er diese abgespeicherte Empfindung immer noch, nur er kann damit bewusst nichts anfangen,da ihm die Erinnerung fehlt. Menschen sind somit auf dieser Ebene für ihr Leben gezeichnet, da sie ihr agieren und reagieren auf bestimmte Lebenssituationen nicht bewusst erklären können.Für die Aufdeckung dieser unbewusst handelnden Muster,die auch schädlich sein können, gibt es verschiedene tiefenpsychologische Ansatzversuche….

@Golzower

In meinem allerersten Beitrag habe ich (off topic) geschrieben, dass Erlebnisse ab dem 5. Schwangerschaftsmonat lebenslang dem bewussten Erinnern zugänglich werden – wenn im Rahmen von NTEs Erinnerungen in zeitlich/hierarchisch aufsteigender Reihenfolge reaktiviert werden.

@Martin Holzherr

…Stephen Jay Gould, argues that contrary to what most linguists claim, language is not a specialised mechanism based on brain modules and that it did not evolve specifically for its most obvious present purpose, communication. On the contrary, it represents the specific implementation of a more general mechanism that evolved earlier for other reasons, namely thinking. In Gould’s theory, language is rooted in a system that gave our ancestors a more sophisticated way to mentally represent the world….. Only later did this system get repurposed or extended into a means of communication. In this view, then, thinking was an exaptation – a mechanism that originally evolved for one function and then provided the opportunity, for something very different (in this case language) to evolve.

V.S. Ramachandran, The Tell-Tale Brain, S. 166

Wenn Kinder bis zum 8.-10. Lebensjahr keine Gelegenheit haben, mit anderen Menschen den Gebrauch von Sprache einzuüben und/oder die Bedeutung von Wörtern zu lernen – dann können sie später gar nicht mehr oder nur sehr schlecht das Sprechen lernen [Wolfskinder]

Auch dies spricht gegen die Idee von ´Sprachmodulen´.

Neuronale Netzwerke sind gute Modelle für die frühe Informationsverarbeitung in Retina und visuellem Cortex

Als Ergänzung zu Joe Dramigas Exkurs über Deep Learning und Pyramidenzellen der Grosshirnrinde möchte ich hier den arxiv-Artikel A UNIFIED THEORY OF EARLY VISUAL REPRESENTATIONS FROM RETINA TO CORTEX THROUGH ANATOMICALLY CONSTRAINED DEEP CNN’s verlinken, wo spezielle neuronale Netzwerke, nämlich sogenannte Convolutional Neural Networks wie sie für die Verarbeitung von Bildern eingesetzt werden, dazu herangezogen werden die frühe visuelle Verarbeitung von Wirbeltieren zu modellieren. Die Kurzzusammenfassung übersetzt sich (mit DeepL) zu folgendem:

Das visuelle System der Wirbeltiere ist hierarchisch organisiert, um visuelle Informationen in aufeinanderfolgenden Phasen zu verarbeiten. Neuronale Repräsentationen variieren drastisch zwischen den verschiedenen ersten Schritten der visuellen Verarbeitung: Am Ausgang der Netzhaut weisen ganglionzellrezeptive Felder (RFs) eine klare antagonistische Center-Surround-Struktur auf, während im primären visuellen Kortex (V1) typische RFs scharf auf eine genaue Ausrichtung abgestimmt sind. Es gibt derzeit keine einheitliche Theorie, die diese Unterschiede in den Darstellungen zwischen den Schichten erklärt. Hier zeigen wir mit Hilfe eines tiefen neuronalen Faltungsnetzwerks (Convolutional Neural Networks), das auf Bilderkennung als Modell des visuellen Systems trainiert wurde, dass solche Unterschiede in der Darstellung als direkte Folge unterschiedlicher neuronaler Ressourcenbeschränkungen auf den Netz- und Kortikalnetzen auftreten können, und zum ersten Mal finden wir ein einziges Modell, aus dem beide Geometrien spontan in den entsprechenden Phasen der visuellen Verarbeitung hervorgehen. Die Hauptbeschränkung ist eine reduzierte Anzahl von Neuronen am Netzhautausgang, die mit der Anatomie des Sehnervs als strengem Engpass übereinstimmt. Zweitens stellen wir fest, dass für einfache nachgelagerte kortikale Netzwerke visuelle Darstellungen am retinalen Ausgang als nichtlineare und verlustbehaftete Merkmalsdetektoren auftreten, während sie als lineare und treue Encoder der visuellen Szene für komplexere kortikale Netzwerke auftreten. Dieses Ergebnis sagt voraus, dass die Netzhaut kleiner Wirbeltiere (z.B. Salamander, Frosch) anspruchsvolle nichtlineare Berechnungen durchführen und dabei direkt verhaltensrelevante Merkmale extrahieren sollte, während die Netzhaut großer Tiere wie Primaten die visuelle Szene meist linear kodieren und auf eine viel größere Bandbreite von Reizen reagieren sollte. Diese Vorhersagen könnten die beiden scheinbar inkompatiblen Ansichten der Netzhaut miteinander in Einklang bringen, indem sie entweder eine Merkmalsextraktion oder eine effiziente Kodierung natürlicher Szenen durchführen, indem sie vorschlagen, dass alle Wirbeltiere auf einem Spektrum zwischen diesen beiden Zielen liegen, abhängig vom Grad der neuronalen Ressourcen, die ihrem Sehsystem zugewiesen sind.

Fazit: Das ist nur ein Artikel von vielen, die versuchen eine Beziehung zwischen künstlichen neuronalen Netzwerken und natürlichen neuronalen Netzwerken herzustellen. Selber habe ich nach Studium mehrerer solcher Arbeiten den Eindruck erhalten, dass eine direkte Korrelation zwischen künstlichen neuronalen Netzwerken wie sie im Zusammenhang mit dem Deep Learning verwendet werden und natürlichen neuronalen Geweben nur in gewissen speziellen Fällen eine grosse Übereinstummung, eine deutliche architektonische Verwandtschaft auszumachen ist. Im allgemeinen sind natürliche neuronale Netzwerke zu komplex als dass sie sich auf die heute im Bereich des Deep Learning verwendeten künstlichen neuronalen Netzwerke reduzieren lassen.

@ Joe Dramiga (Sprache und Denken): Danke für das Fragment aus einem Text von Stephen Jay Gould, welches zusammengefasst aussagt, dass für ihn Sprache auf der schon bei Tieren vorhandenen Fähigkeit zu Denken aufsetzt. Das entspricht genau meiner Überzeugung. Es gibt aber nicht wenige – vor allem Geistewissenschaftler – die die Fähigkeit zum Denken überhaupt erst Menschen zugestehen und einige – wiederum vor allem Geisteswissenschaftler – behaupten sogar, Denken sei nichts anderes als stummes Sprechen mit sich selbst. In meinen Augen ist das kompletter Unsinn. Denken ist die Grundlage von Sprechen und Sprechen setzt Denken voraus – nicht umgekehrt.

Und auch in Bezug auf die Definition dessen was Denken überhaupt ist, entspricht die Auffassung von Stephen Jay Gould der meinigen. Er schreibt hierzu: In Gould’s theory, language is rooted in a system that gave our ancestors a more sophisticated way to mentally represent the world….

Ja, Denken bedeutet nichts anderes als die Fähigkeit die Aussenwelt innen wieder zu spiegeln, um die Aussenwelt und das Erlebte mental zu repräsentieren. Diese Repräsentation entspricht noch nicht der menschlichen Sprache – nicht einmal entfernt. Die menschliche Sprache dient nicht primär dem Denken, sondern der Kommunikation.

Ergänzung zu meinem Kommentar vom 15. Januar 2019 10:28

Ich erlebe bis zu einem gewissen Grade meinen eigenen Verbalisierungsprozess als Prozess der Konkretisierung, der sehr viel aus der reichen inneren Repräsentation eines mentalen Zustands einfach wegschneidet – wegschneidet und entfernt, weil Sprache der Kommunikation dient und nicht etwa der Wiedergabe meines privaten mentalen Zustandes oder privater Gedanken. Mir scheint naheliegend, dass das viele so erleben und dass diejenigen, die etwas anderes behaupten, die beispielsweise behaupten, sie teilten mit Sprache mit, was sie denken, dass diese Leute einfach lügen. Nein, Sprache hatte noch nie die Aufgabe Gedanken mitzutteilen, sondern sie hat wohl eher die Aufgabe Absichten, Intentionen einerseits mitzuteilen, andererseits eigene Absichten und Intentionen dem anderen (dem Gesprächspartner) unterzujubeln indem man den anderen unter anderem mit dem Mittel der Sprache im eigenen Sinne beeinflusst.

@Holzherr

Denken als stummes Sprechen mit sich selbst zu betrachten – ist kein Unsinn. Denn Gehirnaktivität und Körperreaktion sind oszillierend vernetzt und beeinflussen sich gegenseitig.

Wenn man z.B. ein Buch mit emotionalem Inhalt liest, dann reagiert parallel dazu die Gesichtsmuskulatur auf den gelesenen Inhalt. Unterbindet man die Bewegung von Gesichtsmuskulatur – z.B. durch Botox-Injektionen – dann wird das Verständnis des Textes erschwert/verändert. (dazu gab es schon einige Experimente)

@Holzherr: weitere Beispiele wie Denken-Gesichtsmuskulatur zusammenhängt

DOI: 10.1093/cercor/bhn104 ´The link between facial feedback and neural activity within central circuitries of emotion. New insights from botulinum toxin-induced denervation from muscles´. (Hennenlotter u.a.)

http://www.sciencedaily.com/releases/2016/05/160512085113.htm ´Emotions in the age of botox´.

DOI: 10.1016/j.toxocon.2016.04.044 ´Deeper than skin deep – the effect of botulinum toxin-A on emotion processing´

@KRichard: Denken umfasst auch Sprache, lässt sich aber nicht auf Sprache reduzieren. Auch wer liest denkt mit und dieses Mitdenken geht fast immer über das hinaus, was man liest. Gerade weil Lesen eine ganze Welt evozieren kann gibt es überhaupt begeisterte Leser. Heute, im Zeitalter des Kinos und Fernsehen gibt es auch immer mehr Romanautoren, die sehr visuell erzählen, so dass der Leser sich beim Lesen seinen eigenen Film konstruieren kann.

Der Wikipedia-Eintrag zu Denken scheint mir recht gut. Er verweist unter anderem auf Kahnemanns Buch „Schnelles Denken, Langsanes Denken.“ Schnelles Denken bedeutet dabei das unmittelbare Schlussfolgern, die spontane Einschätzung der Lage. Dies geht so schnell, dass Sprache keine entscheidende Rolle dabei spielt, wobei man im Nachhinein den schnellen Denkprozess durchaus versprachlichen kann. Sprache dient letztlich immer der Kommunikation, Denken aber dient dem eigenen Verständnis, Denken will aus dem was passiert einen Sinn generieren, so dass man sinnvoll darauf reagieren kann. Klar kann man das Gedachte nachträglich in Worte fassen – und das muss man sogar, wenn man es jemand anderem mitteilen will.

@Holzherr

In meinem NTE-Erklärungsmodell (per Google [Kinseher NDERF denken_nte] als PDF findbar) – beschreibe ich auf Seite 4 ´Denken´ als Ergebnis einer simplen Mustervergleichsaktivität mit 3 Regeln. Ich habe versucht den Text so zu gestalten, dass ihn schon ein Hauptschüler verstehen kann (ohne Fachbegriffe).

Bei NTEs kann man bewusst erleben, wie Denken funktioniert – Wie ein einzelner Reiz/Gedanke verarbeitet wird. Dieser direkte Zugang zur Arbeitsweise des Gehirns ist einzigartig – und daher ist bedauerlich, dass NTEs bisher von der Wissenschaft ignoriert werden!

Diese 3 Regeln stimmen mit aktuellem Fachwissen überein: Kahnemann´s ´thinking fast (= 3A), thinking slow (= 3B) – dazu ist als Hintergrundwissen die ´predictive coding theory´ und auch Prof. Giulio Tononi´s ´Integrierte Informationstheorie´ zu nennen.

Ich habe noch eine Arbeit gefunden, die Sie zum Thema ´Denken = Sprechen´ interessieren könnte: man hat per Elektroden auf dem Gehirn die Aktivität von 100 Muskeln beobachten können, die beim Sprechen beteiligt sind.

http://www.sciencedaily.com/releases/2018/06/180601134731.htm ´Brain activity patterns underlying fluent speech revealed: Research could pave the way for the brain prostetic to translate thoughts into speech´

DOI: 10.1016/j.neuron.2018.04.03 ´Encoding of articulatory kinematic trajectories of human speech in sensorimotor cortex´

Wir neigen dazu, automatisch gefällte Entscheidungen nicht als Produkt des Denkens zu sehen. Dass es überhaupt so etwa wie automatische Entscheidungen gibt, fällt teilweise erst Roboterforschern auf, die beispielsweise einen Greifarm vor die Aufgabe stellen, aus einer Kiste voller ganz verschiedener Dinge eines nach dem anderen zu ergreifen. Für den Menschen überhaupt kein Problem, für einen Roboter aber eine äusserst schwierige Aufgabe sowohl für seine Greifwerkzeuge (es gibt feste, verformbare, gelartige Objekte) als auch für seine visuelles Verarbeitungssystem (bestimmte Objekte spiegeln, andere sind schwarz und scheinbar kantenlos).

Folgerung: Das Ergreifen einer Rasierklinge, eines Wollknäuels oder einer Glasscherbe durch einen Menschen sind alles Resultate von Denkprozessen, die auf Erfahrung und Erkenntnis beruhen und die später halbautomatisch ausgeführt werden können. Es sind Beispiele von schnellem Denken. Schnelles Denken hat wenig mit Sprache zu tun und es gibt es bereits bei Tieren. Wie alles Denken hat aber auch schnelles Denken mit Verständnis und Erkenntnis zu tun, wobei die eigentliche Erkenntnis schon lange vor der Handlung passiert, die aus schnellem Denken resultiert. Wenn wir den Eingangssatz der Wikipedia zu Denken nehmen (Zitat): Unter Denken werden alle Vorgänge zusammengefasst, die aus einer inneren Beschäftigung mit Vorstellungen, Erinnerungen und Begriffen eine Erkenntnis zu formen versuchen, so müssen wir uns bewusst sein, dass Entscheidungen auch auf frühere Denk-/Erfahrungsprozesse zurückgehen können. Solche Entscheidungen wie man beispielsweise eine Rasierklinge ergreift, können sehr schnell gefällt werden und werden uns oft gar nicht bewusst, denn wir rufen dabei die Ergebnisse früherer Denkprozesse ab.

@Holzherr

Als Reaktion auf einen Reiz wird, wenn möglich, sofort eine identische/vergleichbare Erfahrung reaktiviert – dies ist eine Überlebensfunktion, welche eine sofortige, schnellste Reaktion ermöglicht (= schnelles Denken).

Ist ein Reiz aber unverständlich, dann ändert das Gehirn den Fokus seiner Aufmerksamkeit und beginnt mit einer systematischen Suche nach Handlungsalternativen (= langsames Denken)

Beide Strategien sind im Rahmen einer ´Nahtod-Erfahrung´ eindeutig erkennbar – und ich habe sie in meinem Erklärungsmodell beschrieben

Dieses Beispiel zeigt, dass unser Gehirn je nach Situation zwischen unterschiedlichen Strategien wählen kann.

Zusätzlich haben wir noch die Möglichkeit, eine schon getroffene Entscheidung nochmals zu überdenken (= langsames Denken) – d.h. wir sind nicht gezwungen einer ersten Reaktion/Idee zu folgen.

Alle unsere Reaktionen sind eine Ergebnis von Denkprozessen – ganz egal, ob sie bewusst oder unbewusst ausgeführt werden. Ob Sprache ein Teil einer Reaktion ist – oder nicht, hat nur mit der Art des Reizes zu tun, der aktuell verarbeitet wird. Wenn wir z.B. Treppen steigen oder Rad fahren – brauchen wir die Sprache üblicherweise nicht.

Dies kann so oder so bestimmt werden, das Tier ist zur Kommunikation fähig und ob Sprache vorliegt kann von denjenigen formuliert werden, die sprechen (und verstanden werden) können.

Bleibt also im Definitorischen.

Joe, ist ein hartes Brot, vgl. auch mit Ihrem :

Es wird halt auf eine grundsätzlich nicht umfänglich zu verstehende CPU geschaut und insofern theoretisiert wie spekuliert.

Eine Kontinuität der hier gemeinten und biologisch feststellbaren Entwicklung, auch im zoosemiotischen Sinne, würde Dr. Webbaer nicht ausschließen wollen, weil sozusagen auf der Hand [1] liegend.

Vgl. auch mit diesem Jokus :

MFG

Dr. Webbaer

[1]

Metaphorik wie „auf der Hand liegend“ (vgl. auch an dieser Stelle mit Ihrem ‘wie ein Trittbrettfahrer’) deutet darauf hin, dass der hier gemeinte Primat, ein Nasentrockenprimat liegt aus biologischer Sicht zweifelsfrei vor, auch heute noch sehr „erdig“ Sprache bildet, sich an Altvorderen, am irdisch Gegebenen festhält, nicht aus seiner Haut kann, sozusagen.

Sprache ist auch heute noch sehr irdisch, auch wenn viele Bedeutungssprünge stattgefunden haben, bleibt es etymologisch oft doch möglich vglw. genau zu verstehen, was gesagt worden ist, nämlich Irdisches, sozusagen.

Womit Dr. Webbaer nicht sagen bzw. schreiben will, dass sich dbzgl. Forschung nicht lohnt, es soll sich schon bestmöglich angenähert werden an das was ist oder zu sein scheint, im Sprachlichen.

‘Wir’ ja nicht, Dr. Webbaer also von diesem ‘Wir’ ausgenommen, denn eine Automatik liegt nicht vor, wenn zeitnah, quasi automatisch (die Automation meint eigentlich nicht vom erkennenden Subjekt direkt abhängige Handlung, präziser wäre hier der Versuch mit dem Wort ‘Reflex’), gehandelt wird, so dass Sie also womöglich den Reflex meinen, nicht die spontane und sehr zeitnahe Handlung von Erkenntnissubjkekten.

Die Robotik hat gelernt, dass anscheinende intuitive Entscheidungen des Subjekts teils hoch komplex sind und teils äußerst mühsam nachgebaut werden müssen, wie bspw. das Gehen oder Greifen.

Q: Wo kommt nun diese Handlungsfähigkeit her?

A: Nicht aus dem Sprachlichen, sondern aus untergelagerter Überlegung des Subjekts, das dann sozusagen erst handelt (und vielleicht später darüber spricht).

Aus atonaler Übung sozusagen, die Sprache ist ja nicht alles, was befähigt.

Zoosemiotisch sozusagen dann greifbar.

Nicht nur böse Zungen meinen, dass ca. 99,99 % der humanen Handlung erst einmal außerhalb des Sprachlichen steht, so dass erst post festum, Sigmund Freud finanzierte seinen Lebensunterhalt mit dieser Einsicht, aber nicht nur der, darüber gesprochen, am besten geredet werden kann.

Die Sprachlichkeit, die Logik, ist sozusagen etwas, das auf den Individuen schwimmt und nur bei besonderem Bedarf hervorgeholt wird, bspw. zuletzt von Ihnen, Herr Martin Holzherr, oder von Dr. Webbaer.

MFG

Wb

Sprach-Muster-Erkennung bei 3 Tage alten Babys

http://www.sciencedaily.com/releases/2019/01/190129101912.htm

´Newborn babies have inbuilt ability to pick out words´

Wissenschaftler übersetzen Gedanken in Sprache