Entropie und Information: Treibstoff des Universums

BLOG: Das Zauberwort

Die dunklen Tage zwischen Wintersonnenwende und Jahreswechsel sind die Zeit der Kaminfeuer und des Feuerwerks, von Tee und Glühwein, des Rückblicks auf Nachrichten und das Jahresgeschehen, des Nachsinnens über das Leben, Möglichkeiten und Realitäten, Wertvolles und Wertloses, Gutes und Böses und das Vergehen der Zeit selbst.

Aus der Perspektive der Physik sind alle diese Dinge, von Feuer, Feuerwerk und Heißgetränk, über Nachrichten und Geschehen, bis hin zu Leben, Werten, Gut und Böse und der Zeit selbst untrennbar verbunden mit einem Konzept, dessen Mächtigkeit kaum überschätzt werden kann: Der Information, und ihres auf engste verwandten Gegenspielers – der Entropie. Tatsächlich sind Entropie und Information wie die zwei gegensätzlichen Gesichter eines Januskopfes, eines lachend, eines weinend – oder die zwei widersprüchlichen Temperamente des Dr. Jekyll alias Mr. Hyde.

Die abstrakte, unanschauliche Entropie ist dabei älter als die heute allgegenwärtige Information. Sie stammt aus dem 19. Jahrhundert, der großen Zeit der Dampfmaschinen, und wurde erstmals eingeführt von dem deutschen Physiker Rudolf Clausius, der 1865 schrieb [1]:

“Die Energie der Welt ist konstant. Die Entropie der Welt strebt einem Maximum zu.”

Der zweite Satz dieser Weisheit ist heute als “2. Hauptsatz der Thermodynamik” bekannt: Er beschreibt Prozesse, die nur in einer Richtung ablaufen. Warum z.B. erwärmt sich Milch, die in einen heißen Tee gegossen wird, während sich der Tee selbst etwas abkühlt? Wenn nur Energieerhaltung gelten würde, könnte das ganze auch andersherum ablaufen, die Milch würde noch kälter und der Tee noch heißer werden. Die Zunahme der Entropie aber erfordert, dass sich die Temperatur angleicht – zumindest, so lange man nicht von außen Energie aufwendet, um den Temperaturunterschied zu erhöhen. Auf diese Weise bestimmt die Entropie, was passiert, also welche Prozesse überhaupt ablaufen, und in welcher Richtung sie verlaufen.

Was Entropie wirklich ist, konnte erst der österreichische Physiker Ludwig Boltzmann entschlüsseln. Er verstand die thermodynamischen Gesetze als Folge statistischer Verteilungen der Atome und Moleküle. Temperatur ist dann nichts anderes als die durchschnittliche Energie dieser Teilchen. Dabei gilt: Wer Statistik betreibt und mit durchschnittlichen Größen arbeitet, der besitzt oder nutzt nicht die vollständige Information über den Zustand eines physikalischen Systems: Statt des Wissens über die Energie jedes einzelnen Teilchens (dem sogenannten “Mikrozustand”) ist nur die durchschnittliche Energie (der sogenannte “Makrozustand”) bekannt. Der gleiche Durchschnitt kann dabei auf viele verschiedene Weisen realisiert werden, eine Zahlenreihe mit zwei 2en hat Durchschnitt 2, genauso wie eine Zahlenreihe, die aus 1 und 3 besteht. Entropie beschreibt dabei die Anzahl der möglichen Mikrozustände in einem Makrozustand, oder genauer: Entropie ist definiert als der (normierte) Logarithmus der Zahl der Mikrozustände, die einem Makrozustand entsprechen. Da angenommen werden kann, dass alle Mikrozustände gleich wahrscheinlich sind, gilt: Die Größe der Entropie gibt somit Aufschluss darüber, wie wahrscheinlich ein Makrozustand ist. Und in physikalischen Prozessen nimmt die Entropie dann deshalb zu, weil sich der unwahrscheinlichere Makrozustand zum wahrscheinlicheren hin entwickelt.

Damit wird Entropie zu einem informationstheoretischen Konzept: Entropie ist die Information, die fehlt, um einen konkreten Mikrozustand im Makrozustand zu identifizieren. Und genau dieses Verständnis begründet die Mächtigkeit des Konzepts: Plötzlich lässt sich Entropie nicht nur auf Gase und Dampfmaschinen anwenden, sondern universell! Wobei Entropie auch eine subjektive Komponente hat: Ob ein Mikrozustand nämlich einem Makrozustand niedriger oder hoher Entropie zugeordnet wird, ist eine Frage der Definition oder des verfügbaren Wissens.

Das tut der Allgegenwart von Entropie freilich keinen Abbruch. Denn auch wenn Entropie zu einem gewissen Maß subjektiv ist, spielt unser Leben sich in Makrozuständen ab: Statt von Atomen und Elementarteilchen sprechen wir von Menschen und Wetter, von Nachrichten, Gesetzen und der Wirtschaft. Oder von Autos.

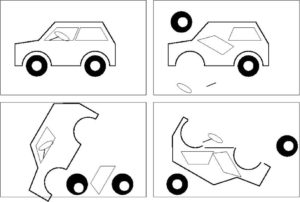

Warum zum Beispiel gehen funktionierende Autos kaputt, während kaputte Autos sich selten von selbst reparieren? Die Antwort ist: Entropie! Ein funktionierendes Auto ist eines, an dem jedes Teil an seinem Platz ist und auf vorhergesehene Weise funktioniert. Das ist auf genau eine Weise realisierbar: Der Makrozustand “heil” entspricht genau einem Mikrozustand, d.h. er hat Entropie null.

Ein kaputtes Auto kann dagegen auf viele Weisen kaputt sein: Vielleicht ist das linke Vorderrad lose? Im Motor hat sich eine Benzin- oder Abgasleitung gelöst? Die Windschutzscheibe ist zersplittert und liegt auf dem Asphalt? Das Steuer ist nicht mehr mit den Rädern verbunden? Alles ganz verschiedene Mikrozustände unseres Autos, die unter dem Makrozustand “kaputt” summiert werden. Also gehen Autos kaputt, weil der Makrozustand heil viel unwahrscheinlicher ist als der Makrozustand kaputt, der auf viel mehr mögliche Weisen (durch viel mehr Mikrozustände) realisiert werden kann und damit höhere Entropie hat. Und: Wer einen Haufen Schrauben, Metall und Gummi durchschüttelt, wird dabei kaum zufällig ein funktionierendes Auto erhalten. Andersherum ist es durchaus wahrscheinlich mit einem Haufen Schrauben, Metall und Gummi zu enden, wenn man sein Auto einen Abgrund herunter fährt.

Das gleiche gilt beim Würfelspiel: Beim Wurf mit zwei Würfeln ist die wahrscheinlichste Gesamt-Augenzahl die ,,Sieben”. Der Grund dafür ist nicht, dass auf dem einzelnen Würfel eine bestimmte Augenzahl wahrscheinlicher ist als eine andere, sondern, dass es mehr Möglichkeiten gibt, mit zwei Würfeln eine ,,Sieben” zu würfeln (nämlich sechs: ,,16″, ,,25″, ,,34″, ,,43″, ,,52″, ,,61″) als z.B. eine ,,Zwölf”, für die es nur eine einzige Möglichkeit gibt (nämlich ,,66″). Deshalb ist die Gesamtaugenzahl ,,Sieben” genau sechs mal so wahrscheinlich wie die ,,Zwölf”. Hier ist die Gesamtaugenzahl der Makrozustand: der Zustand der Würfel, den wir durch die für uns interessanten (oder wahrnehmbaren bzw. experimentell zugänglichen) Eigenschaften charakterisieren. Der Makrozustand ,,Sieben” entspricht den sechs Mikrozuständen ,,16″, ,,25″, ,,34″, ,,43″, ,,52″, ,,61″, der Makrozustand ,Zwölf” entspricht dem Mikrozustand ,,66″. Weil es viel wahrscheinlicher, aus einer ,,Zwölf” im Würfelbecher durch Würfeln eine ,,Sieben” zu erhalten als umgekehrt, nimmt die Entropie normalerweise zu. Niedrige Entropie entspricht dabei Ordnung (beide Würfel ordentlich auf die gleiche Seite gedreht oder jede Schraube im Auto an seinem Platz), hohe Entropie Unordnung (die Würfel in einem beliebigem Zustand, den sie mit hoher Wahrscheinlichkeit annehmen).

Und daraus folgt auch der Zusammenhang zwischen Entropie und Energie: um einen hochentropischen chaotischen Zustand in einen geordneten niederentropischen Zustand zu verwandeln (z.B. ein Zimmer aufzuräumen oder ein Auto zu reparieren oder bei einer großen Anzahl von Würfeln die Sechsen nach oben zu drehen) muss man Energie aufwenden, und das heißt immer, niederentropische Energie in höherentropische Energie verwandeln. Wenn man z.B. den Kamin anfeuert und die Wohnung heizt, also den Temperaturunterschied zwischen kalter Winternacht und heimeliger Stube erhöht, nimmt die Entropie in Stube und Winternacht zwar ab, dafür verbrennt man aber Holz, Öl oder Kohle, und verteilt die Energie dieser fossilen Brennstoffe, die in einer geordneten Kohlenstoffstruktur gespeichert war, durch Vermischung und Verbindung mit der umgebenen Luft: die Gesamtentropie nimmt zu. Genauso explodiert Feuerwerk, weil dadurch die Entropie zunimmt.

Niedrige Entropie oder Ordnung ist also die Essenz von Ressourcen, und das Verschwenden von Ressourcen ist immer mit Entropiezunahme verbunden: Kohle, Gas, Holz, Öl und Schwarzpulver haben niedrige Entropie, warme Luft und Asche hohe.

Damit ist die Entropie auch untrennbar mit der Ethik verknüpft: Denn zweifellos gedeiht Böses besonders gut in Konflikten um Ressourcen. Die Verschwendung von Ressourcen ist somit zweifellos böse, während – frei nach Wilhelm Busch: “Das Gute – dieser Satz steht fest – ist stets das Böse, was man lässt”, die Vermeidung sinnloser Entropieerhöhung gut sein muss. Und die meisten Verbrechen bis hin zum Mord sind durch Entropieerhöhung charakterisiert:

Denn genauso wie ,,Heil sein” niedrige Entropie hat, ,,kaputt sein” hohe, gilt: Leben hat niedrige Entropie, tot sein hohe (ganz einfach weil es viel weniger Möglichkeiten gibt, lebendig zu sein – also so ziemlich alle Organe an ihrem Platz und intakt – als tot (z.B. Kopf abgerissen, Herz rausgerissen, Blut aus dem Körper geflossen, lebenswichtige Adern verstopft usw.). Geordnete Strukturen wie das Leben funktionieren nur, weil biologische Organismen durch die Umwandlung niederentropischer Energie – z.B. in Form von Nahrung – in hochentropische Wärme umwandeln. Und fast jede Form der Entstehung von Nahrung beruht in letzter Konsequenz auf der Photosynthese. Leben nutzt also typischerweise letztlich die Energiereserven der Sonne (eine mögliche alternative Energiequelle ist der Vulkanismus im Erdinnern). Als der legendäre Quantenphysik-Pionier Erwin Schrödinger 1944 in seinem Buch “Was ist Leben?” [2] über die Grundlagen der Biologie nachdachte und damit entscheidend Forscher wie James Watson und Francis Crick bei der Entwicklung der Molekularbiologie inspirierte, sprach er von biologischer Information als “Negentropie”: negativer Entropie.

Und auch diese Vorstellung lässt sich verallgemeinern: Als vier Jahre später Claude Shannon, der Begründer der Informationstheorie, nach einem Namen für den Informationsverlust bei der Datenübertragung in Telegrafenleitungen suchte, riet ihm John von Neumann, Universalgenie, Quanten-, Bomben-, Computer- und Spieltheorie-Pionier sowie Autor der “Mathematischen Grundlagen der Quantenmechanik”:

“Du solltest es Entropie nennen, aus zwei Gründen: Erstens wurde das Konzept in der statistischen Mechanik unter diesem Namen benutzt. Es hat also schon einen Namen. Und zweitens und wichtiger, niemand weiß, was Entropie wirklich ist, also wirst du in einer Diskussion immer einen Vorteil haben.”

Shannon verstand Entropie also als Maß für Information und verband so Thermodynamik mit Informationstheorie [3]. Wenn die Entropie eines Makrozustands charakterisiert ist durch die Anzahl möglicher Mikrozustände, dann entspricht die Entropie der Information, die fehlt, um den entsprechenden Mikrozustand vollständig zu beschreiben. Information ist dann die Differenz der Entropie eines bestimmten Makrozustands und der Entropie des Makrozustands mit der größtmöglichen Entropie. Entropie wird damit gleichsam fehlende Information, und damit zum Gegenspieler des Begriffs, der für rationale Entscheidungen, politische Transparenz und Demokratie unabdingbar ist.

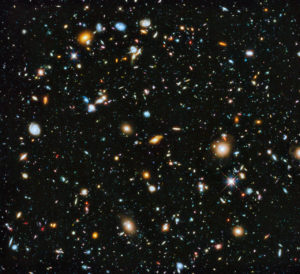

Letztlich ist die niedrige Entropie am Anfang des Universums auch die Vorbedingung dafür, dass sich überhaupt Dinge in eine Richtung entwickeln (nämlich in Richtung der Entropiezunahme), dass wir Ressourcen nutzen können und dass geordnete Strukturen und Leben überhaupt möglich sind.

Ja, dafür, dass überhaupt etwas passiert! Ohne niedrige Entropie am Anfang des Universums gäbe es nur einen chaotisch durchmischten Einheitsbrei von Teilchen. Oder wie der US-Kosmologe Sean Carroll es ausgedruckt: ,,Wir surfen alle auf einer Welle ansteigender Entropie” [4].

Und vielleicht steckt die Entropie sogar hinter der Zeit selbst: Was wir im täglichen Leben als Zeit erleben, ist eigentlich die Zunahme von Entropie. Das ist leicht zu verstehen, wenn man Filme vorwärts und rückwärts schaut: Sieht man in einem Film eine zersprungene Kaffeetasse auf dem Fussboden, die sich mit Hilfe der durch Abkühlung der Luft in ihrer Umgebung gewonnenen Energie zusammensetzt, dabei den verflossenen Kaffee aufsammelt und auf den Tisch hüpft, dann ist man sicher, den Film im Rücklauf zu schauen. Viele Physiker glauben deshalb, dass Zeit selbst nur eine Beschreibung der Zunahme von Entropie ist.

Ja, selbst was wir als Realität betrachten, unsere Alltagswelt, in der sich Dinge an bestimmten Orten befinden und konkrete Eigenschaften haben, hängt mit Entropie zusammen. Denn diese Alltagswelt funktioniert nach den Gesetzen der klassischen Physik, und die ist nur ein Grenzfall der Quantenmechanik. In der Quantenmechanik dagegen hat ein physikalisches System alle Eigenschaften, die physikalisch möglich sind, bis eine Beobachtung oder Messung entscheidet, welche dieser Eigenschaften “realisiert” wird. Dieser Messprozess lässt sich nun mit den Gesetzen der Quantenphysik beschreiben, als ein Phänomen, das den Namen Dekohärenz trägt und 1970 von dem Heidelberger Physiker H. Dieter Zeh entdeckt wurde. Dekohärenz beschreibt, wie durch die Wechselwirkung beim Messprozess Information in die Umgebung von System und Messapparat abgeleitet wird. Da diese Information für einen lokalen Beobachter verloren ist, kann man zeigen, dass der Beobachter nur noch eine der möglichen Realitäten wahrnehmen kann, während die anderen Realitäten den unbeobachtbaren Parralleluniversen von Hugh Everetts Vieler-Welten-Interpretation entsprechen. Der Informationsverlust beim Messprozess, der zur Enstehung einer klassischen Realität führt, ist dabei gleichbedeutend mit Entropiezunahme, der sogenannten Von-Neumann-Entropie.

Damit werden Zeit und Realität selbst freilich zu Phänomenen, die von unserer Perspektive abhängen und keine fundamentalen Eigenschaften des Universums selbst sind. Philosophen nennen solche Konzepte emergent. Ob das wirklich so ist, ist bisher offen. Zweifellos aber bestimmen Entropie und Information die Welt, in der wir leben. Und bilden gleichfalls eine Klammer zwischen uns und der Welt. Sie beschreiben die Verbindung zwischen dem fundamentalen Universum und unserer Perspektive darauf. Wir sind gleichsam Teil des Universums und bestimmen mit unserer Perspektive ganz entscheidend, wie wir die Welt erleben. Und:

Die Welt ist wunderbar!

[1] Claus Kiefer: Der Quantenkosmos – von der zeitlosen Welt zum expandierenden Universum, S.Fischer-Verlag, Frankfurt am Main 2008.

[2] Erwin Schrödinger: Was ist Leben?, Piper, München 1987.

[3] James Gleick: The Information, HarperCollins, London 2011.

[4] Sean Carroll: From Eternity to Here – The quest for the ultimate theory of Time, Penguin Books, New York 2010.

Sehr schöner Artikel!

Bei solchen Gedanken komme ich immer wieder zu der (kosmologischen) Frage, ob nicht der Zustand der totalen Unordnung gleichzeitig die totale Ordnung bedeutet?

Ist es dann nicht wie bei der Tangensfunktion, dass die Entropie bis ins Unendliche wächst, direkt danach aber aus “minus unendlich”, also absoluter Ordnung, wieder auftaucht?

Dann wäre dieser Zustand der absoluten Entropie also eine Singularität.

Und wie genau sieht dieser Zustand (kurz zuvor und kurz danach) aus? Ist alles gleichmässig verteilt oder bilden sich irgendwelche Strukturen? Oder fällt dabei alles in einen einzigen Punkt wieder zusammen?

Danke für das Lob. Aber nein, wenn ich Sie richtig verstehe: Sobald Makrozustände definiert sind, ist die Entropie objektiv festgelegt. Ich denke, dass die Identifikation von Entropie mit „Ordnung“ (die ja sehr viel subjektiver verstanden kann) hier eher verwirrt.

Die Aussage “Und jede Form der Entstehung von Nahrung beruht in letzter Konsequenz auf der Photosynthese.” ist nicht richtig, seit dem wir wissen, dass es z.Bsp. an sog. “scharzen Rauchern” auch Biotope ganz ohne Photosythese existieren. Man kann auch diverse noch heute existierende Bakterienteppiche zählen. Und noch an Nahrung denken, die es gab, bevor unsere Atmosphäre viel Sauerstoff enthielt…

Danke für den Hinweis! Daran hatte ich tatsächlich nicht gedacht. Habe es korrigiert.

War ja gruselig wie zu Halloween, ist doch aber Weihnachten 😉

Hmm, was war zuerst (Gesetz der) Zeit oder (Gesetz der) Entropie oder umgekehrt.

Manche meinen, Gesetze selbst würden evolvieren, mit der Zeit oder wegen Entropie?

Ich mag die Entropie nicht, nur relativ oder als Differenz, aber absolut “Henne/Ei”.

Dann mal Guten Rutsch in die nächste Entropie

Es gab mal eine Zeit, da mochte ich die Entropie auch nicht. Inzwischen bin ich allerdings überzeugt, dass Vieles, das uns als fundamental erscheint letztlich von unserer Perspektive auf die Welt abhängt. Und dann kopmmt man an der Entropie nicht mehr vorbei…

Wie geht es zusammen, dass die Entropie erst den Zeitpfeil bestimmen soll, dieser Zeitpfeil aber implizit bereits in der zeitabhängigen Schrödingergleichung vorkommt und die Schrödingergleichung in sich geschlossene, nicht mit der Umgebung wechselwirkende Quantenzustände beschreibt?

Gefühlsmässig passt mir die Vorstellung, dass die Zeitrichtung allein durch die Zunahme der Entropie, durch zunehmende Unordnung entstehen soll, nicht besonders. Andererseits muss man natürlich zugeben, dass gerade chemische und biologische Vorgänge oft mit vom Gleichgewicht weit entfernten thermodynamischen Prozessen verbunden sind und dass bei diesen Prozessen die Entropie (genau wie die Zeit) unzweifelhaft zunimmt. Doch das könnte auch nur eine Korrelation, keine Verursachung sein. Mit andern Worten: nur weil Entropie und Zeit immer zusammen zunehmen heisst das noch lange nicht, dass die Entropie und der Zeitpfeil ursächlich miteinander verknüpft sind und die Entropiezunahme die Zeit in eine Richtung laufen lässt.

Vielleicht ist Entropie wie ein Klapperstorch, dann kommen die Babies 😉

noch nicht mal Korrelation, sondern nur seltsame immer passende Koinzidenz.

@Martin Holzherr: Richtig, bisher ist es eine offene Frage, ob Entropiezunahme die Ursache oder eine Konsequenz des Zeitpfeils ist. Erstere Vorstellung würde aber immerhin erklären, warum die Entropie in der Frühphase des Universums so klein war, da dann „Frühphase“ und „niedrige Entropie“ das gleiche bedeuten. Ihr Argument mit der Schrödinger-Gleichung hat den Haken, dass die Schrödinger-Gleichung (und ihre speziell-relativistischen Verallgemeinerungen) die Gravitation nicht berücksichtigt. Wenn man in der kanonischen Quantengravitation die Hamiltonsche Zwangsbedingung der Allgemeinen Relativitätstheorie quantisiert, kommt man dagegen auf die Wheeler-DeWitt-Gleichung, die tatsächlich wie eine Schrödingergleichung ohne Zeitentwicklung aussieht: H psi = 0. Interpretiert man psi als „Wellenfunktion des Universums“ beschreibt das dann eine zeitlose Welt. Das wird sehr schön bei Claus Kiefer oder H.D. Zeh erklärt.

Jedes Atom im Universum ist ein bewegtes Objekt und könnte somit auch als Maschine betrachtet werden – die eine Energie(X) in ihrem Betrieb abgibt (wenn sie energieärmer wird).

Nehmen wir theoretisch an, dass diese ´Energie(X)´ eine winzige abstoßende Wirkung hat; dann könnte dies eine Ursache dafür sein, wieso das Universum sich mit zunehmender Geschwindigkeit ausbreitet.

Wir hätten mit solch einer abstoßenden Wirkung eine ´gleichmäßig beschleunigte Bewegung´ – die, wenn sie langfristig erfolgt, zu einer immer höheren Geschwindigkeit führt.

Mit dieser Überlegung könnte man eine zunehmende Expansion des Universums erklären.

sorry: ´Mit dieser Überlegung könnte man eine zunehmende Expansionsgeschwindigkeit des Universums erklären.´

Das Landauer-Prinzip besagt, dass das Löschen eines Bits an Information zwangsläufig die Abgabe einer bestimmten Energiemenge in Form von Wärme an die Umgebung bedeutet.

https://de.wikipedia.org/wiki/Landauer-Prinzip

Wenn das Universum beliebig lange expandiert, beliebig groß wird, und praktisch im thermischen Gleichgewicht angekommen ist, dann sind die Boltzmann-Gehirne die wahrscheinlichste Existenzform.

https://futurezone.at/meinung/das-nackte-gehirn-im-all/161.732.600

Zu:

Karl Bednarik

31. Dezember 2017 @ 09:52

Wenn das Universum beliebig lange expandiert, beliebig groß wird, und praktisch im thermischen Gleichgewicht angekommen ist, dann sind die Boltzmann-Gehirne die wahrscheinlichste Existenzform.

(Ende des Zitats)

Der Ausdruck “beliebig lange” ist eine ungeheuer scharfe Angabe für einen konkreten Zeitpunkt bzw für die Angabe einer Zeitdauer. )-:

Karl Bednarik,

das Löschen eines bits…….

damit schaffen Sie die Verbindung von Idealismus mit Materialismus.

Das Löschen einer Information setzt Energie frei. (war das so gemeint?)

Damit bekommen Bücher eine messbare Größe.

Ja die Frage, was Information und was Materie ist, ist tatsächlich nicht vollständig geklärt. Vermutlich ist vieles, was wir als Materie ansehen in Wirklichkeit eher Information.

Information ist eine menschliche Interpretation der Welt. Es gibt viele menschliche Interpretationen der Welt, z.B. die theologische. Insofern kann man Information keinesfalls mit der Welt gleichsetzen. Information ist ein gedankliches Konzept des Menschen als informationserkennendes System. Wenn das informationserkennende System bestimmt, was Information ist, dann ist das offensichtlich eine Tautologie.

Andererseits besteht der Mensch aus derselben Materie wie die Welt und wechselwirkt mit der physikalischen Welt. Wahrnehmungen als Grundlage von Informationen sind verkettete Abbildungen von Mustern oder Strukturen der Außenwelt auf Strukturen unserer Innenwelt. Insofern gibt es einen Zusammenhang von Materie und Information. Diesen Zusammenhang versucht die Naturwissenschaft zu ergründen, indem wir Erkenntnis über die Welt zu gewinnen versuchen.

Es war I.Kant, der den Zusammenhang näher entschlüsselt hat, indem er zunächst die Bedingungen der reinen Vernunft ergründet hat. Da er die Evolutionstheorie als biologische Grundlage der Erkenntnisvermögen noch nicht kannte, musste es Stückwerk bleiben. Die Wissenschaftsphilosophie führt diese Aufgabe weiter. Aspekte davon sind die Wahrheitstheorien und die verschiedenen Varianten des Realismus/Antirealismus.

Ein “S” ist in unserer Sprachkultur ein Buchstabe des Alphabets, als Verkehrszeichen könnte es Schleudergefahr bedeuten und in einer anderen Kultur könnte es Symbol für Schlangen sein, z.B. vor einem vietnamesischen Restaurant. Information ist also nicht gleich Information. Man muss unterscheiden zwischen der Semiotik und der Semantik von Information. Muster, Strukturen, Ordnungen oder semiotische Zeichen können vom (gesunden!) Menschen objektiv erkannt werden, ihre Bedeutung ist in aller Regel aber subjektiv.

Biologisch gesehen wird Information “erzeugt”, indem Rezeptormoleküle mit Transmittermolekülen zwischen Nervenzellen verglichen werden. Dabei wird im Einzelfall eine binäre (irreversible) Entscheidung getroffen, passt oder passt nicht. Entsprechend sind dann die chemischen Reaktionen. Das ist selbstverständlich nur ein Glied in der Kette der informationsverarbeitenden Schritte des Bewusstseins.

Wir lernen die grundlegenden Informationen im Kindesalter. Zum Beispiel muss man erst die Sprache und die Bedeutung von Zahlen lernen, um überhaupt mit Informationen umgehen zu können. Das nenne ich Präformation, die implizit oder unbewusst immer enthalten ist.

In der Wissenschaft ist der Informationsbegriff also mit größter Vorsicht zu gebrauchen. Nicht umsonst erfreut er sich bei Esoterikern umso größerer Beliebtheit. Man denke nur an die Homöopathie oder Astrologie, aber eben auch an Spekulationen der Kosmologie.

@Anton Reutlinger:

Hier muss man aufpassen, zwischen Information und ihrer Darstellung zu unterscheiden. Auch die Zahl eins wird arabisch „1“ und römisch „I“ geschrieben, bedeutet aber in beiden Fällen das gleiche.

AR,

In der Informatik wird ja Information rein quantitativ betrachtet, mit der Maßeinheit 1 bit. Das ist die Möglichkeit aus 2 Zuständen eine wählen zu können.

Der Informationsbegriff der Umgangssprache meint eigentlich eine Kombination von Zeichen und Bedeutung.

Wenn ich eine Schrift einer untergegangenen Kultur habe, dann habe ich die Zeichen, kenne aber deren Bedeutung nicht.

Die Bedeutung kann ich nicht materialisieren, die existiert nur in unserem Kopf. Wenn der letzte Mensch gestorben ist, verlieren alle Zeichen ihren Sinn. Damit ist die Bedeutungslehre eindeutig nicht materiell, rein geistig.

Herr Päs,

die entgültige Trennung zwischen Information und Materie findet erst statt, wenn es keinen Menschen (Tiere) auch Pflanzen mehr gibt , die über Zeichen, Markierungen, Marker miteinander kommunizieren. Die Information ist an das “Leben” gekoppelt. Viren nehmen da eine Sonderstellung ein. Sie tragen Information, können sie selbst aber nicht verarbeiten. Gewagte These : Leben = Information.

Dann beinhaltet die Information des Lebens wie man die Entropie erniedrigt.

Guten Rutsch!

Das habe ich nicht wirklich verstanden. Auch Computer und andere Maschinen „kommunizieren“ über Information.

Gar nicht so gewagt. Dass Leben viel mit Informationsverarbeitung zu tun hat, ist sicher unbestritten. Eine wichtige Rolle spielt dabei auch die Möglichkeit der Reproduktion, siehe z.B. Künstliches Leben

Information und Hylemorphismus:

Die Information ist die räumliche oder zeitliche Anordnung von Materie oder Energie.

Die gleiche Anordnung kann von ganz unterschiedlicher Materie oder Energie eingenommen werden.

Ohne Materie oder Energie gibt es nichts zum Anordnen.

Falls das Universum pulsieren würde, dann würde der Endknall wieder die Ordnung für den nächsten Urknall herstellen.

http://members.chello.at/karl.bednarik/PULUNI.jpg

Natürlich gab es viele Versuche, aus einem einzigen Wärmereservoir geordnete mechanische Energie zu gewinnen.

In den Szilard-Maschinen mit einem Kolben, und mit nur einem einzigen Molekül, benötigt der Maxwellsche Dämon Informationen über die Position des Moleküls, um die Ventile richtig zu steuern.

Spektrum der Wissenschaft, Januar 1988, Seiten 48-55.

Wenn man auf die Ventile, die Information, und den Maxwellschen Dämon ganz verzichtet, und zwei Überströmkanäle wie in einem alten Zweitaktmotor einbaut, dann kommt man zu der folgenden Animation, aufgebaut aus einem Graphen-Molekül und einem Xenon-Atom.

Dieses Gerät ist aber nur als Animation lauffähig, weil es einen versteckten Fehler enthält.

http://members.chello.at/karl.bednarik/AEE-1A.gif

Hallo Herr Bednarik, bitte erklären Sie etwas besser, was Ihre Animationen verdeutlichden sollen, sonst muss ich die Kommentare löschen. Beste Grüße, Heinrich Päs

Ich finde die Kommentare von Karl Bednarik schon interessant. Auch wenn ich nicht sicher bin, ob ich alles verstehe. Wird hier sofort mit Löschen gedroht, nur weil jemand etwas postet, was jemand anderes eventuell nicht versteht?

Policy ist: Ich werde also in Zukunft alle Kommentare, deren Sinn oder Bezug zum Post sich mir nicht erschließt, kommentarlos löschen. Dazu gehören insbesondere Kommentare, bei denen ich den Eindruck habe, dass sie den Post nur zum Anlass nehmen, eine unabhängig verfolgte Agenda zu propagieren wie “die Relativitätstheorie/LIGO/CMB-Experimente ist/sind falsch” oder “Wissenschaftlern kann man nicht trauen”.

Ziel ist, dass die Kommentarspalte nicht missbraucht wird, hier sein eigenes Steckenpferd zu bewerben, sondern genutzt wird, die im Blog angesprochenen Themen zu diskutieren.

“Wird hier sofort mit Löschen gedroht, nur weil jemand etwas postet, was jemand anderes eventuell nicht versteht?” (Zitatende)

Ja, leider sieht es manchmal so aus. Gelegentlich schrillt schon beim geringsten Geruch nach (angeblicher) Esoterik der Feuermelder. Ist aber interessant, da dies auch manche Rückschlüsse über die “Denkrahmen” der jeweiligen Blogbetreiber zulässt. Das sist aber kein Argument, das Personen betrifft, sondern deren Einstellungen zur Sache bzw. deren Ideologie. Und da Gedankengebäude keine Personenrechte besitzen (können), dürfte man diese sogar unflätig beschimpfen. Sogar nach dem 01.01.2018.

AR,

“Wenn das informationserkennende System bestimmt, was Information ist, dann ist das offensichtlich eine Tautologie.”

Das wäre es nur, wenn wir statisch denken. Tatsächlich kommen ja mit jeder Information neue hinzu. Wenn Sherlock Holmes an der Tiefe der Schuhabdrücke erkennt, dass da ein schwergewichtiger Mann zugegen gewesen sein muss, dann taucht gleich die Frage auf, wie kommt ein Mann in das Frauenkloster?

” Man muss unterscheiden zwischen der Semiotik und der Semantik von Information. Muster, Strukturen, Ordnungen oder semiotische Zeichen können vom (gesunden!) Menschen objektiv erkannt werden, ihre Bedeutung ist in aller Regel aber subjektiv.

Diese geniale Einsicht lässt sich auf alles Materielle ausweiten. Alles , was es gibt, trägt Information in sich. Die zu erkennen ist ja die Aufgabe der Naturwissenschaften. Die deutung ist aber nicht subjektiv, sondern objektiv. Denken Sie nur an Spektrallinien des Lichtes. Wer hatte früher gedacht, dass sie uns sagen, wie die Atmosphäre des Planeten aufgebaut ist.

Noch weiter gedacht, wenn alles, was ist eine Information enthält, was gibt es dann, das keine Information enthält?

Karl Bednarik,

ohne Materie gibt es nichts anzuordnen,

Ihre Gedanken ordnen Sie aber?

Die Anordnung der Materie in der Außenwelt wird durch die Anordnung der Nervensignale im Gehirn mehr oder weniger genau abgebildet.

Das Koordinatensystem des Gehirns ist zwar ziemlich stark verzerrt, aber die Relationen zwischen den dargestellten Objekten bleiben mehr oder weniger genau erhalten.

Das verhindert in vielen Fällen, dass wir gegen eine Wand laufen.

Ohne Gehirn und Nervensignale können keine Informationen dargestellt werden.

KB,

Ohne die Nervenbahnen geht es nicht. Um jetzt mal das Wort Information zu gebrauchen, die Information läuft durch die Nervenbahn, die Deutung der Information ist aber rein geistiger Natur.

Wo verorten Sie die Phantasie, geniale Gedanken, die noch nie von jemand gedacht wurden, die Fähigkeiten eines Komponisten? Wie ist es möglich, etwas zu denken, das es materiell gesehen nicht gibt, z.B. alle religiösen Meinungen und Gefühle?

Die innere Abbildung der Außenwelt, also das Weltmodell, ermöglicht Experimente mit den darin dargestellten Objekten.

Deshalb weiss man schon vorher, dass man nicht durch eine Wand laufen kann.

Beim Erfinden kombiniert man die dargestellten Objekte neu, und stellt dann oft fest, dass der gleiche Vorgang in der Außenwelt leider nicht funktioniert.

Beim Träumen läuft das innere Weltmodell gewissermaßen im Leerlauf.

Gefühle und ähnliche Zustände kommen aus angeborenen, anerzogenen, und erlernten Informationen.

Zum Beispiel verhindert der angeborene Schmerz zumeist, dass wir uns selbst verletzen.

Natürlich kann man die Experimente auch in der Außenwelt durchführen:

https://www.youtube.com/watch?v=YMTGP9fM04A

@lore ipsum;

Wenn man aus einer Aussage A durch logische Deduktion eine Aussage B ableiten kann, dann ist das keine neue und zusätzliche Information, oder mit andern Worten, es ist keine Nachricht. Die Information von B ist dann bereits in der Aussage A enthalten.

Mit subjektiv meinte ich nicht individuelle Subjektivität, sondern bezogen auf Gruppen, Gesellschaften oder Kulturen, insbesondere Sprachgemeinschaften. Die christliche oder die westliche Kultur deutet manche Informationen anders als andere Kulturen.

Es gibt Dinge, die keine verwertbare(!) Information enthalten. Ein Haufen Sand beispielsweise. Natürlich kann auch die Größe des Sandhaufens oder die Art der Sandkörner noch eine Information sein. Am wenigsten Information findet sich selbstverständlich im leeren und finsteren Weltall.

Eine Anordnung kann unvollständig sein. Manchmal ist die Unvollständigkeit erkennbar, z.B. fehlende Messwerte in einer Messreihe, manchmal nicht. Unvollständige Ordnungen werden gerne als Rätselaufgaben gestellt, die dann vervollständigt werden sollen. Das kann bedeuten, dass objektiv Information fehlt, es kann auch bedeuten, dass Information nur nicht gegenwärtig ist. Bei fehlender Information könnten die Rätselaufgaben nicht gelöst werden.

Fehlende Information bezeichne ich als Disformation. Man kann sie mit Entropie gleichsetzen, wie Herr Päs es gemacht hat. Dabei muss man darauf achten, ob sie nicht doch irgendwo schon versteckt enthalten ist. Man denke hier an Maxwells Dämon. Beispielsweise enthält eine Feder, die eine Klappe oder ein Ventil steuert, die Information für die Durchlässigkeit der Klappe. Die Klappe entspricht dem Filter als kybernetisches Instrument.

AR,

sehr ausführlich und logisch. Ich wollte auf etwa anderes hinaus. Information nicht nur für Menschen , sondern Information als Eigenschaft der Materie. Wenn ein Proton eine positive Ladung trägt, dann ist das sowohl eine Eigenschaft, für die menschliche Wahrnehmung eine Information. Beides ist aber letzlich das gleiche, nämlich die Tatsache , das Proton ist positiv geladen.

Also zielt Eigenschaft und Information auf das Gleiche.

Daraus folgere ich, dass das Streben nach Erkenntnis als Suche nach Eigenschaften gedeutet werden kann, als auch die Suche nach Informationen. Klingt etwas sophistisch, ist für mich aber grundlegend.

Damit materialisiere ich die Information und binde sie an ein Objekt.

Wie verfahre ich jetzt mit Informationen, die an mehrere Objekte gebunden sind, z.B. der Anblick des Sternenhimmels und damit meine ich die Mustererkennung. Der eine sieht das , der andere sieht das. Keine der beiden Deutungen erheben den Anspruch auf Allgemeingültigkeit.

Jetzt mal wieder zurück zur Logik. Wenn also der Fußabdruck bereits impliziert, dass da eine Person gelaufen sein muss, dann impliziert der Anblick des Sternenhimmels, dass da etwas wirksam war, dass die Sterne dahin plaziert hat.

Der eine sagt, der Urknall ist daran schuld, der andere sagt, die Natur ist daran schuld, der dritte sagt, Gott hat das Weltall erschaffen usw.

Jede Deutung kann nur teilweise auf innere Widersprüche untersucht werden. Den letzten Grund für das vorhandensein der Sterne kann niemand beweisen. Und wer sich da auf die Position des Urknalls zurückzieht, der verschiebt nur den Torpfosten, weil der die Frage nach der Herkunft des Urknalls nicht beantworten will.

Und jetzt zurück zum Begriffspaar Eigenschaft und Information. Sind die beiden Begriffe noch brauchbar, wenn man nach dem letzten Grund fragt? Welcher begriff ist besser geeignet?

@lore ipsum;

Es ist unsere millionenfache Erfahrung, dass ein Fußabdruck von einer Person stammt. Er könnte aber auch gefälscht sein. Information bezieht sich auf Eigenschaften von Materie, ist aber nicht mit ihr identisch. Auf die gruppenbezogene Bedeutung von Information habe ich schon hingewiesen. Die Vermögen der Wahrnehmung sind uns von der Evolution gegeben, aber sie sind in jedem Menschen unterschiedlich, Beispiel Brillenträger. Man muss bei der Information also höllisch aufpassen und nicht zu viel hinein interpretieren. Die Philosophie beschäftigt sich spätestens seit der Aufklärung mit solchen Problemen.

Auch das Kausalprinzip bringt viele Probleme mit sich. Wenn man noch keinen schwarzen Schwan gesehen hat, bedeutet es nicht, dass es keine gibt. Die Eigenschaft der Notwendigkeit spielt hier eine große Rolle. Wenn B aus A folgt, bedeutet es nicht, dass immer A gilt, wenn B beobachtet wird, siehe der gefälschte Fußabdruck. Betrüger sind bekanntlich sehr einfallsreich! Man denke auch an die beeindruckenden Vorstellungen von Magiern.

Mein Thema ist nicht die Physik – ich verstehe nicht allzu viel davon, u.a. weil meine Schulzeit etwa ein halbes Jahrhundert zurückliegt -, lese aber mit, weil ich lernen will und es einige Überschneidungen mit meinem Thema gibt, dem menschlichen Gehirn (darauf wird in den Kommentaren bezug genommen) und dazu gehört die sogenannte menschliche Informationsverarbeitung. Ein Begriff mit dem ich Schwierigkeiten habe.

Herr Päs, Sie schreiben:

Norbert Bischof * beschrieb Information als etwas, das Ungewissheit verringert, etwas, von dem es mehr oder weniger geben kann, das sich quantifizieren lässt. Unter diesem Aspekt wäre Entropie dann so etwas wie ein Maß für Ungewissheit (?)

Nun erwähnen Sie Shannon und sein Problem des Datenverlustes bei der Datenübertragung. Shannon wird auch von Bischof im Zusammenhang mit dem Sender-Empfängermodell erwähnt, bei dem Information vom Signal übertragen wird, und die Bedeutung des Signals für den Empfänger relevant ist. Datenverlust (Entropie) würde dann meinen: Die Ungewissheit wird größer, weil mit den Daten auch Bedeutung verloren geht.

Wenn ich mir nun das Gehirn anschaue, dann stelle ich zunächst fest, dass es über seine sensorischen Systeme an die Außenwelt “gekoppelt” ist. Da unsere sensorischen Systeme nicht auf das gesamte Spektrum an Wellenlängen reagieren, sondern selektiv nur auf sehr spezifische, haben wir- wenn ich es so ausdrücken will – an dieser Stelle bereits einen Datenverlust zu verzeichnen.

Ich will jetzt nicht auf Einzelheiten eingehen, mir geht es um Folgendes: Da wir über verschiedene, selektiv reagierende sensorische Systeme verfügen, wird die Außenwelt zunächst einmal “zerlegt” – in Mikro’zustände'(? Theoretisch hätten wir es ja mit einem hohen Maß an Unordnung zu tun, was aber nicht der Fall ist, chaotisch ist das ganze nämlich nicht).

Intern wird das zuvor Zerlegte wieder zusammengesetzt (unter Zufuhr von Energie), zu Mikro-? oder Makro-? Zuständen (wir erleben die Welt bz.w die Dinge in ihr als einheitlich)?

Meine Frage: wie bekomme ich da nun die Entropie hinein?

Norbert Bischof ( 1995): Struktur und Bedeutung. Eine Einführung in die Systemtheorie. Bern, Göttingen: Verlag Hans Huber

@Trice:

Richtig: Die Ungewissheit über den konkreten Mikrozustand im Makrozustand.

Ja.

Nein, Mikrozustand bezieht sich auf einen Zustand, der vollständig bekannt ist. Mit Zerlegung hat das erstmal nichts zu tun.

Bei Begriffen wie „Chaos“ und „Unordnung“ muss man vorsichtig sein, darunter werden teilweise ganz unterschiedliche Konzepte verstanden.

Wie gesagt: Mikro- und Makrozustand bezieht sich nicht auf Teil- oder Gesamtsystem und der Mikrozustand ist (paradoxerweise) auch nicht immer kleiner als der Makrozustand. Der Mikrozustand wird hier verstanden als die fundamentale Beschreibung, in der alles bekannt ist, der Makrozustand ist eine Beschreibung mit statistischen Größen.

Damit kommen wir zur Abstraktion und zur Konkretisierung.

Bei der Abstraktion gibt es verlustfreie und nicht verlustfreie Methoden der Datenkompression.

Um viele Bildpunkte sparsam und verlustfrei zu speichern, sind zum Beispiel *.png-Dateien geeignet.

Wenn man Verluste in Kauf nimmt, dann sind zum Beispiel *.jpg-Dateien geeignet.

Bei der Konkretisierung wird dann die Abstraktion so gut wie möglich rückgängig gemacht.

Wenn man hingegen zum Beispiel *.bmp-Dateien verwendet, dann wird jeder einzelne Bildpunkt ohne Datenkompression unverändert gespeichert, was relativ viel Speicherplatz benötigt.

—–

Auch Lebewesen sind gezwungen aus einer großen Anzahl von Bildpunkten eine abstrakte Beschreibung ihrer Umgebung zu erzeugen.

Nach dem sich diese Lebewesen für eine bestimmte Verhaltensweise entschieden haben, müssen sie diese abstrakte Absicht in zahlreiche einzelne motorische Steuerbefehle umwandeln.

Diese Abstraktion und diese Konkretisierung findet in zahlreichen Zwischenschritten und auf zahlreichen hierarchischen Ebenen statt.

Im linken Teil der folgenden einfachen Zeichnung wird das durch die “Trichter” dargestellt.

http://members.chello.at/karl.bednarik/abstrak7.PNG

Hier ist ein schöner Dia-Vortrag zu den Szilard-Maschinen mit nur einem einzigen Molekül:

http://slideplayer.com/slide/5977024/

AR,

“Information bezieht sich auf Eigenschaften von Materie, ist aber nicht mit ihr identisch”

Das scheint mir der Knackpunkt zu werden. Wieviel verrät die Materie von sich, wenn wir sie untersuchen. Wieviel Information erhalten wir von ihr. Und da wir aus der gleichen Materie bestehen und nach den gleichen Gesetzmäßigkeiten denken, sollten Eigenschaft und Information über die Eigenschaften sich immer mehr annähern. Und tatsächlich geschieht das ja auch. Wir haben das geheimnis der Kernkraft gelüftet und sind imstande die welt zu zerstören.

Ist das nicht Beweis genug?

Und vorallem ist das kein beweis für die Richtigkeit unseres Denkens!

Wenn ein Gas-Molekül von einer Wand abprallt, dann ändert es seine Flugrichtung, weil es durch seinen Aufprall über das Vorhandensein der Wand informiert wurde.

Die Wand überträgt also einen Teil ihrer Gestalts-Information auf das Gas-Molekül, und das Gas-Molekül überträgt einen Teil seines Impulses auf die Wand.

Folgendes verstehe ich nicht so recht:

Dass die E. in der Stube abnimmt ist klar (i.S.v. es wird “ordentlich“ wärmer). Warum in der Winternacht? Dass die Gesamtentropie (sozusagen im Weltraum) zunimmt, ist ja (ebenfalls) klar = durch das Verbrennen der foss. Brennstoffe, d.h. ihre Vermischung mit der umgebenden (Außen-) Luft. Die E. der Winternacht nimmt aber doch nur in der _unmittelbaren_ (Außen-) Umgebungsluft der Stube ab, da die Wände Wärme abstrahlen. Sehe ich das so richtig?

„Winternacht“ war hier als Wämereservoir gemeint: Wenn der Temperaturunterschied zwischen zwei Reservoiren erhöht wird, wird lokal die Entropie verringert. Dass dabei niederentropische fossile Energieträger in hochentropische Wärme umgewandelt werden sorgt dafür, dass die Gesamtentropie im Universum zunimmt.

Axel Krüger,

Entropie kann aus dem Nichts heraus entstehen, wenn der Vorgang irreversibel ist, also bei der Verbrennung von Holz.

Dadurch, dass sich die Wärme verbreitet, kann die Entropie nur noch zunehmen.

Bei der Vermischung mit der Außenluft nimmt sie noch weiter zu.

Wenn du dich als Wanderer diesem Haus näherst, merkst du wie es immer wärmer wird, die Entropie nimmt in Richtung Haus ab.

“nimmt die Entropie in Stube und Winternacht zwar ab”, ich glaube, dass ist unglücklich formuliert, weil jetzt an die Gesamtentropie des gesamten Universums ??? gedacht wird, was ja in diesem Beispiel keinen Nutzen bringt.

Herr Päs, mich wundert,dass bei der aktuellen Diskussionslage noch nicht Panpsychimus als Begriff gefallen ist. Da Information physikalisch nicht definiert,eher beschrieben,ist,liegt Metaphysik nicht weit. Information im Begriff und angenommenen Wesen,s. Diskussion, böte sich als Grundlage für Panpsychimus an. Wollen Sie das bitte aus Ihrer Sicht einordnen?Ihr Blog-Kollege Lars Jaeger hat das im Blog vom 17.10.2017 auch bereits versucht.Danke!

@Mussi:

Im Lars Jaegers Blog-Post vom 17.10. konnte ich nichts zum Thema Panpsychismus finden. Bei Jaeger geht es um die Entstehung von Leben, Panpsychismus handelt dagegen von einer Omnipräsenz “geistiger” Eigenschaften. Aber ich kann gern ganz kurz meine Einschätzung geben: “Geistig” lässt sich m.E. aus naturwissenschaftlicher Perspektive nur im Sinne von “Bewusstsein” verstehen. Sicherlich ist nicht jede Form von Materie bewusst – auch unser Gehirn ist z.B. im Tiefschaf oder Koma unbewusst. Andererseits ist die gleiche Hirnmaterie zu bewussten und unbewussten Zuständen fähig. Das deutet darauf hin, dass Bewusstsein mehr mit Informationsverarbeitung und weniger mit der materiellen Basis an sich zu tun hat. Meiner Meinung nach ist es insofern gut möglich, dass jede Materieform prinzipiell bewusstseinsfähig ist, und die Frage ob ein Prozess bewusst oder unbewusst ist nur von der Art der Informationsverarbeitung abhängt. Guilio Tononis “Integrated Information Theory” (IIT) ist ein solches Modell, das ich (ohne in diesem Bereich Experte zu sein) für sehr interessant und vielversprechend halte. Auch Christof Koch ist z.B. ein Fan der IIT:

Is Consciousness universal ?.

Ok,Danke!

Warum drehen sich die smileys (-: beim Denken immer um 😉

Warum drehen sich die smileys (-: beim Denken immer um 😉

Mussi,

in der Informatik ist der Begriff Information definiert und es gibt sogar eine Maßeinheit dazu, das bit.

… bezogen auf die Darstellung im Binärsystem; das ist eine entscheidende Einschränkung. Man kann Information in jedem beliebigen Zeichensystem bzw. Code darstellen. Wohl nur die Älteren oder Experten kennen noch den Begriff “Baud”.

Die Darstellung sagt nichts über die Bedeutung und sie sagt nichts über den Nachrichtenwert oder Neuigkeitswert von Information aus. Die Maßeinheit bit ist unabhängig vom Empfänger der Information. Gerade darin liegt die Bedeutung der Shannonschen Informationstheorie.

Ein Byte bedeutet normalerweise eine Datenmenge von 8 Bit.

Ein Baud bedeutet normalerweise eine Geschwindigkeit von einem Byte pro Sekunde.

@ Lore ipsum

ein bit ist ein Energiezustand,aber nicht Information. Es sei denn,der Energiezustand wird als Information angesehen.Mit einen Energiezustand bit wird allerdings Information geschöpft. Dazu hätte die DPG aber auch eine Definition. Hat sie aber nicht. Habe ich 2016 angefragt.Siehe auch den angesprochenen Blog von Lars Jaeger.

Hallo Herr Päs,

“Und vielleicht steckt die Entropie sogar hinter der Zeit selbst: Was wir im täglichen Leben als Zeit erleben, ist eigentlich die Zunahme von Entropie. …. Viele Physiker glauben deshalb, dass Zeit selbst nur eine Beschreibung der Zunahme von Entropie ist. ”

Soll das heißen, der Zeitpfeil in seinen vielfachen physikalischen und empirischen Ausprägungen ist nicht fundamental ? Sondern fundamental sei die Entropie, und der Zeitpfeil nur ein anderes Wort für die universale “Entropiezunahme” (statt “Wort” sagen sie “Beschreibung”) ?

Soll etwa die Entropie sogar kausal für den Zeitpfeil verantwortlich ist ?

Offenbar ist auch Herr Senf unsicher.

Die gesamte Physik hat meines Wissens schon immer einen Konsens darüber gehabt, daß sich der Zeitpfeil (egal welcher, sie führen alle auf einen zurück) mit der statistischen Thermodynamik in keiner Weise erklären läßt – und erst Recht nicht mit dem Begriff der Entropie !

Ihre obige Aussage steht dazu im Widerspruch.

Welche Gründe haben Sie, die Sie gegen die Gründe der etablierten Physik in Anschlag bringen können ?

Im Übrigen:

Die Entropie ist eine eine beschreibende Zustandsgröße mit einer physikalischen Einheit (J/K) ! Information hat keine physikalische Einheit. Daher Kann Entropie auch nicht identisch mit Informationsdifferenz sein – das nur zur Klarstellung. Der Zusammenhang zwischen Entropie und Information ist als reine Differenz (Mangel) an Information jedenfalls nicht darstellbar, solange nicht klar gesagt wird, welche physikalische Definition von Information hierbei gemeint ist. Bitte nachholen.

Grüße Fossilium

Entropie verlangt Absolution, wenn da nicht was anderes wäre.

Relativität ist einfacher, aber die Emergenz “Henne oder Ei”.

Hallo Herr Senf,

ich möchte Sie als Kommentator gerne ernst nehmen.

Bitte haben Sie die Freundlichkeit, Ihre Einwände oder Zustimmung in allgemein verständlicher Form darzulegen.

Ihr o.a. Text erschließt sich mir in dieser Form leider nicht.

Grüße Fossilium

Tatsächlich habe ich diese Bemerkung auch nicht verstanden.

Ja. Man beachte allerdings das Wort “vielleicht”, da dieses Problem keineswegs geklärt ist. Aber das ist eine Möglichkeit, die von führenden Wissenschaftlern (Kiefer, Zeh, Barbour…) diskutiert wird. Siehe z.B.

hier

Nein, Entropie ist nicht fundamental, sondern vielmehr die Information, die uns fehlt, um den fundamentalen Zustand vollständig zu beschreiben.

Ich weiss nicht, was Sie hier mit “kausal” meinen. Die Vorstellung ist grob gesagt, dass Zeit keine Eigenschaft des Universums ist sondern unserer Perspektive auf das Universum. Diese Perspektive schreibt fest, welche Informationen uns zur Verfügung stehen und welche nicht (Entropie) und mögliche Zustände des Universums können dann nach Entropiemenge sortiert werden und entsprechend auf einer Achse angeordnet, die wir Zeit nennen. Wie gesagt, das ist eine mögliche Vorstellung, und die Details wie diese Vorstellung in einer Theorie der Quantengravitation erklärt werden kann, sind bisher nicht vollständig gelöst.

Das ist nicht richtig, siehe den Link oben. Vielleicht haben Sie recht, wenn Sie sich auf die phänomenologische Thermodynamik der Dampfmaschinen beschränken, aber dass diese ohne Informationsbefriff unvollständig ist, zeigt ja schon

Maxwells Dämon

Sie haben das Wort “normiert” übersehen:

Die Entropie S ist: S = k_B ln Z.

Hier ist Z die mikrokanonische Zustandssumme, also einfach alle Mikrozustände im Makrozustand abgezählt, und k_B die

Boltzmannkonstante. Die trägt die Ihnen fehlende Einheit.

Information ist ein Maß für die Menge der möglichen Mikrozustände in einem physikalischen System. Wenn Sie das im Binärsystem hinschreiben, kommen Sie auf Bits uns Bytes.

Beste Grüße, Heinrich Päs

Zu:

“….Ja. Man beachte allerdings das Wort “vielleicht”, da dieses Problem keineswegs geklärt ist. Aber das ist eine Möglichkeit, die von führenden Wissenschaftlern (Kiefer, Zeh, Barbour…) diskutiert wird. Siehe z.B…..”

Ob sich Herr Päs in anderen Blogs und in Gegenwart von anderen Diskutanten auch getraut hätte (nicht) darauf hinzuweisen, dass H. Dieter Zeh sein Buch von 2012 bei Springer Heidelberg/London/ New York so genannt hat:

Physik ohne Realität: Tiefsinn oder Wahnsinn?

Bei solchen Infragestellungen hätte hiesige Blogbetreiber gewisse nervende Diskutanten hier ziemlich bald verscheucht .

Hä???

Wer HIER sonst “Der Physik” hypothetisch den Tiefsinn abspricht und (selbst hypothetisch) den Wahnsinn unterstellt, ist bei den scilog- Blogs nicht gerade ein gern gesehener Gast und wird schnell mal als populistisch- esoterischer “crank” und potentieller Wissenschaftsfeind mit antisemitischer Motivation in die Ecke gestellt.

Erstens ist hier sicher mal ein „Quod licet Iovi, non licet bovi“ angebracht.

Und zweitens ist es keinesfalls Zehs Absicht, der Physik pauschal den Tiefsinn abzusprechen und den Wahnsinn zu unterstellen, sondern, den Widersinn einer epistemischen Interpretation von Naturgesetzen aufzuzeigen.

Mag sein. Da müsste ich nochmal nachlesen .Ist schon etwas her. Warum aber lässt er dann zu, dass sein “Wissenschaftsverlag” einen derart “reißerischen” Titel benutzt?

Hallo Herr Päs, hallo an alle.

Auf meiner Internetseite gibt es viele Perpetuum-Mobiles, weil man durch diese eine Menge über die Physik lernen kann.

Diese Perpetuum-Mobiles zeigen, wie leicht man sich selbst täuschen kann. (Das innere Weltmodell ist ziemlich ungenau.)

Am schwersten durchschaubar sind dabei die Perpetuum-Mobiles der zweiten Art. (Hier geht es ja schließlich um die Entropie.)

Hier sind die Überlegungen zu meiner Animation von weiter oben. (Keine Sorge, das kann nicht funktionieren.)

http://members.chello.at/karl.bednarik/AEE-1C.PNG

Natürlich sind alle herzlich eingeladen, herauszufinden, warum genau meine Perpetuum-Mobiles nicht funktionieren können. (Viel Spaß.)

Mit freundlichen Grüßen, Karl Bednarik.

Nachtrag:

Geschichten der Thermodynamik und obskure Anwendungen des zweiten Hauptsatzes:

http://www.wias-berlin.de/preprint/330/wias_preprints_330.pdf

—–

Das Brillouin-Paradoxon ist ein elektrisches Analogon zur molekularen Ratsche, welches zwar auch nicht funktioniert, aber dafür schwerer durchschaubar ist.

—–

Von meinen eigenen Perpetuum-Mobiles halte ich das Umkehr-Osmose Perpetuum Mobile (OSMOPERP.PNG) für ziemlich schwer durchschaubar.

(Chemotechnisch und mathematisch scheint alles richtig zu sein, aber das Universum wird es dennoch irgendwie verhindern.)

Selbstkritik:

Ich habe alle meine bisherigen Beiträge nochmals genau überprüft, und wirklich alle beziehen sich auf das Thema des Artikels “Entropie und Information”.

OK, aber bitte sagen Sie ein paar Worte dazu, wie sich die Themen auf den Inhalt des Blog-Posts oder die nachfolgende Diskussion beziehen, damit der Eindruck vermieden wird Sie würden hier vor Allem für Ihre Webseite werben wollen.

Hallo Herr Bednarik, danke für die Richtigstellung. Tatsächlich können solche Beispiele lehrreich und unterhaltsam sein. Der oberflächliche Betrachter hätte leicht auf die Idee kommen können Sie glaubten tatsächlich an die Möglichkeit eines Perpetuum Mobiles und wollten hier Ihre Modelle bewerben.

Beste Grüße, Heinrich Päs

@Karl Bednarik;

Wenn eine Feder eine Klappe oder ein Ventil betätigt, damit Teilchen von einer Seite auf die andere gelangen können, dann entspricht die Stärke der Feder der Information, die darüber entscheidet, ob die Klappe bzw. das Ventil geöffnet wird. Durch das Öffnen und Rückstellen der Klappe erwärmt sich die Feder, d.h. die Entropie der Feder wächst mit jeder Betätigung, während sich die Entropie des Systems erniedrigt.

Deshalb habe ich versucht, in der Szilard-Maschine (von weiter oben, AEE-1A.gif und AEE-1C.PNG) mit nur einem Kolben, und mit nur einem einzigen Molekül, ganz ohne Federn, Klappen und Ventile auszukommen.

Das wäre zwar durch zwei Überströmkanäle möglich, und das würde dann dennoch nicht funktionieren.

(Wenn man die Dateinamen hinter meine Internetadresse kopiert, dann vermeidet man direkte Links im Text, die oftmals gelöscht werden.)

Mussi,

die Darstellung der Information als low oder high, bzw. 0,7 V und 4,5V ist ein Energiezustand, die Information dazu wird als Möglichkeit definiert, aus 2 Wahrscheinlichkeiten eine zu wählen, also 0 oder 1, das ist die Informationseinheit 1 bit. Die Bedeutung des bit, was die 0 bedeuten soll, die hängt von der Computersprache ab. Information und Deutung der Information sind also sinnvollerweise zu trennen.

Wenn man das klassische alte symmetrische Flip-Flop verwendet, dann ist der Energiezustand für 0 und 1 gleich groß, der Unterschied zwischen 0 und 1 ist dann nur, ob der Strom links oder rechts hindurch geht.

Als Ausgabe kann man dann eine kontradiktive Datenleitung verwenden, deren beide Drähte abwechselnd Spannung führen.

Bei magnetischen Speichern ist es zumeist nur die Richtung der Magnetisierung, und nicht deren Energieinhalt, der 0 und 1 unterscheidet.

@ Herr Päs: Mikrozustand /Panpsychismus

vielen Dank für Ihre Antwort, dann das:

und dass es sich beim Mikrozustand um eine Beschreibung handelt, bei der alles bekannt ist, hatte ich wissen wollen.

Wie gesagt, beschäftige ich mich mit dem menschlichen Gehirn, aber nicht in der Weise, wie es derzeit in den Neurowissenschaften, der Psychologie usw. der Fall ist, sondern mit dem, was die Hirnforscher 20004 in ihrem berühmt-berüchtigten Manifest beschrieben: “Nach welchen Regeln (Hervorhebung von mir) das Gehirn arbeitet, wie es die Welt so abbildet (…), all das verstehen wir nach wie vor nicht einmal in Ansätzen.”

Ich beschreibe also das Gehirn, seinen Aufbau und seine Arbeitsweise, mit diesen Regeln bzw. einem Regelwerk; der Begriff Information kommt in meinem Modell nicht vor. Dieses Regelwerk muss allerdings auch für die ‘Welt’ gelten, denn sonst hätten wir keine Gewähr, dass unsere Gehirne diese – im Rahmen dessen, auf das die sensoriechen Systeme reagieren – diese Welt auch einigermaßen korrekt abbilden. Eben deshalb muss ich aber wissen, wenn Entropie das ‘Gegenstück’ zur Information ist, was es damit auf sich hat, damit sich nicht am Ende herausstellt, dass mein Modell ein gewaltiges Loch hat.

Zum Panpsychismus: bei solchen Vorstellungen bekomme ich einen dicken Hals. Im Nachbarblog von Joe Dramiga die Sankore-Schriften gab es im März letzten Jahres eine lebhafte Diskussion zum Beitrag: “Ist das menschliche Gehirn ein Quantencomputer ?” Es ging dabei um die Theorie von Hameroff und Penrose, die man hier nachlesen kann.

Zur biologischen Basis des Bewusstseins wird u.a. von Alfredo Pereira et al. geforscht:

“Astrocytes and human cognition: modeling information integration and modulation of neuronal activity. Progress in neurobiology, 92(3), 405- 420. ” Das empfinde ich als seriöser als die Annahme eines Panpsychismus, der mich an Aristoteles’ unbewegten Beweger’ erinnert, den A. sich als beseelt und als reine Wirklichkeit vorstellte.

Das müssen Sie mal genauer erläutern. Es ist ja durchaus möglich, dass es vor allem die Informationsverarbeitung ist, die Bewusstsein ausmacht, und wenn dem so ist, dann ist jede Art von Materie prinzipiell bewusstseinsfähig, und das könnte man als eine Spielart des Panpsychismus ansehen (Christof Koch tut das).

Auch Pereira et al scheinen sich ja auf integrierte Information (und damit auf Tononi/IIT?) zu beziehen.

Hab aber schon mal gelesen, dass Koch von vielen als metaphysischer Esoteriker eingestuft wird.

Aber es wird neuerdings gewaltig spekuliert, ob Quanten(tunnel) phänomene über die Beeinflussung molekularer Katalysatorfunktionen bei der neuronalen Informationsverarbeitung wirksam sein könnten. Da man sich sonst gewisse Mechanismen bei der Orientierung von Vögeln nicht erklären kann.

Das käme dann Penrose/Hammerhoff wieder ziemlich nahe, obwohl Al- Khahlili und Mc Fadden ( “Life on the Edge” / “Der Quantenbeat des Lebens”, 2014 ) diesen Zusammenhang nicht herstellen wollen.

Da das Gehirn ein ziemlich feuchter, warmer Ort ist werden Quantensuperpositionen typischerweise sehr schnell durch Dekohärenz zerstört. Max Tegmark hat das 1999 mal ausgerechnet:

Siehe hier

Wenn man in dieser Richtung spekulieren möchte, muss man sich also gut überlegen, wie man solche Prozesse verhindert.

Da das Gehirn ein ziemlich feuchter, warmer Ort ist werden Quantensuperpositionen typischerweise sehr schnell durch Dekohärenz zerstört

(Zitatende)

Sie mögen recht haben. Zumindest für den Einstein- Mafioso- Blog. Denn dort wurden meine Superpositionen durch ziemlich flinke Dekohärenzen vorhin umgehend zerstört. Die Ursache könnten flinke feuchte Finger gewesen sein.

Wenns nochmal vorkommt spiel ich nicht mehr mit. Es gibt nämlich noch Wichtigeres im Leben. Zumindest auf der makroskopischen Ebene. Aber vielleicht auch im Zwischenbereich. (-:

KB,

richtig, nur eine Änderung benötigt Energie, weshalb Computer ja warm werden.

Trice,

Entschuldigung, dass ich mich hier einmische, Entropie und Information sind kein Gegensatzpaar. Ich denke, das ist mehr bildhaft gemeint, dass mit der Auflösung von Strukturen auch Information gelöscht wird.

Ich denke auch, dass die Speicherung von Gedanken ganz ähnlich strukturiert ist, wie bei einer Objektsprache.

Wenn das Objekt benannt wird, fallen einem auch die Eigenschaften/Umstände dazu ein.

Wenn es tatsächlich gelingen sollte, aus den Gehirnwellen das Denken abzulesen, das wäre eine Katastrophe. Dann wäre es vorbei mit der Gedankenfreiheit, dann wären wir nur noch Ameisen.

Zu:

“..Dann wäre es vorbei mit der Gedankenfreiheit, dann wären wir nur noch Ameisen…”

Blödsinn. (Sorry) . In menschlichen Gesellschaften lässt sich alles durch entsprechende Normen regeln. Falls der mehrheitliche Wille dazu da ist. Auch neue Techniken. Fast alles war irgendwann mal neu.

Über Ihre Gedankenfreiheit sollten Sie sich lieber jedesmal dann Gedanken machen, wenn sie den Mund zukneifen, weil es Ihrem Chef eventuell (!) nicht gefallen könnte.

Denn vor allem anderen mitgeteilte oder in der Realisierung begriffene Gedanken werden gerne unterdrückt. Oft gerade auch von einem selbst.

H.Päs, #2.1.

auch Computer können miteinander kommunizieren,

da haben Sie vollkommen Recht, mit dem Begriff Information muss man genauer umgehen.

>Ein kaputtes Auto kann dagegen auf viele Weisen kaputt sein.

Mehr Mikrozustände: http://www.spektrum.de/raetsel/affe-und-bibel/1336820

Es muss ja nicht immer die Bibel sein. Aber wie man leicht sieht kann es dauern, bis einmal ein vernünftiger Kommentar zustande kommt.

Das ist ein beliebtes Beispiel der Evolutionsleugner. Es beweist aber nur die Bildungsferne der Bibelgläubigen. Wie lernen eigentlich Kleinkinder die Sprache, wenn sie die Sprache noch gar nicht kennen?

Aber Herr Reutlinger, ich möchte Sie doch bitten, das Problem (hier) nicht billig klein zu reden. Es ist nämlich zuerst mal irrelevant, von wem es auch noch oder vielleicht schon zuvor aufgegriffen wurde. Sie könnten sich eventuell die Zähne daran ausbeißen. Denn daran ist schon sehr lange herumgekaut worden und neueste Forschungen und Experimente machen die Sachlage nicht gerade in Ihrem Sinne durchsichtiger.

Denn je weiter etwas in der Vergangenheit zurückliegt, und je weniger echte Falsifikations- oder auch nur Verivikationsmöglichkeiten möglich sind, desto mehr kann man relativ unbelegt behaupten. Ich war aus anderen Gründen ein Fan vom Autor des “Blinden Uhrmacher”, aber auch er musste schon etwas zurückrudern.

(Ich kenne die Komplexität der Sachlage, muss mich hier aber kurt fassen).

Hallo Herr Päs,

Sie schreiben als Form des 2. Hauptsatzes:

„Die Entropie der Welt strebt einem Maximum zu.”

Ich kenne den “2. Hauptsatz der Thermodynamik” in einer anderen Form, die da lautet:

„Sich selbst überlassene Systeme streben einem themodynamischen Gleichgewicht zu“,

Sie sagen un, die Entropie sei eine Größe, die Aufschluss darüber gibt, wie wahrscheinlich ein Makrozustand ist. Und in physikalischen Prozessen soll die Entropie dann deshalb zunehmen, weil sich der unwahrscheinlichere Makrozustand zum wahrscheinlicheren hin entwickelt.

Wenn das nicht mal zirkulär gedacht ist.

Was Entropie ist, läßt sich doch in einfachen Worten erklären: die Entropie ist ein Maß dafür, wie weit der Gleichgewichtszustand erreicht ist ! Das thermodynamische Gleichgewicht ist durch ein Minimum an (innerer) Energie und durch Stillstand aller makroskopischen Prozesse gekennzeichnet.

Die Annäherung an den Gleichgewichtszustand läßt sich statistisch beschreiben, indem man in jedem Moment die Anzahl der möglichen Mikrozustände betrachtet, die den aktuellen, zum Gleichgewicht strebenden Makrozustand bestimmen (jeder Makrozustand wird durch eine Teile bestimmt). Wenn der Makrozustand (z.B. gekennzeichnet durch eine Wärmeströmung) sich auf dem Weg zum Gleichgewicht befindet (Temperaturausgleich), dann wird die Zahl der die Temperaturverteilung bestimmenden Mikrozustände immer größer, und diese ist am größten, wenn der Gleichgewichtszustand = Temperaturausgleich erreicht ist. Die Entropie ist dann der Logarithmus dieser Zahl der Mikrozustände multipliziert mit der Bolzmannkonstante (ok, das ist die Normierung, die Sie meinen).

Alle Systeme, die von den Naturgesetzen bestimmt werden, chemische, biologische, beliebig komplexe, streben – wenn man sie sich selbst überläßt, also nicht von außen einwirkt – einem Gleichgewicht zu, eben einem Zustand, bei dem sich nichts mehr verändert. Man kann das als Entropie definierte Maß der Annäherung an den Gleichgewichtszustand daher universell anwenden, bei allen Prozessen, die durch die Naturgesetze bestimmt werden. Die Mächtigkeit der Entropie, die sie überschwänglich beschreiben, ist nichts anderes als eine Folge der viel mächtigeren Tatsache, daß man bei a l l e n sich selbst überlassenen Systemen eben dieses Streben zum Gleichgewicht vorfindet. Wenn wir also die Grenzen dicht machen und sich dadurch in unserem Land das Einkommensungleichgewicht zwischen Reich und Arm von selbst ausgleicht, kann man aus den der Vielzahl der Einzeleinkommen und der Bolzmannkonstante eine Entropie bilden, deren Zahlenwert ein gewissermaßen statistisch ermitteltes Maß für diesen Ausgleich ist.

Wenn Sie die Entropie nun als „Treibstoff“ beschreiben, und die Entropie so klassifizieren: „Auf diese Weise bestimmt die Entropie, was passiert, also welche Prozesse überhaupt ablaufen, und in welcher Richtung sie verlaufen“ – dann meinen Sie wohl, die Entropie sei der Antrieb für dieses Streben zum Gleichgewicht, also die Ursache dafür, daß dieser irreversible Prozess in Gang kommt. Dieses Streben zum Gleichgewicht ist aber doch nicht verursacht durch das Maß der Annäherung an dasselbe.

Dafür sind vielmehr die Naturgesetze und ihre Randbedingungen verantwortlich. Die Naturgesetze lassen eben nicht jeden Prozeß zu, sondern nur die, die im Einzelfall nach den jeweils vorliegenden Randbedingungen möglich sind. Es gibt da keinen Antrieb, der dafür sorgt, daß etwas passiert. Was passiert, passiert durch den Ausschluß aller anderen Möglichkeiten, den Auschluß besorgen die Naturgesetze. Auch der erste Anstoß für alle Prozesse nach dem Urknall wurde so in Gang gesetzt, daher rührt der Zeitpfeil – darauf will ich aber jetzt nicht auch noch näher eingehen.

Der Zeitpfeil ist jedenfalls nicht durch die Entropie verursacht. Die Entropie nimmt deshalb (im universalen Maßstab) zu, weil man zu jedem System, das sich vom Gleichgewichtszustand entfernt (Entropieabnahme) ein größeres findet, daß dieses System enthält und selbst als Ganzes wieder dem Gleichgewicht zustrebt (mehr Entropiezunahme) – also letztlich wegen der Ausdifferenzierung aller Mikrozustände.

Im Übrigen läßt sich mit der Annäherung an das Gleichgewicht auch die Information gut erklären. Ein beliebiges Ungleichgewicht hat mehr Strukturen als das Gleichgewicht. Mehr Strukturen heißt mehr Information. Mit Annäherung an das Gleichgewicht verschwinden die Strukturen, es entsteht – im metaphysischen Sinne – etwas Konturloses, Gleichmäßiges, Diffuses, das weniger Informationen enthält.

Daher nimmt die Information über ein System bei der Annäherung an ein Gleichgewicht im Gegensatz zur Entropie ab und zwar auf analoge Weise, wie diese zunimmt. Zunahme der Entropie und Abnahme an Entropie sind parallel laufende Vorgänge. Aber die Information ist genauso wenig Treibstroff für die zugrundeliegenden physikalischen Prozesse wie die Entropie.

Ich halte den Titel daher für verfehlt. Sie wecken damit falsche Vorstellungen.

Und aus dem parallel laufenden Zu- und Abnahmen von Entropie und Information

schließen Sie:

„Damit wird Entropie zu einem informationstheoretischen Konzept: Entropie ist die Information, die fehlt, um einen konkreten Mikrozustand im Makrozustand zu identifizieren.“

Was da heißen soll, kann man nur dunkel erahnen.

Grüße Fossilium

Der 2. Hauptsatz gilt nur für abgeschlossene Systeme, ohne Wechselwirkungen mit der Umwelt. Das Universum expandiert aber, vielleicht unbegrenzt, erhöht somit das Volumen und erniedrigt die mittlere Energiedichte. Die Hintergrundstrahlung hat heute nur noch 2,7K. Daher nimmt die Entropie immer weiter zu. Ob es jemals eine Umkehrung geben wird, ist rein spekulativ.

@ fossilium

Eventuell haben Sie tatsächlich ein Luftschlösschen zerstört. Und ich dachte, nur Informatiker seien Geisteswissenschaftlern ähnlich im (luftigen) Denken.

@Fossilium: Schauen Sie mal

hier

oder hier.

was zu den Fragen verleitet:hat Information einen Impuls?Oder ist deshalb Entropie bedeutend?Wie hängt das mit Emergenz zusammen?

@Mussi: Information hat nur dann einen Impuls, wenn Ihnen jemand eine Festplatte an den Kopf wirft 😉

@Fossilium:

Ist es nicht.

@Fossilium:

Naturgesetze geben an, welche Prozesse möglich sind, aber nicht in welche Richtung sie ablaufen. Das folgt aus der Entropiebilanz.

Wie gesagt zeichnen sich fossile Ressourcen wie Treibstoffe durch niedrige Entropie aus. Niedrige Entropie ist der Grund dafür, dass Treibstoffe Prozesse antreiben können. Und die niedrige Entropie zu Beginn des Universums ist der Grund dafür, dass sich überhaupt Prozesse im Universum abspielen.

Nehmen Sie das Beispiel der 2 Würfel: Jemand würfelt eine 7. Entropie ist die Information, die Ihnen fehlt, um sagen zu können, ob die Würfel auf 16, 25, 34, 43, 52 oder 61 lagen. Wenn Sie sich die Mühe machen, die Zahl der nötigen Fragen mit ja/nein-Antwort auszurechnen, die Sie brauchen, um diese Information zu erhalten, können Sie das auch in Bits angeben.

@Mussi;

Information hat keinen Impuls, denn sie ist ein rein menschliches Konstrukt. Mit der Natur hat Information insofern zu tun, als der Mensch in der aus Elementen zusammengesetzten Natur gewisse wiederkehrende Muster erkennen kann. Einmalig erscheinende Muster würden keine Information bieten. Das wäre wie ein unbekannter Buchstabe, der einmal und nie wieder in Erscheinung träte.

Solche Muster oder Strukturen in der Natur kann man als Emergenz verstehen. Aber auch hier ist wieder vor unbegründeter Spekulation zu warnen, denn somit wäre alles in der Welt Emergenz und folglich würde der Begriff dann seine Bedeutung verlieren. Die Emergenz wird ohnehin gerne schon von Esoterikern benutzt, um die Mühen der Wissenschaft zu umgehen, wie z.B. die Erscheinung des Lebens oder des Bewusstseins.

Für die Darstellung, Speicherung und Übertragung von Information ist Energie notwendig. Diese Funktionen basieren auf Materie oder elektromagnetischer Strahlung als Zeichenträger. Dagegen braucht die logische Verarbeitung von Information keine zusätzliche Energie! Allerdings ist die logische Verarbeitung nicht ohne Darstellung, Speicherung und Übertragung möglich.

Keine Bange,ich favorisiere das naturalistische Welt- und Menschenbild.

Aber es geht wohl eher darum,welche Rolle die Information in den Naturwissenschaften einnimmt. So verstehe ich die Intention des Artikels. Auch wenn es manchmal in den Diskussionen um Meinung und Anschauung geht,mag ich die Offenheit in alle Richtungen,um etwas,was bisher bestenfalls umschrieben ist, der Ansicht frei zu geben. Manche geben Wissen wieder,manche Vermutungen. Wenn ich es aber nicht falsch verstehe,sind Befürchtungen eben auch manchmal hinderlich.

Information ist noch ein Geheimnis,offensichtlich. Ich verstehe die Bedenken und Hinweise zur Esoterik. Sie sind u.a. auch der Pfad zu Ideologien und Theologien, damit verbundene Schwierigkeiten zu gesellschaftlichen Begründungen und Machteinflüssen.

Information in einem naturwissenschaftlichen Sinne darf und muss aber offen angesprochen werden können. Sie ist eben nicht nur ein “geistiges” Produkt. Zumindest in den angesprochenen Dimensionen. Ist Zeit eine Information? Ist Raum eine Information? Auch? Es ist nicht definiert. Schön das es besprochen wird.

@Anton Reutlinger:

Das kann man so nicht sagen.

„Information is physical“ hatte ja bereits Rolf Landauer herausgefunden.

Ein Elektronenspin hat im Magnetfeld zwei mögliche Ausrichtungen, „up“ oder down“, das ist gerade ein Q-Bit, egal, was sich die Menschen denken.

Mussi,

Raum und Zeit sind die Vorbedingung für die Information, ihr Ausmaß kann selbst zur Information werden.

Stellen Sie sich vor, Sie haben ein Date und die erwartete Frau kommt 2 Stunden zu spät, ohne Erklärung.

Information , quantitativ behandelt ist nicht geistig, sondern eine physikalische Größe.

Information, qualitativ hehandelt ist ein Grenzbereich zwischen Vereinbarung und Deutung.

Kryptologen finden sogar versteckte Informationen in Grabinschriften.

Ist der Sternenhimmel selbst eine Information? Aber ja. Er lässt uns staunen und verlangt nach einer Antwort .

Ist das Vorhandensein der Natur eine Information? Aber ja, sie lässt uns staunen und verlangt nach einer Antwort .

Ist die Existenz von Dir selbst eine Information? Aber ja, sie lässt uns staunen und verlangt nach einer Antwort .

Die Materialisten beantworten alle diese Fragen ganz lapidar mit Natur und Evolution.

Religiöse Menschen finden als Antwort: Gott hat diese wunderbare Welt erschaffen.

Ich vermeide direkte Links im Text, weil diese hier oftmals gelöscht werden.

Natürlich ist dieses Kopieren und Einfügen viel mühsamer als das einfache Draufklicken.

Entropie und Information:

In der englischen Wikipedia: Reversible computing

In Google suchen (alles zusammen): Zyvex Merkle Two Types of Mechanical Reversible Logic

Kausalität und Zeit:

In einer Planck-Zeit können die Elementarteilchen höchstens eine Planck-Länge weit kommen.

Dadurch entstehen die zusammenhängenden Weltlinien der Elementarteilchen.

Alle anderen Anordnungen der verschiedenen zeitlichen Zustände des Universums würden zumindest die Lichtgeschwindigkeit verletzen.

Natürlich erzwingen die zusammenhängenden Weltlinien alleine noch keine bestimmte Richtung der Zeit.

In der deutschen Wikipedia: Weltlinie

Bild auf meiner Internetseite, die man hier oben mit meinem Namen erreichen kann: RAUMZEIT.jpg

Gestalt und Information:

In Google suchen (alles zusammen): Youtube Bednarik Marble Computer

Bild auf meiner Internetseite, die man hier oben mit meinem Namen erreichen kann: INFORMAT.PNG

Zu meinem letzten Bild (INFORMAT.PNG):

Eine Kugel in einer W-förmigen Vertiefung kann zwei verschiedene räumliche Orte auf dem gleichen Energieniveau einnehmen.

Solange ihre thermische oder kinetische Energie niedrig genug ist, kann sie nicht ihren Platz wechseln.

Beim ausreichenden Erwärmen und dem darauf folgenden Abkühlen, ist dann ein solcher Speicher in einem zufälligen Zustand.

Vermutlich ist für diese Art der Löschung immer die gleiche Energiemenge notwendig, ganz gleich ob er 00000000, 11111111, oder 00001111 enthält.

Vermutlich ist diese Art der Information in Bezug auf ihre Ordnung und Entropie energie-neutral.

Das folgende ist nur eine dazu passende Wiederholung:

Die Information ist die räumliche oder zeitliche Anordnung von Materie oder Energie.

Die gleiche Anordnung kann von ganz unterschiedlicher Materie oder Energie eingenommen werden.

Ganz ohne Materie oder Energie gibt es nichts zum Anordnen.

Die Information ist vom Vorhandensein eines Trägers abhängig.

Die Information ist von der Art ihres Trägers unabhängig.

Energie und Information:

Die W-förmigen Vertiefungen können in einer Kugelbahn sein, oder genau so gut in jeder anderen Potential-Fläche.

Um eine Kugel über die Mitte einer W-förmigen Vertiefung hinweg zu heben, ist eine bestimmte Energiemenge notwendig.

Die Höhe der Mitte der W-förmigen Vertiefung muss immer wesentlich höher sein, als die mittlere thermische Energie bei der herrschenden Temperatur.

Daraus folgt, dass auch bei einer sehr hohen Energie-Schwelle, die Orts-Information nicht beliebig lange stabil bleiben kann, weil sehr selten auch hohe thermische Energien vorkommen.

Nachdem man die Kugel über die Mitte der W-förmigen Vertiefung hinweg gehoben hat, muss man sie natürlich wieder bremsen, damit sie nicht weiter hin-und-her springt.

Wenn man diese Brems-Energie in Wärme umwandelt, dann wird die Entropie des Systems erhöht.

Beim reversiblen Computing versucht man diese Energie in geordneter Form zurück zu gewinnen.

Was ist der (materielle ) Informationsträger bei der “Übermittlung” der Art des “Spins” bei der “Quantenteleportation”? Oder als Metapher:

Aufgrund welchen Informationsträgers weiß Alice instantan am anderen Ende des Universums, dass Bob eine linke Socke anhat, wenn sie sich eine rechte anzieht?

Je nach Interpretation der Quantenmechanik lautet die Antwort: „Es wird keine Information übertragen“ (Kopenhagen) oder „die Übertragung passiert nicht instantan, der Informationsträger ist die quantenmechanische Wellenfunktion“ (Viele Welten).

Man sollte sich halt mal entscheiden können. (Beim fixen Löschen auf anderen Blogs geht das doch auch recht einfach 😉 Aber so springen wir , wenn auf der einen Seite die nächste Paradoxie auftaucht, halt schnell auf die andere. Und wenn die Aufregung sich wieder gelegt hat, halt problemlos ebenso schnell wieder zurück.

@Schaber: Quatsch! Beide Ansichten sind logisch konsistent, da tauchen keine Paradoxien auf.

> Und zweitens ist es keinesfalls Zehs Absicht, der Physik pauschal den Tiefsinn abzusprechen und den Wahnsinn zu unterstellen, sondern, den Widersinn einer epistemischen Interpretation von Naturgesetzen aufzuzeigen.

Wenn ich Zeh richtig verstanden habe ist die Wellenfunktion das einzig Wahre denn z.B. Atome oder Elementarteilchen gibt es gar nicht. Merkwürdig nur dass sie vor der gar nicht existierenden Realität kuscht und nicht augenfälliger in Erscheinung tritt.

Physik ohne Realität: Tiefsinn oder Wahnsinn?

@Karl Mistelberger: Ja, aber das gilt auch für das Konzept, das üblicherweise mit Metrik g_(mu nu) oder eta_(mu nu) parametrisiert wird, das kuscht auch vor observablen Raum- und Zeitabständen. (Ich rede hier im Code, da die Nennung des Buzzwords gleich wieder zu einem Entrüstungssturm der üblichen Verdächtigen führt, nicht dass Sie zur Beruhigung heute abend noch am Feynman schnuppern müssen 😉 )

Ist meiner Ansicht nach ein Trend der modernen Physik, dass beobachterunabhängige Konzepte nicht mehr unmittelbar observabel sind.

KB,

Für Sie ist der Zusammenhang von Wärmeenergie , Information und Entropie sonnenklar.

Für mich, der ihr Modell noch nicht verinnerlicht hat, bleiben Fragen offen.

Da sich Wärmeenergie nur noch zum Teil wieder in kinetische Energie umwandeln lässt, geht also bei der Entstehung von Wärme Information verloren. Richtig/falsch? Die Entropie nimmt also zu. Richtig/falsch?

wenn ich einem geschlossenen System Wärmeenergie zuführe, erniedrigt sich die Entropie Richtig/falsch?

Sie sehen schon , ich bin noch am Anfang.

Beim reversiblen Computing versucht man die Entstehung von Wärme von vornherein möglichst vollständig zu vermeiden, weil man von der Wärmeenergie niemals vollständig zu einer Energie in geordneter Form zurück kommt.

Man könnte sich ein rotierendes Schwungrad denken, dessen Rotationsenergie zum heben der Kugel verwendet wird, und das dann beim Absenken der Kugel nahezu die gleiche Energiemenge wieder zurück bekommt.

Natürlich kann man so etwas ähnliches auch mit Molekülen und Energiepotentialen, aber dafür viel unanschaulicher machen.

Einige gute Überlegungen dazu sind hier:

In Google suchen (alles zusammen): Zyvex Merkle Two Types of Mechanical Reversible Logic

Ein Buckling-Element nach Merkle, ohne Kontaktflächen, ohne Gelenke, nur mit elastischen Blattfedern, die die mechanische Energie zurück geben.

Hier ist eine leider sehr kleine Animation auf meiner Internetseite, die man hier oben mit meinem Namen erreichen kann: BUCKELEO.gif

Diese kleine Animation sollte man stark vergrößern, dann sieht man auch die winzige Legende:

S0 = auf 0 setzen,

W0 = der Wert 0 ist gespeichert,

F0 = die Abfrage ergibt 0,

S1 = auf 1 setzen,

W1 = der Wert 1 ist gespeichert,

F1 = die Abfrage ergibt 1.

Irgendwann baue ich ein schönes Modell aus einer Folie.

Die Blattfedern sieht man in dieser Animation nur von der Kante.

@Herr Päs: Panpsychismus