Globale Temperatur 2010

BLOG: KlimaLounge

Das meteorologische Jahr 2010 ist vorbei, und die meisten globalen Datensätze dafür sind jetzt publiziert. 2010 war bei den bodennahen Lufttemperaturen das wärmste Jahr seit Beginn der Aufzeichnungen, in der mittleren Troposphäre war es das zweitwärmste.

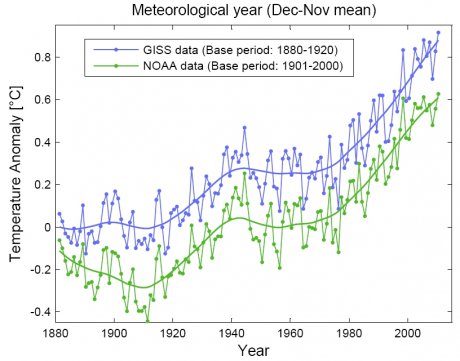

Das meteorologische Jahr läuft von Dezember bis zum folgenden November – von Klimatologen wird es gerne benutzt, damit die Monate eines Winters (Dez-Feb) zusammen bleiben und nicht über zwei Jahre verteilt werden. Nachdem die NOAA gerade die globale Novembertemperatur publiziert hat, sind nun auch fast alle Daten für das meteorologische Jahr 2010 da. Was die bodennahe Lufttemperatur (Stationsdaten) betrifft ist 2010 sowohl bei NASA-GISS als auch bei NOAA das wärmste Jahr seit Beginn der Aufzeichnungen im 19. Jahrhundert (siehe Grafik). Auf Rang 2 liegt in beiden Datensätzen das Jahr 2005. In den NASA-Daten ist der Vorsprung von 2010 so groß, dass sehr wahrscheinlich auch der Dezember daran nichts mehr ändern wird und auch das Kalenderjahr 2010 das wärmste wird. In diesen Daten brachen der April, Juli und November 2010 den Wärmerekord für den entsprechenden Kalendermonat seit 1880.

Die globale Temperatur 1880-2010 in den Daten der NASA (GISS) und der NOAA. Die Kurven sind vertikal versetzt, damit sie sich nicht verdecken (siehe Fußnote zu Basisperioden). Punkte zeigen die Werte für die meteorologischen Jahre, die glatte Kurve den nichtlinearen Trend nach Moore et al. (2005) mit Halbwertsbreite 15 Jahre (siehe Fußnote Glättung).

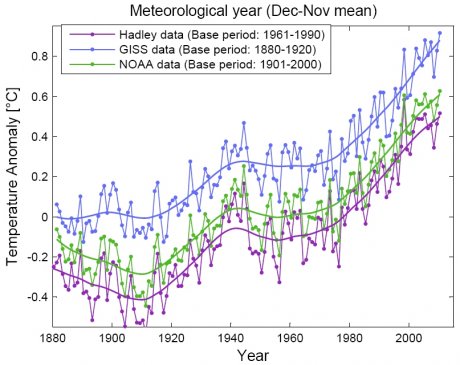

Die Daten des Hadley Center sind noch nicht publiziert – allerdings sind in diesem Datensatz kürzlich Probleme aufgetaucht durch eine veränderte Methode der Messung der Meerestemperaturen, siehe Bericht im New Scientist. Anscheinend hat dieses Problem – neben dem bekannten "Arktisloch" – dazu beigetragen, dass die Hadley-Daten in letzter Zeit eine geringere Erwärmung zeigten als die anderen Datensätze. New Scientist zitiert den Hadley-Forscher John Kennedy mit der Aussage, nach der Beseitigung dieses Problems könnte 2010 auch in den Hadley-Daten das wärmste Jahr werden.

Die beiden Satellitendatensätze von UAH und RSS, die die Temperatur der mittleren Troposphäre (in einigen Kilometern Höhe in der Atmosphäre) messen, zeigen 2010 als zweitwärmstes Jahr knapp hinter 1998. Das liegt aber nicht an einem schwächeren klimatischen Erwärmungstrend in diesen Daten (siehe Tabelle), sondern am Ausnahmejahr 1998. Durch das stärkste bislang verzeichnete El Niño-Ereignis stach 1998 um 0,4 ºC (3 Standardabweichungen) über den Klimatrend hinaus und ist daher nur schwer zu übertreffen. In den bodennahen Temperaturen hat sich der El Niño dagegen bei weitem nicht so stark ausgewirkt (nur ca. 0,2 ºC, siehe Grafik oben).

| Hadley | 0,16 |

| NASA-GISS | 0,18 |

| NOAA | 0,17 |

| UAH | 0,16 |

| RSS | 0,18 |

Lineare Klimatrends über die letzten 30 Jahre (meteorologische Jahre 1981-2010) in den vier genannten Zeitreihen, in Grad pro Dekade.

Die globale Rekordwärme mag denjenigen wundern, der (wie ich) gerade im Schneetreiben bei minus 10 Grad mit den Kindern Schlittenfahren war. Aber es gibt eben nach wie vor Wetterlagen, die polare Kaltluft zu uns bringen – dafür gibt es in Grönland gerade Plus-Temperaturen. Modellrechnungen sprechen sogar dafür, dass solche Wetterlagen durch den Eisschwund in der Barentssee begünstigt werden und daher infolge der Klimaerwärmung häufiger auftreten könnten.

Update 22.12.: Jetzt sind auch die Hadley-Daten da, unten habe ich sie der Grafik hinzugefügt. Mit den oben erwähnten Vorbehalten – Arktisloch und dem noch nicht korrigierten Problem in den Meerestemperaturen. Bei Hadley landet das meteorologische Jahr auf Rang 2 hinter 1998 – teils wegen der genannten Probleme, die in den letzten Jahren zu einer Unterschätzung der Erwärmung führen, teils weil in diesen Daten 1998 besonders warm war. Der Klimatrend über 30 Jahre, den ich oben noch nachgetragen habe, unterscheidet sich aber nicht signifikant von dem der anderen 4 Datensätze.

Update 28.12.: Focus Online hat auch einen ausführlichen Bericht zum Thema.

Anmerkungen

Basisperiode. Da man die absolute globale Temperatur bei weitem nicht so genau bestimmen kann wie Veränderungen derselben, werden üblicherweise die globalen Temperaturen als Veränderung gegenüber einer Vergleichsperiode angegeben. Diese Basisperiode ist willkürlich wählbar. Die GISS-Daten werden relativ zu 1951-1980 publiziert, die NOAA-Daten relativ zu 1901-2000 und die Hadley-Daten relativ zu 1961-1990. Das ändert an den Kurven überhaupt nichts, sondern verschiebt sie nur um einen konstanten Wert. Da ich in Vorträgen die Erwärmung seit Beginn des 20. Jahrhunderts bespreche, zeige ich in Vortragsfolien oft die Temperatur relativ zu 1880-1920, damit man die Erwärmung seit Beginn des 20. Jahrhunderts direkt an der y-Achse ablesen kann. Ich erwähne das nur, weil manche "Klimaskeptiker" dies offenbar für einen finsteren "Trick" halten.

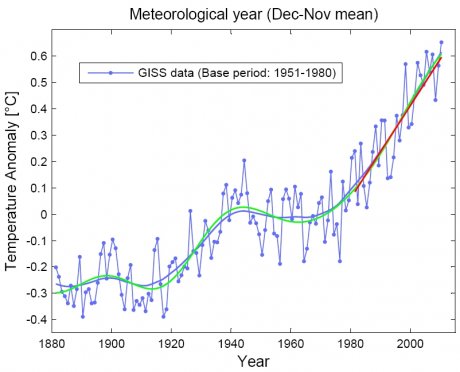

Glättung. Um bei "verrauschten" Zeitreihen die Langzeitentwicklung besser sichtbar zu machen, werden Kurven in der Wissenschaft oft durch Tiefpassfilter geglättet. Dafür gibt es eine ganze Reihe unterschiedlicher Filter, deren Filterperiode und Randbedingungen man je nach Anforderung wählen kann und deren jeweilige Vor- und Nachteile man ausgiebig diskutieren kann – siehe dazu z.B. Mann (2004). Mich interessiert vor allem der klimatologische Trend, bei dem die kurzfristigen natürlichen Schwankungen im Klimasystem (z.B. durch den El Niño-Zyklus) herausgefiltert sind. Die Kurven oben sind mit einem Filter nach Moore et al. (2005) geglättet, der im Wesentlichen einem Dreiecksfilter mit einer Halbwertsbreite von 15 Jahren entspricht. Da ich dazu immer auch die ungeglätteten Ausgangsdaten zeige, bleiben die kurzfristigen Schwankungen natürlich ebenfalls sichtbar. Die Grafik unten zeigt zum Vergleich den adaptiven Filter von Mann (2004) in grün sowie einen simplen linearen Trend (rot) über die letzten 30 Jahre. Auch dies erwähne ich nur, weil zahlreiche "Skeptiker"-Artikel das Kurvenglätten als einen dubiosen "Trick" zu skandalisieren versuchen. Was letztlich nur einmal mehr bestätigt, dass sie offenbar keine ernsthafteren sachlichen Einwände gegen die Ergebnisse der Klimaforschung haben.

Mann, M. E. On smoothing potentially non-stationary climate time series. Geophysical Research Letters 31 (2004).

Moore, J. C., Grinsted, A. & Jevrejeva, S. New Tools for Analyzing Time Series Relationships and Trends. Eos 86, 226,232 (2005).

Erderwärmung und Globale Temperatur

Auch wenn wir als die “Winter-Betroffenen” in Deutschland zur Zeit nicht daran glauben mögen, dass die Erdwärmung unaufhaltsamt fortschreitet, so scheint uns ja die Langzeitstatistik das Gegenteil zu beweisen. Interessant ist in diesem Zusammenhang aber der Artikel “Ein Fünkchen Hoffnung für den Eisbären”, der am 16.12. in Spiegel-Online erschienen ist.

16.12.2010, 13:11 Uhr | Von M. Hamm & Ch. Seidler, Spiegel Online

“global cooling”

Das ist das vorläufige Ende der Diskussion darüber, ob die Klimaerwärmung zu einem Stillstand gekommen sei oder gar von einer Abkühlungsphase abgelöst worden wäre.

Vermutlich werden die Skepticker (notgedrungen) wieder die Vorteile der Klimaerwärmung entdecken.

Global cooling

Wie groß sind denn die Fehler der 30-Jahre-Trends?

@Bleyfuß

“Das ist das vorläufige Ende der Diskussion darüber, ob die Klimaerwärmung zu einem Stillstand gekommen sei oder gar von einer Abkühlungsphase abgelöst worden wäre.”

Im Gegenteil. Die Skeptiker werden einfach bis zum nächsten Rekordjahr behaupten, dass die globalen Temperaturen seit 2010 wieder abnehmen. Nach dem Peak ist vor dem Peak.

[Antwort: Der statistische Fehler der 30-Jahre-Trends beträgt bei den Bodendaten +/- 0.02 Grad pro Dekade, bei den Satellitendaten +/- 0.03. Stefan Rahmstorf]

Temperaturkurve des Met Office

1. Die Temperaturkurve des englischen Met Office zeigt da etwas anderes.

[Antwort: … wie oben diskutiert. Warten wir erstmal ab, bis die korrigierten Hadley-Daten da sind, incl. dem Wert für 2010.]

2. RSS, UAH (die Satellitendaten) und HadCRUT3 (des Met Office) stimmen sehr gut überein. NASA-GISS hingegen hat ein Divergenzproblem.

[Antwort: Da zeigen Sie jetzt eine Grafik für weniger als ein Jahr – wo ist die Aussagekraft?]

3. In Ihren Grafen fehlen die wissenschaftlich üblichen Unsicherheitsbereiche zu den Trendlinien.

[Antwort: Siehe vorigen Kommentar.]

4. Bei einer Trendanalyse über 15 Jahre, wie Sie von Ihnen verwendet wird, wird das Ende der Kurve (der Zeitabschnitt 2004-2010) über eine mathematische Abschätzung verlängert. Ein gleitender Mittelwert – wie er üblicherweise in der Wissenschaft verwendet wird – über 15 Jahre würde im Jahr 2003 enden. (Mittelwert des Zeitabschnittes 1996-2010).

[Antwort: Ein gleitender Mittelwert ist auch ein Tiefpassfilter – nur mit schlechten statistischen Eigenschaften, weshalb man ja bessere Filter entwickelt hat. Stefan Rahmstorf]

@Mario Groß

> 1. Die Temperaturkurve des englischen Met Office zeigt da etwas anderes.

Was zeigt sie denn so viel anderes?

http://woodfortrees.org/…/from:2000/offset:-0.10

Kleine Unterschiede zwischen beiden Datensets gabs schon immer. Außerdem ist es ja auch klar, dass es die gibt, wenn in HadCRUT die gesamte Artkis fast nicht berücksichtigt wird.

> 2. RSS, UAH (die Satellitendaten) und

> HadCRUT3 (des Met Office) stimmen sehr

> gut überein. NASA-GISS hingegen hat

> ein Divergenzproblem.

Gleiches gilt hier. Und wie gesagt ist dein “Divergenzproblem” ziemliches Cherry-Picking. Ich kann dir genauso gut Beispiele raussuchen, wo HadCRUT von den Satellitenmessungen abweicht.

http://woodfortrees.org/…h/from:2008.6/to:2009.5

Die Unterschiede liegen außerdem in der Natur der Sache, wenn man mit verschiedenen Systemen misst und teils verschiedene Gebiete abdeckt.

Sehe ich das richtig dass nur die Abschätzung des Met Office mit den CRU-Daten arbeitet? Wäre interessant wenn ausgerechnet die “Datenfälscher” kältere Temperaturen produzieren.

Wo kann der Normalbürger im Internet die Rohdaten der einzelnen Meßstationen einsehen?

Für einen entsprechenden Link wäre ich dankbar.

[Antwort: Z.B. auf der oben verlinkten Webseite der NASA-GISS. Stefan Rahmstorf]

Sie stimmen überein

When one compares the different global temperature data sets correctly, one result emerges more strongly than any other: that they agree. … And what do all the data sets agree on? Mainly this: global warming.

http://tamino.wordpress.com/…perature-data-sets/

Arktisloch? Genauere Daten der NASA?

Im Artikel wird auf das sog. “Datenloch in der Arktis (Arktisloch)” hingewiesen. Die NASA-Daten sollen diesbezüglich den Daten des englischen Met Office überlegen sein, bzw. genauer sein?

Dazu meine Fragen:

1. NASA-GISTEMP gibt die Temperaturanomalien zum Referenzmittelwert der Jahre 1951-80 an. In der Antarktis z.B. wird aber erst seit Mitte bzw. Ende der 1950er Jahre gemessen. Wie können dort also Temperaturanomalien zu einem Referenzmittelwert angegeben (berechnet) werden, der 1951 beginnt, in einer Zeit in der in der Antarktis noch gar nicht gemessen wurde?

2. Direkt am Nordpol gibt es gar keine Messstationen. Die nächsten Stationen liegen in etwa 1.000 km vom Nordpol entfernt. An den wenigsten wurde im Zeitraum 1951-heute (beginnend mit dem Referenzjahr 1951 bis heute) gemessen. Wie kann man also dort Temperaturanomalien angeben (berechnen)? Wie kommt man darauf, dass diese interpolierten Anomalien (im Arktisloch) genauer sind?

Und noch eine Frage zum wärmsten Jahr nach NASA (GISS) und NOAA.

NASA (GISS) und NOAA haben die gleiche Datenbasis und schicken sich die Daten gegenseitig zu. United States Historical Climatology Network (USHCN) und SCAR (Scientific Committee on Antarctic Research) Daten. Im Grunde handelt es sich also nicht um zwei verschiedene Temperaturreihen, sondern um eine.

[Antwort: Diese Dinge haben wir in den früheren Beiträgen zum Arktisloch diskutiert. Was die Stationen angeht müssen natürlich alle globalen Reihen auf das gleiche Netzwerk der Wetterstationen zurückgreifen, wie die beiden Satellitenreihen auch auf den gleichen Satelliten beruhen. Die Unterschiede liegen in der Auswertung dieser Rohdaten. Stefan Rahmstorf]

@Alex Becker

> Wo kann der Normalbürger im Internet die

> Rohdaten der einzelnen Meßstationen

> einsehen? Für einen entsprechenden Link

> wäre ich dankbar.

http://data.giss.nasa.gov/gistemp/station_data/

@ Beobachter

Der GISS-Link war mir bekannt. Deshalb hatte ich je gefragt wo man die Rohdaten und nicht die homogenisierten Monatsmittelwerte einsehen kann, und zwar für alle Stationen.

Was mich bei GISS wundert ist warum dort sowenig Stationen aufgeführt sind die aktuell noch in Betrieb sind. Auch würde mich interessieren welche Weltregionen in 2010 besonders warm waren. Ich habe bei GISS mal willkürlich gesucht und eigentlich nur die Region im Norden Kanadas und Grönland gefunden. Was habe ich da übersehen?

@Michael Krüger

In der Arktis gibt es lückenlose Messreihen seit den 30er jahren. Die damalige Sowietunion unterhielt paralell bis zu 10 Wetterstationen auf kompakten, alten Eisinseln. Diese Stationen waren ganzjährig bemannt, und die Messreihen sind gut dokumentiert. Das Problem ist, dass die Lokalisation dieser Eisinseln mit der Eisdrift variierte. Die Nasa führt in ihrer Liste nur feste Stationen auf dem Land, das ändert aber nichts an der Tatsache, dass wir weitaus längere Zeitreihen aus der Artktis haben, als aus der Nasa-Liste scheinbar hervorgeht.

Heute existieren diese Eisinseln übrigens nicht mehr.

Einfluß der Sonnenaktivität ?

Die Sonne zeigt nach wie vor (fast) keine Sonnenflecken und es wird interessant, ob unser Zentralgestirn für längere Zeit in dieser Inaktivität verharrt.

http://sohowww.nascom.nasa.gov/…time-images.html

Nachdem 2010 trotzdem das heißeste Jahr seit Beginn der Klimaaufzeichnungen werden wird, spricht vieles dafür, daß die Treibhausgaskonzentration in der Atmosphäre einen sehr starken Einfluß auf die Höhe der globalen Temperatur hat. Sollte die Sonne demnächst wieder an Aktivität deutlich zulegen, könnten wir mit einem bislang nicht gekannten globalen Temperatursprung konfrontiert werden.

Prof. Dr. Vahrenholt von der RWE…

…hat wieder zugeschlagen und sagt aber in der “Welt”, dass die Erwärmung pausiert und die Winter “außergewöhnlich”(!) kalt sind. Ich bin total verwirrt… 😉

Ach, und Sie, Herr Rahmstorf, werden auch erwähnt.

http://www.welt.de/…ten-sich-in-Demut-ueben.html

Ich wünsche frohe Weihnachten und danke Ihnen für die stets interessanten und auch für den angestellten unstudierten IT Sysadmin verständlichen Beiträge in Ihrem Blog in diesem Jahr!

@Folke kelm

So ist es. Das Datenloch in der Arktis bleibt im Datensatz NASA (GISS).

Meine Frage.

Direkt am Nordpol gibt es gar keine Messstationen. Die nächsten Stationen liegen in etwa 1.000 km vom Nordpol entfernt. An den wenigsten wurde im Zeitraum 1951-heute (beginnend mit dem Referenzjahr 1951 bis heute) gemessen. Wie kann man also dort Temperaturanomalien angeben (berechnen)? Wie kommt man darauf, dass diese interpolierten Anomalien (im Arktisloch) genauer sind?

[Antwort: Dort wo man keine Daten hat, muss man per Interpolation abschätzen. Wir haben das damals im Beitrag zum Arktisloch ausführlich diskutiert. Man kann es so wie die NASA machen, dass man davon ausgeht, die Temperaturveränderungen im Nordpolargebiet entsprechen denen am Rande der Arktis, wo es Messstationen gibt. Das macht Sinn, da Temperaturanomalien einen großen Korrelationsradius haben. Oder man macht es so wie das Hadley Center, nimmt also an, die Veränderungen in der Arktis entsprechen denen der globalen Mitteltemperatur. Da kann man ganz schön daneben liegen, weil die Arktis sich – nach allem was wir wissen – deutlich rascher erwärmt als das globale Mittel. Stefan Rahmstorf]

Amoklauf

@c. Schaefer

Prof. Vahrenholt fordert allen Ernstes “Demut”. Man könnte meinen, er hat sich damit im Jahrhundert geirrt.

Glättungsproblem

Herr Rahmstorf,

so pauschal läßt sich die Kritik an der Methode aber auch nicht von der Hand weisen. Um die Glättung bis zum aktuellen Datum zu vollziehen, fehlen eben Daten für die zukünftigen 15 Jahre – diese müssen also irgendwie abgeschätzt werden. Die geglättete Kurve geht also beginnend mit 1994 allmählich und zunehmend in Erwartungshaltungen über, die im gegenwärtigen Verlauf immerhin etwa die Hälfte des Glättungsergebnisses ausmachen.

Ein solcher fließender Übergang von harten Fakten zu wachsenden Vermutungen in einem einzigen Kurvenzug ist – ohne ausdrücklichen Hinweis oder Abgrenzung, gerade bei einer Präsentation vor Laienpublikum – problematisch. Zumal es ja wohl kaum ehrenrührig ist die geglättete Kurve dann enden zu lassen, wenn noch nicht alle benötigten harten Fakten beieinander sind.

welche Messwerten können wir vertrauen ?

Die Probleme bei den Hadley Daten sind bekannt. Bei GISS wird interpoliert – besonders an den Polen.

Die Satellitenmessungen von UAH und RSS sind ebenso nicht flächendeckend.

Hier wird von 70°S bis 82,5°N (?) gemessen.

Wer liefern zur Zeit die zuverlässigsten Daten?

Worauf kann man sich stützen ?

Besonders auffällig sind in den letzten Jahren die besonders hohen Anomalien des Nordpols und die daraus resultierenden Wetterereignisse in Europa.

Doch was ist ist hier Ursache oder Folge? Der Golfstrom dreht ab richtug Grönland. Die Tiefenwasserbildung ist gestoppt. Eine ungewöhnliche Wärme ist ebenso in Südgrönland zu verzeichnen.

Sind es Ereignisse wie El Nino und La Nina in diesem Jahr die dies verursachen ?

Sehr geehrter Herr Rahmstorf,

zunächst einmal vielen Dank für die Einrichtung und den Betrieb dieses Blogs. Ich verfolge diesen nun schon seit vielen Monaten und freue mich auf die kommenden. Eine Frage hat sich in Ihrem letzten Artikel für mich gestellt, vielleicht können Sie diese ja für mich als Nichtwissenschaftler nochmals erläutern?

Sie schreiben:

“…Da man die absolute globale Temperatur bei weitem nicht so genau bestimmen kann wie Veränderungen derselben, werden üblicherweise die globalen Temperaturen als Veränderung gegenüber einer Vergleichsperiode angegeben…:”

Ich dachte bisher immer, dass ich um eine Veränderung zu errechnen, den Anfangs und den Endpunkt kennen muss und dass die Differenz zwischen den beiden Werten eben die Veränderung ist? Mache ich da einen Denkfehler?

[Antwort: So ist es, nur dass als “Anfangspunkt” in der Regel kein einzelnes Jahr genommen wird, sondern der Mittelwert über einen längeren Zeitraum wie 30 Jahre, weil ein solcher Mittelwert als Bezugspunkt genauer ist (kleinere Unsicherheit als beim Wert eines Einzeljahres). Stefan Rahmstorf]