Können Zufallszahlengeneratoren Würfelergebnisse erklären?

BLOG: KlimaLounge

Wie Sie mit zwei Würfeln leicht nachweisen können, dass mit Ihrem Statistikprogramm etwas faul ist – und was das mit der globalen Erwärmung und der Berichterstattung zum IPCC-Bericht zu tun hat.

Sie werfen wiederholt zwei Würfel und betrachten die Summe der beiden Zahlen. So würfeln Sie etwa 7, 4, 9, 3, … Nach einer Weile erhalten sie zwei Einser, also 2. Wow, denken Sie. Das ist eine niedrige Zahl! Ob das wohl mein Statistikprogramm erklären kann?

Machen wir einfach einen Test! Jede Statistiksoftware enthält einen Zufallszahlengenerator, der zufällige Werte zwischen 1 und 6 produzieren kann. Das ist ein Computermodell eines Würfels. Aber funktioniert es richtig?

Kann dieser Wurf das Modell falsifizieren?

Sie machen den Test und lassen sich 100 zufällige „Würfe“ von zwei Würfeln simulieren. Ergebnis: in nur 3% aller Fälle erzeugt Ihr Computer die Zahl 2, aber in 97% aller Fälle ist die simulierte Zahl um mindestens 50% zu hoch! Damit ist mit hoher Signifikanz gezeigt, dass der Zufallszahlengenerator zu hohe Werte liefert. Die beobachtete niedrige Zahl 2 ist inkonsistent mit den Ergebnissen des Zufallszahlengenerators (also dem Würfelmodell im Computer) sogar auf einem 3-prozentigen Konfidenzniveau.

Oder?

Erkennen Sie den Denkfehler?

Es handelt sich um einen der häufigsten Statistikfehler; er ist als „selection bias“ bekannt (siehe z.B. Erklärung bei Wikipedia). Der Denkfehler besteht darin, dass von vornherein gezielt ein seltenes Ereignis ausgewählt wurde (nämlich dass die Würfel nur 2 Punkte zeigen). Dann darf man sich nicht wundern, dass die statistische Analyse zeigt, dass es tatsächlich ein seltenes Ereignis ist und höchstwahrscheinlich nicht das Ergebnis einer Zufallsziehung aus allen möglichen Würfelergebnissen.

Dass 97% aller Zahlen aus dem Zufallsgenerator höher sind als 2 deutet also nicht etwa darauf hin, dass etwas faul ist. Sondern es ist einfach eine Folge dessen, dass der Zufallszahlengenerator korrekt arbeitet.

Klima statt Würfel

Jetzt stellen Sie sich vor Sie sind Klimaforscher und verfolgen seit Jahrzehnten die globale Temperatur, die seit 1980 einen Anstieg von im Mittel 0,16 Grad pro Dekade zeigt1. Sie merken, dass Trends über 15-jährige Zeiträume stark schwanken – mal sind sie größer, mal kleiner. So betrug der Trend 1992-2006 volle 0,29 Grad pro Dekade. Das kümmerte Sie damals nicht weiter – aber als der Trend 1998-2012 dann sehr niedrig ausfällt (0.07 Grad pro Dekade2), denken Sie: wow, so ein niedriger Trend! Ob das die Klimamodelle erklären können? Machen wir wie oben den Test!

Ein solches Papier mit dem Titel Can climate models explain the recent stagnation in global warming? gibt es tatsächlich3 (wenn auch laut den Autoren beim Peer Review einer Fachzeitschrift durchgefallen, aber dafür im Internet und über Spiegel Online ans Laienpublikum gebracht). Es kommt zu dem Schluss:

We find that the continued warming stagnation over fifteen years, from 1998 -2012, is no longer consistent with model projections even at the 2% confidence level.

Der Trugschluss

Dies ist genau der gleiche Trugschluss wie beim Würfel oben. Denn auch der Zeitraum 1998-2012 ist sehr speziell gewählt. Der Trend über diesen Zeitraum wurde gerade deshalb mit Modellergebnissen verglichen, weil er besonders gering ist. Es handelt sich gerade nicht um einen zufällig gezogenen 15-Jahres-Zeitraum, sondern um einen außergewöhnlichen. Und genau das zeigt auch der Vergleich mit den Modellrechnungen – auch in Modellen ist so etwas außergewöhnlich. Das ist kein Hinweis darauf, dass mit den Modellen etwas nicht stimmt – genauso wenig wie beim Zufallszahlengenerator oben.

Nun ist es natürlich völlig legitim, Modellsimulationen mit Daten zu vergleichen und sich über die Unterschiede Gedanken zu machen. Wir haben dies 2007 in einem Paper in Science auch getan (Rahmstorf et al. 2007). Der gemessene Erwärmungstrend über die vorangegangenen 16 Jahre war damals steiler als erwartet, und wir folgerten, dass dies an drei Dingen liegen könnte: interner Variabilität, nicht berücksichtigten Antriebsfaktoren oder Fehler in den Modellen. (Eine vierte Möglichkeit, nämlich Fehler in den Messdaten, vergaßen wir damals – die Problematik der Datenlücken rückte erst 2008 in Bewusstsein – siehe dazu unseren letzten Artikel.)

Von Storchs Manuskript wählt fast die gleichen Worte – mit einem entscheidenden Unterschied: es spricht vom Unterschätzen der internen Variabilität. Das ist der oben aufgezeigte statistische Trugschluss, dass mit den Modellen etwas nicht stimme.

Was ist so besonders an 1998-2012?

Was den Zeitraum 1998-2012 so speziell macht ist dabei vor allem das Anfangsjahr 1998: es ragt von allen Jahren seit 1880 am weitesten über den geglätteten Klimatrend hinaus und folgt auf das stärkste El-Niño-Ereignis seit Beginn der Aufzeichnungen. 1998 ist damit ein extremer Ausreißer, wie er nur einmal in 132 Jahren aufgetreten ist. Man kann nicht erwarten, dass zufällig ausgewählte Zeitsegmente aus Klimamodellen just mit einem solchen Extremjahr beginnen.

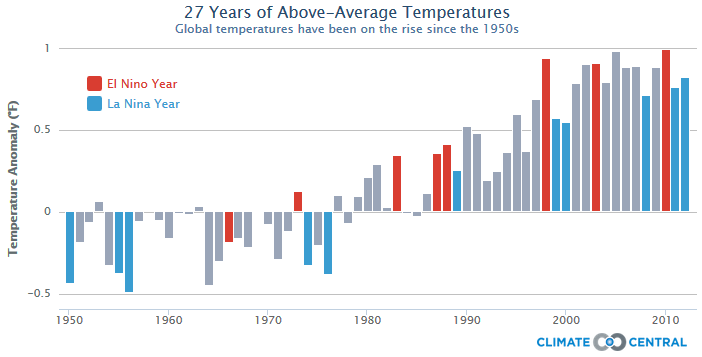

Globale Temperatur (Mittelwert über die drei Datenreihen von NASA, HadCRUT und NOAA) 1950-2012. Rot sind Jahre mit einem El Niño Ereignis hervorgehoben, blau die mit La Niña. Man sieht, dass erstere meist besonders warm und letztere besonders kühl sind.

Lässt man 1998 weg, beträgt der gemessene Trend 1999-2012 bereits wieder unauffällige 0,11 Grad pro Dekade. Wer so kurzen Zeiträumen eine große Bedeutung beimisst, der müsste also konsequenterweise auch argumentieren, seit 1999 sei die „Erwärmungspause“ schon wieder vorbei.

Um den flacheren Trend ab 1998 zu reproduzieren, müsste ein Klimamodell also einen 15-Jahres-Zeitraum mit einem Extrem-El-Niño beginnen und mit anhaltenden La-Niña-Bedingungen enden, während es dabei noch von einem Sonnenmaximum in das tiefste und längste Sonnenminimum seit den 1970ern läuft. Das wäre einfach ein großer Zufall (denn der Wechsel zwischen El Niño und La Niña ist ein stochastischer Prozess, daher die Analogie zum Würfel).

Man erwartet also bei völlig korrekten Modellen genau das erhaltene Ergebnis: nur selten tritt ein so flacher Trend über 15 Jahre auf. Mit einer Falsifizierung der Modelle hat dies schlicht nichts zu tun.

(Nach der Füllung einiger Datenlücken durch Cowtan&Way ist der Trend weniger flach, was dann auch nicht mehr so selten ist – das Klima hat demnach gar nicht zwei Einser gewürfelt sondern etwa eine Eins und eine Zwei. Das ändert aber an der obigen Betrachtung nichts. Es ist nur ein weiterer Grund, in den Trend der letzten 15 Jahre nicht zu viel hineinzudeuten.)

Der politisch-mediale Kontext

Was bringt einen Wissenschaftler dazu, einige Wochen vor dem IPCC-Bericht mit einem von der Fachzeitschrift abgelehnten Manuskript an die Medienöffentlichkeit zu gehen, das mit einem statistisch fadenscheinigen Argument die Gültigkeit aller Klimamodelle infrage stellt? Ein Schelm, wer angesichts diverser Vorgeschichten etwas Böses dabei denkt? Ich halte mich (wie die meisten Kollegen und auch Cowtan&Way) an die gute Regel, eigene Arbeiten nicht öffentlich zu kommentieren, bevor sie in einer Fachzeitschrift publiziert sind. Mit Halbgarem an die Öffenlichkeit zu gehen, das womöglich dann so nie in der Fachliteratur erscheint, beschädigt die Glaubwürdigkeit der Wissenschaft.

Insgesamt ist es sicher kein Zufall, dass ausgerechnet kurz vor Erscheinen des neuen IPCC-Berichts der Topos „Erwärmungspause“ in den Medien hochgekocht ist – ein Dauerbrenner der „Klimaskeptiker“ seit mindestens 2005 (ich habe das z.B. gemeinsam mit dem NASA-Kollegen Gavin Schmidt 2008 schon kommentiert). Eine Medienanalyse zeigt, dass zumindest in den USA rund die Hälfte aller Berichte zum IPCC-Bericht dieses Thema aufgegriffen haben, obwohl es in den Aussagen des IPCC-Berichts eine völlig untergeordnete Rolle spielt.

Der Autor Chris Mooney hat in seinem Aufsatz Who Created the Global Warming “Pause”? untersucht, wie es zu dieser irreführenden Berichterstattung gekommen ist, und schreibt:

How could this disconnect, this huge divergence of narratives, have happened? What follows is the story of a communications failure that is ultimately harmful to all of us. And it was brought on by a combination of causes that, unfortunately, we’ve seen work together before to mar the communication of climate science: Misinformation from climate skeptics, false balance and just plain bad science reporting from much of the media, and to top it all off, poor communication by scientists themselves.

Wegen des genannten Schadens für uns alle kann man nur hoffen, dass die genannten Beteiligten daraus etwas lernen.

p.s. Auf Leserwunsch werden wir in Kürze hier einen kleinen Überblick über die diversen Aspekte bringen, die die kurzfristige Klimaentwicklung der letzten 15 Jahre beeinflussen.

Anmerkungen

(1) In den Links zu Woodfortrees auf „raw data“ klicken um den Trendwert – „slope“ – angezeigt zu bekommen.

(2) Zur Illustration sind hier die Werte aus den GISS-Daten genommen, weil diese von den gängigen Datensätzen dem globalen Mittelwert am nächsten kommen – wie die kürzlich besprochene Analyse von Cowtan&Way bestätigt. Das Grundprinzip ist aber natürlich unabhängig vom gewählten Datensatz. Von Storch et al. kommen zu ihrer 2-Prozent-Aussage mit den HadCRUT4-Daten; mit den GISS-Daten oder den Cowtan&Way-Daten wäre die angebliche “Konfidenz” deutlich geringer.

(3) Ich danke unserem KlimaLounge-Leser Martin Holzherr, der mich kürzlich auf diesen Link aufmerksam gemacht hat.

Fachliteratur

Rahmstorf, S., A. Cazenave, J. A. Church, J. E. Hansen, R. F. Keeling, D. E. Parker, and R. C. J. Somerville. 2007. Recent Climate Observations Compared to Projections. Science 316: 709–709. http://dx.doi.org/10.1126/science.1136843.

Einem kritischen Leser dürfte die fragwürdige Berichterstattung Spiegel Onlines zum Thema der Klimaerwärmung bereits mehrfach aufgefallen sein. Bojanowskis Formulierungen sollten immer mit Bedacht gelesen und kritisch geprüft werden.

Die grundlegende Idee der Ratelehre ist ja stochastische Modelle, inklusive Szenarien, Ensembles und dies auch im Wissen um die Physik (der Würfel ist ein physikalisches Gerät), anzulegen; insofern könnte die Stochastik bestimmte Ergebnisse nahelegen und auf Grund der zu prüfenden Theorie auch i.p. Erklärung (wie Beschreibung – Theorien erklären idR, beschreiben und erlauben die Vorhersage) helfen.

MFG

Dr. W

Können Zufallszahlengeneratoren Würfelergebnisse erklären?

Natürlich. Die Wahrscheinlichkeit mit dem ersten Würfel eine 1 zu würfeln beträgt 1/6. Die Wahrscheinlichkeit mit dem zweiten Würfle eine 1 zu würfeln beträgt ebenfalls 1/6. Die Wahrscheinlichkeit zwei Einsen zu würfeln beträgt also 1/6*1/6=1/36. Selbes gibt der Zufallsgenerator, bei genügend vielen Würfen, aus. Der Zufallsgenerator erklärt also bestens die Würfelergebnisse.

Exactly my point…

“bei genügend vielen Würfen” – “Exactly my point…”

Was wären denn genügend viele Würfe? Oder anders gefragt: Wie könnten gängige Klimamodelle durch Klimadaten widerlegt werden?

Sinnvoll ist dazu ein Vergleich über längere Zeiträume – denn genau dazu macht der IPCC ja seine Projektionen, nämlich zur langfristigen Klimaentwicklung. Solche Vergleiche finden sich in mehreren IPCC-Grafiken, z.B. Abb. 10.1 für die globale Mitteltemperatur. Der IPCC hat noch nie versucht den Klimaverlauf innerhalb von 15 Jahren vorherzusagen, weil der stark durch zufällige interne Schwankungen (wie El Niño) geprägt ist, die man bis heute nicht vorhersagen kann. Der IPCC diskutiert aber in seinem Bericht (Kap. 11) die Fachliteratur zur Vorhersagbarkeit auf solchen Zeitskalen und folgert:

@Stefan Rahmstorf

„ Der IPCC hat noch nie versucht den Klimaverlauf innerhalb von 15 Jahren vorherzusagen.“ Das leuchtet mir ein. Hans von Storch hätte demnach die Klimamodelle auf einem falschen Definitionsniveau untersucht und damit eine Aussage kritisiert, die diese gar nicht machen.

Das statistische Argument im Artikel hat mich dagegen nicht überzeugt. Wenn mein Statistikprogramm hundert Würfe mit Doppelwürfeln simuliert und dabei hundert mal eine Doppeleins produziert, widerlegt das noch nicht automatisch die Hypothese, daß die Würfe rein zufällig erfolgten. Wenn ich oft genug eine Stichprobe von hundert Würfen aus der Grundgesamtheit aller Würfe ziehe, dann wird dieses Ereignis auch irgendwann einmal eintreten. Und das kann, da die Würfe zufällig sind, bereits bei der ersten Stichprobe der Fall sein. Somit stehe ich vor zwei Fragen: Erstens was plausibler ist: daß ein extrem seltenes Ereignis eingetreten ist oder daß meine Ausgangshypothese falsch und die Würfel gezinkt sind. Und zweitens welche Nutzen oder Schäden eine möglichewerweise falsche Entscheidung hätte.

P.S.: Auf das P.S. freue ich mich schon!

In diesen Punkten differieren sowohl Fachleute als auch Laien offenbar. Die Extrempositionen sind: der Klimawandel ist ausreichend verstanden, um einschneidende Maßnahmen zu rechtfertigen; der Klimawandel ist so wenig verstanden, daß Maßnahmen unbegründet sind. Die meisten Positionen liegen wohl irgendwo dazwischen.

Hans von Storch hat anscheinend mit dem kritisierten paper unrecht. Er hat aber, denke ich, recht, wenn er darauf hinweist, daß Klimawissenschaftler ihre Glaubwürdigkeit gefährden, wenn sie ihre wissenschaftliche Arbeit zu sehr mit politischen Forderungen vermischen. Und noch weniger sollte man Menschen, die die angesprochenen Fragen etwas anders beurteilen, die die Solidität klimawissenschaftlicher Prognosen höher oder geringer einschätzen, die Kosten-Nutzen-Relation in die eine oder andere Richtung anders beurteilen als man selbst, moralisch abwerten („Wie ruhig können diejenigen, die sich mit aller Macht gegen Klimaschutzmaßnahmen stemmen, im Angesicht der Bilder aus den Philippinen noch schlafen?“).

Mit den Extremisten beider Lager lohnt es sich nicht zu diskutieren. Die Vernünftigen lassen sich günstigenfalls argumentativ erreichen. Dabei sollte man ihnen dieselbe moralische Integrität zugestehen, die man für sich selbst legitimerweise beanspruchen kann.

Möglicherweise haben Sie die Ironie in meinem Einstieg nicht verstanden? Selbstverständlich widerlegt der Wurf einer zwei nicht das Statistikprogramm, deshalb schreibe ich ja:

“Möglicherweise haben Sie die Ironie in meinem Einstieg nicht verstanden?” Stimmt, mein Fehler. Tut mir leid!

really your point?

1/36 = 2,8 %

so what?

Diese ewige Rosinenpickerei (speziell der 97/98er Startwert) will mir einfach nicht einleuchten – egal wie wohlmeinend ich auch immer den Ausreißer-Meinungsträgern gegenüber stehe. Denn aus meiner Sicht können diejenigen, die mit einem Ausreißerwert starten, auf Dauer nur mit leeren Händen dastehen. Und genau das müssen solche Leute doch auch wissen.

Was machen die denn, wenn irgendwann in den nächsten 5, 10, 20 Jahren bei einer unvermeidlichen Oszillation der Wert mal wieder steil nach oben geht und erneut weit oberhalb des Durchschnitts und auch des Trends liegt? Geht dann jeder von denen, die in den vorlaufenden Jahren mit Schaum vor dem Mund und abseits aller Überlegung herumskandalisiert haben, in Sack und Asche und schreibt dann die Kommentarspalten irgendwelcher Onlineforen mit einem “mea culpa!” voll – analog zu dem, was dieselben Leute ohne jede tragfähige Begründung heute mit diesem “AGW gibts nicht! Und wenn überhaupt, dann hat es 1998 geendet!”-Unfug tun?

Ich bin mir ganz sicher, dass genau dies, ein Zugestehen des eigenen Fehlers in der Vergangenheit, niemals passieren wird.

Die Zufallszahlengeneratoren von Computerprogrammen sind praktisch alle deterministisch.

Echte Zufallszahlen kann die Quantenmechanik erzeugen.

HotBits: Genuine random numbers, generated by radioactive decay:

http://www.fourmilab.ch/hotbits/

@Jürgen Bolt 16. November 2013 16:21

Ich hab den Eindruck, dass selbst eine längere “Erwärmungspause” die prinzipiellen Anahmen in Klimamodellen was die externen forcings betrifft nicht widerlegen muss. Gäbe es so etwas wie Long Term Persistence, also eine Art Memory-Effekt im Klimageschehen, könnten sich Änderungen von externen forcings erst sehr spät bemerkbar machen. Soviel ich weiss gehen die IPCC-Berichte davon aus, dass Long Term Persistence – Effekte im Klima gering sind und nicht über Jahre anhalten. Warum diese Annahme getroffen wurde weiss ich aber nicht.

@Martin Holzherr: das sehe ich genauso.

Hier kann man sich einen Eindruck üner Hans von Storchs Forschungsverständnis machen:

https://resonator-podcast.de/2013/res019-kuestenforscher-hans-von-storch

Recht anstrengend, wenig Fakten, dafür Selbstüberhöhung und unterschwelliges Kollegen-Bashing.

Gut, dass Stefan Rahmstorf hier den „Selection bias“ erwähnt. Dem Problem verwandt ist „Test multiplicity“: wenn man einen statistischen Test an neuen Datenrealisierungen mehrfach wiederholt, dann springt irgendwann einmal auch eine unter der Nullhypothese (H0) erzeugte Realisierung über den Ablehnungsschwellenwert. (Die Anzahl der Drüber-Springer ist im Schnitt gleich dem P-Wert mal der Anzahl der Tests.)

Temperaturtrend-Beispiel: Auswahl des Analyseintervalls (oben schön besprochen). Man sollte hier vielleicht versuchen, die Sensitivität des Ergebnisses (Steigung mit Fehlerbalken) in Abhängigkeit von der Wahl des Intervalls zu bestimmen. Wenn wenig sensitiv: robustes Ergebnis. („Robust“ übrigens im eigentlichen wissenschaftlichen, nämlich statistischen Sinne (George Box) des Wortes.) Die Frage an Phil Jones über die Signifikanz von Temperaturanstiegen über die letzten Jahre legte nicht offen die eigene Motivation des Fragenden, und Phil Jones hätte in seiner Antwort auf den „Selection bias“ hinweisen sollen. [Box 1953 Biometrika 40:318]

Oder: Spektralanalyse einer Paläoklimazeitreihe (z.B. Sauerstoffisotopen als Temperatur- und Eisvolumenindikator) von einem pleistozänen marinen Sedimentkern. Man verwendet einen Test (H0: es gibt keine Peaks im Spektrum, alles ist rotes Rauschen). Wenn man unvoreingenommen schaut, an vielen Frequenzstellen des Spektrums, dann taucht die „Test multiplicity“ auf. Allerdings sind mögliche Kovarianzen der Spektrum-Schätzungen bei unterschiedlichen Frequenzen zu berücksichtigen. Helfen kann man sich dann, indem man den P-Schwellenwert hochsetzt (Einzeltest). Wenn man vor Beginn der Analyse jedoch sich festlegt, nur nach einer Frequenz, beispielsweise die 1/(41 ka) der Erdschiefevariationen, zu sehen, so darf man weicher testen. [Mudelsee 2010 Climate Time Series Analysis, Springer: Kapitel 5]

Weiteres Beispiel: Nichtpublizieren von „negativen Testergebnissen“ oder „langweiligen Befunden“. Das verfälscht die Einschätzung der Signifikanz (auch im Sinne von Bedeutung) des Ergebnisses durch andere: Irreführung, vielen zugestandenermaßen nicht bewusst. [Schooler 2011 Nature 470:437]

Aus meiner Sicht ist „Selection bias“ oder „Test multiplicity“ letztlich eine moralische Herausforderung an die einzelne Wissenschaftlerin: weil es oft möglich ist, die anderen Wissenschaftler (und die Öffentlichkeit) zu täuschen über die Forschungsabsicht, das Weggelassene oder den eigenen Vorwissensstand, ist eine absolute Ehrlichkeit und eine absolute Offenheit zwingend erforderlich. Am besten hat das in meinen Augen Richard Feynman gesagt, in einer auch sehr lustig nachzulesenden Rede (Commencement Address an Caltech-Studierende 1974). Hans von Storch ist sich, da bin ich voller Hoffnung, dieser moralischen Herausforderung bewusst, habe ich doch in einem Blogbeitrag auf der Klimazwiebel 2011 Feynman zitiert. [Feynman 1974 Engineering and Science 37:10]

Manfred Mudelsee (Alfred-Wegener-Institut für Polar- und Meereskunde Bremerhaven; Climate Risk Analysis Hannover)

Heute habe ich mal zwei Fragen.

Erstens: Im Internet fand ich folgenden Text , bei dem mir die 12 unklar ist, können Sie die 12 erklären oder einen Link zur Erklärung setzen?

“wenn die N Daten mit der Standardabweichung s um die Trendgerade mit der Steigung m streuen, so muss diese Ungleichung erfuellt werden: t_N-2,a * s/m kleiner gleich Wurzel [N*(N-2)*(N+1)/12]. Dabei ist t_N-2,a die Quantile der Studentverteilung fuer die Irrtumswahrscheinlichkeit a und dem Freiheitsgrad N-2. Bei den globalen Jahresmitteltemperaturen hat man etwa den anthropogenen Trend m ~ 0,02 K/Jahr bei einer internen Klimavariabilitaet von s ~ 0,2 K/ Jahr zu vergleichen.”

Zweitens zum RF: Mit dem Vorzeichen komme ich nicht klar. Bekannt ist zumindest schon seit Schwarzschild 1906

http://gdz-lucene.tc.sub.uni-goettingen.de/gcs/gcs?&&action=pdf&metsFile=PPN252457811_1906&divID=LOG_0009&pagesize=original&pdfTitlePage=http://gdz.sub.uni-goettingen.de/dms/load/pdftitle/?metsFile=PPN252457811_1906|&targetFileName=PPN252457811_1906_LOG_0009.pdf&

daß nach unten sowohl Temperatur, Aufwärtsstrahlung als auch Abwärtsstrahlung zunehmen und das diese Zunahme um so schneller erfolgt, um so kürzer die Absorptionslänge ist (d.h. um so höher die Treibhausgaskonzentration ist).

Wenn als RF der Unterschied der Abwärtsstrahlung bei gleichbleibender Aufwärtsstrahlung definiert wird, kann das RF nur als Differenz alte Abwärtsstrahlung minus neue Abwärtsstrahlung positiv werden. Versteht man die Änderung der Nettostrahlung als neue Strahlung minus alte Strahlung muß die Differenz negativ sein. Grund:

Die Tropopause soll auf alter Höhe bleiben und auch alles unterhalb der Tropopause soll konstant bleiben – also muß auch die Aufwärtsstrahlung konstant bleiben. Wenn bei höherer Konzentration sich das Verhältnis geometrische Länge zu Absorptionslänge vergrößert und der Beginn immer Abwärtsstralung am TOA immer Null ist, vergrößern sich sowohl Abwärtsstrahlung als auch Aufwärtsstrahlung. Wenn die Aufwärtsstrahlung auf dem alten Wert bleiben soll, dann sinkt zwangsläufig auch die Abwärtsstrahlung.

MfG

Hans von Storchs Schlussfolgerungen aus der “Erwärmungspause” sind schon beeindruckend:

Mich persönlich würde es nicht wundern, wenn es darauf hinausläuft, dass tatsächlich die natürliche Klimavariabilität unterschätzt worden ist. Dass also das Klima mehr schwankt aus sich heraus, als wir das bisher angenommen haben. Das hätte aber eine Reihe von unerfreulichen Konsequenzen, insbesondere was unsere Fähigkeit angeht festzustellen, ob wir tatsächlich einen menschgemachten Antrieb haben, oder ob wir Kapriolen sehen im Klimageschäft, die aufgrund dieser natürlichen Klimavariabilität möglich sind.

(Hervorhebung von mir)

Quelle: http://www.deutschlandfunk.de/definitiv-eine-weniger-starke-erwaermung-als-wir-erwartet.697.de.html?dram:article_id=260930

Pingback:Westantarktis überschreitet den Kipppunkt › KlimaLounge › SciLogs - Wissenschaftsblogs