Debatte im Datenrauschen

BLOG: KlimaLounge

In den letzten Tagen gab es eine internationale Mediendebatte über Klimadaten, die auf mich ziemlich surreal wirkt. Behauptet wurde dort, früher hätten „die Klimadaten“ eine „Pause“ der globalen Erwärmung von 1998-2012 gezeigt, die nun nach einer Datenkorrektur verschwunden sei. Was war passiert?

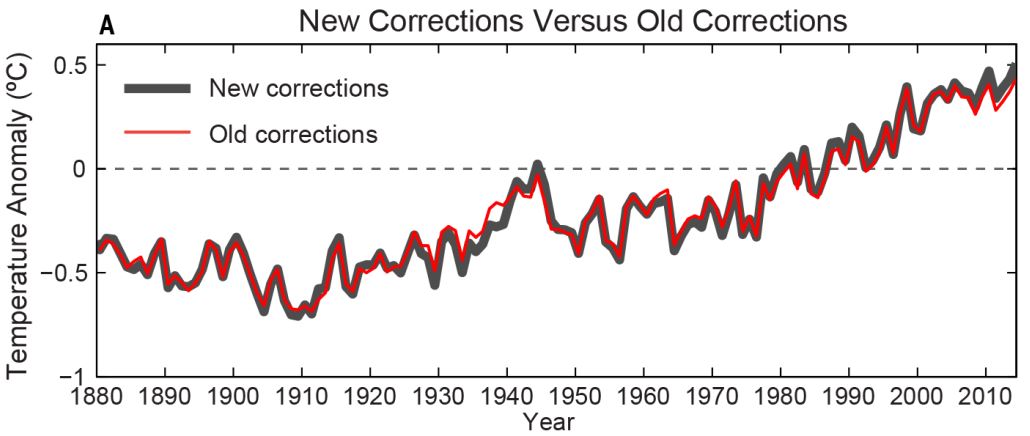

Eines der Datenzentren, die die Daten der globalen Oberflächentemperatur zusammenstellen – die US-amerikanische NOAA – hat in der Fachzeitschrift Science über ein Update ihrer Daten berichtet. Dabei werden Artefakte durch veränderte Messmethoden (insbesondere bei den Meeresoberflächentemperaturen) herauskorrigiert und Daten von bislang nicht enthaltenen Messstationen hinzugefügt. Alle Datenzentren arbeiten kontinuierlich daran, ihre Datenbasis zu verbessern und präsentieren daher gelegentlich Versionsupdates ihrer Datensätze (die NASA-Daten sind derzeit bei Version 3, die des britischen Hadley Center bei Version 4). Daran ist nichts Besonderes, und die Korrekturen bewegen sich im Bereich von einigen Hundertstel Grad – siehe Abb. 1. Es geht hier einfach nur um Details.

Abb. 1 Die NOAA-Daten der globalen Mitteltemperatur (Jahreswerte) in der alten Version (rot) und der neuen Version (schwarz). Aus Karl et al., Science 2015.

Abb. 1 Die NOAA-Daten der globalen Mitteltemperatur (Jahreswerte) in der alten Version (rot) und der neuen Version (schwarz). Aus Karl et al., Science 2015.

Der Aufreger für manche war nun, dass sich in den NOAA-Daten der Trend von 1998-2012 dadurch mehr als verdoppelt hat. Überrascht hat mich das nicht, denn die NOAA-Daten waren bekannt dafür, dass sie von den gängigen Datensätzen in letzter Zeit die geringsten Erwärmungstrends zeigen. Nach der Korrektur liegen die NOAA-Daten nunmehr in der Mitte der anderen Datensätze (siehe Abb. 2). An irgendwelchen relevanten Erkenntnissen der Klimaforschung ändert sich dadurch – nichts.

Abb. 2 Lineare Trends der globalen Temperatur über den Zeitraum 1998-2012 in den Datensätzen verschiedener Institute. Zur Berechnung der Werte wurde der interaktive Trendkalkulator von Kevin Cowtan (Universität York) genutzt; unter diesem Link finden sich auch die Hiweise auf die Datenquellen. Der rote Balken links zeigt den alten NOAA-Wert, der blaue den neuen.

Abb. 2 Lineare Trends der globalen Temperatur über den Zeitraum 1998-2012 in den Datensätzen verschiedener Institute. Zur Berechnung der Werte wurde der interaktive Trendkalkulator von Kevin Cowtan (Universität York) genutzt; unter diesem Link finden sich auch die Hiweise auf die Datenquellen. Der rote Balken links zeigt den alten NOAA-Wert, der blaue den neuen.

Zudem liegt das Ganze innerhalb der Unsicherheitsbalken (ebenfalls in Abb. 2 gezeigt). Diese Unsicherheiten spiegeln die Schwankungen von Jahr zu Jahr wieder, die durch Wetter und Dinge wie das El-Niño-Phänomen verursacht werden – die Daten sind dadurch „verrauscht“, sodass eine Trendbestimmung über kurze Zeitintervalle ziemlich unsicher wird und deutlich von der Wahl des Anfangs- und Endjahres abhängt. Der Zeitraum 1998-2012 ist eine Periode mit besonders geringem Trend, da sie mit dem extrem warmen Jahr 1998 beginnt, das durch den stärksten El Niño seit Beginn der Beobachtungen geprägt war, und mit einem relativ kühlen Jahr endet.

Einige Berichte über die Studie erweckten den Eindruck, der Weltklimarat IPCC habe in seinem letzten Bericht von 2013 eine Pause („hiatus“) der globalen Erwärmung bestätigt, und diese Erkenntnis sei nun umgestürzt. Tatsächlich fokussiert die neue Studie von Karl et al. sich stark auf den Zeitraum 1998-2012, weil diese Periode ausdrücklich im IPCC-Bericht angesprochen war. Allerdings hat der IPCC dazu folgendes geschrieben (Summary for Policy Makers, S. 5):

Due to natural variability, trends based on short records are very sensitive to the beginning and end dates and do not in general reflect long-term climate trends. As one example, the rate of warming over the past 15 years (1998–2012; 0.05 [–0.05 to 0.15] °C per decade), which begins with a strong El Niño, is smaller than the rate calculated since 1951 (1951–2012; 0.12 [0.08 to 0.14] °C per decade).

Der IPCC hat also ausdrücklich darauf hingewiesen, dass der geringere Erwärmungtrend von 1998-2012 kein Hinweis auf eine Veränderung im klimatischen Erwärmungstrend ist, sondern einfach Ausdruck natürlicher Schwankungen. Man beachte auch die vom IPCC angegebenen Unsicherheitsmargen.

Nehmen wir an, in irgendeinem Forschungsfeld gibt es zu einer Sache fünf unterschiedliche Messwerte verschiedener Institute, die etwas streuen aber im Rahmen der bekannten Unsicherheiten übereinstimmen. Ein Institut macht eine kleine Korrektur (klein im Vergleich zu dieser Unsicherheit), sodass ihr neuer Wert nun nicht mehr der niedrigste der fünf Institute ist, sondern in der Mitte liegt. In welchem Forschungsgebiet wäre es denkbar, dass dies nicht eine Fußnote, sondern ein Science-Paper und weltweite Medienberichte wert ist?

Ich habe schon oft darauf hingewiesen: Die ganze Diskussion über die angebliche „Erwärmungspause“ ist eine um Datenrauschen, nicht um ein irgendwie signifikantes Signal. Sie bewegt sich im Rahmen der Datenunsicherheiten und kurzfristigen Wetterschwankungen. Nun gilt zwar der alte Spruch „one man’s noise is another man’s signal“, und dieses „Rauschen“ der natürlichen Schwankungen besser zu verstehen ist eine sinnvolle Forschungsaufgabe. Ich glaube angesichts der Medienberichte allerdings nicht, dass die breite Öffentlichkeit verstanden hat, dass es hier nur um klimatisches „Rauschen“ geht und nicht etwa um für die Klimapolitik relevante Fragen.

Technische Anmerkung: Zur Berechnung der Trends (soweit sie nicht aus dem Paper von Karl et al. stammen) habe ich den interaktiven online Trendkalkulator von Kevin Cowtan verwendet. Will man dort den Trend 1998-2012 (einschließlich) berechnen, muss man als Endddatum 2013 angeben, da der Kalkulatur diesen Wert als 2013,0 versteht, also den Jahreswechsel von 2012 auf 2013. Karl et al. geben (ebenso wie der IPCC) in ihrem Paper 90%-Konfidenzintervalle an, während Cowtan die üblicheren 2-sigma Intervalle berechnet (die bei einer Normalverteilung 95% der Werte umfassen, also breiter sind). Außerdem bilden Karl et al. vor der weiteren Analyse Jahresmittelwerte aus den Monatsdaten, während Cowtan die Trends und Unsicherheiten direkt aus den Monatsdaten berechnet (was ich sauberer finde). Um keine inkonsistenten Konfidenzintervalle zu zeigen (und da die neuen Daten von Karl et al. noch nicht als Monatswerte verfügbar sind) habe ich für die NOAA-Daten keine Intervalle in die Abb. 2 aufgenommen. Ohnehin sind die Intervalle bei allen Datensätzen ähnlich groß, wenn man sie konsistent berechnet. Die in grau gezeigten Langzeittrends unterscheiden sich zwischen den verschiedenen Datensätzen ebenfalls kaum und haben sehr enge Konfidenzintervalle (für 1951-2014 ±0.02 °C pro Dekade).

Weblinks

Mein voriger Beitrag: Keine Pause, nirgends (noch ohne Kenntnis der neuen Studie)

Realclimate: NOAA temperature record updates and the ‘hiatus’

Und die Süddeutsche Zeitung: Pause? Welche Pause?

Sehr geehrter Herr Rahmstorf,

helfen Sie vielleicht ein wenig Ihrem Kommentatorenfreund, der Datenänderungen, wie sie hier seit ca. 2012 dokumentiert sind, es wird sich auf die Daten des Goddard Institute for Space Studies bezogen, seit Längerem zK nimmt, indem Sie erklären, ob dbgl. Datenhistorisierung, das Fachwort, stattfindet und wo ggf. öffentlich dokumentiert, eben auch historische Aggregationen betreffend.

MFG

Dr. W

Lieber “Dr. W.”, ich bin nicht sicher, ob ich die Frage so ganz genau verstehe. Bei den GISS Daten werden (zusätzlich zu den methodischen Updates, die in meinem ersten Absatz oben erwähnt sind) laufend auch verspätet einlaufende Daten eingepflegt. Es werden jeweils ca. zum 15. eines jeden Monats die Daten des Vormonats publiziert, dabei ist es aber häufig so, dass noch nicht alle Länder ihre Messdaten zugemeldet haben. Wenn die dann nachgeliefert werden, ändern sich entsprechend noch die Werte in der GISS-Datentabelle (meist nur um ein oder zwei Hundertstel Grad).

Sehr geehrter Herr Rahmstorf, vielen Dank für Ihre Nachricht, Ihr Kommentatorenfreund hat eine Quelle des Webs beigebracht, die zeigt, dass es auch zu (nachträglichen) Änderungen an den Temperaturdaten des GISS kommen kann, die 10 Punkte und mehr ausmachen.

Insofern war die Frage, ob eine Datenhistorisierung, diese Änderungen [1] meinend stattfindet, und ob diese öffentlich bereit gestellt wird.

MFG

Dr. W (der mittlerweile schon seit Jahren auf den GISS-Daten sitzt und beobachtet)

[1]

Änderungen an den historischen Daten finden auch im Sinne sogenannter Datenhomogenisierung statt, die Rohdaten sozusagen bessernd, hierzu ist keine (ganz sicher nicht: negative) Kritik vorgebracht worden.

Sehr geehrter Herr Rahmstorf,

worauf stützen sich die vorgenommen Korrekturen? Können Sie das kurz erläutern und/oder auf Quellen verweisen, wo das erklärt wird.

Ich frage mich das insbesondere deswegen, weil man zumindest keine unabhängigen Messungen hat an denen man die alten Messungen kalibrieren könnte. Ich würde interessieren, wie man aus den einzelnen Messungen eine Durchschnittstemperatur des gesamten Planeten ableiten kann.

Es gab zahlreiche Medienberichte dazu, die in mehr oder weniger Details die Korrekturen erläutert haben – einfach mal Googeln, ich habe jetzt keinen Überblick, wo das am besten erklärt ist – außer im Originalpaper natürlich, das ja im Artikel verlinkt ist.

In die gleiche Kerbe wie oben beschrieben schlägt der bekannte Klima”experte” Axel “Erwärmungspause” Bojanowski.

Dieser schrieb kürzlich auf spon: “Seit gut 15 Jahren schien der globale Temperaturanstieg gebremst, Forscher sprachen von einer Pause der Erderwärmung. Nun finden Experten Fehler in der Analyse.”

Es wird ebenfalls behauptet, der Klimarat hätte im letzten Sachstandsbericht die Pause konstatiert … und “umso größer sei jetzt die Überraschung”, denn “die angebliche Pause gebe es nicht”.

Zu lesen hier: http://www.spiegel.de/wissenschaft/natur/pause-der-klimaerwaermung-soll-auf-messfehlern-beruhen-a-1037258.html

Wäre es nicht fair gewesen – trotz aller Probleme mit diesen Datensätzen – UAH und RSS mit dazu zu nehmen?

Es geht hier um die oberflächennahen Lufttemperaturen – da haben die Datensätze aus der Troposphäre nichts zu suchen, denn sie messen nicht dasselbe und man kann sie daher nicht vergleichen.

richtig (S.R.), nur sollte der 20a Trend bei RSS und UAH und den Oberflächen Daten konsequenter Weise doch sehr ähnlich sein. Wenn nicht, stimmt was mit den Messungen nicht und es ist unschwer zu erraten, dass Herr Rahmstorf die Fehler dort findet oder sucht, wo der Trend geringer ist. Darauf könnte man wetten… 🙂

Diese Wette würden Sie verlieren. Mit dem Statistiker Grant Foster habe ich vor einigen Jahren in einer Fachpublikation die Oberflächen- und Troposphärentemperaturen verglichen, und es gibt da sehr wohl systematische Unterschiede. Die El Niño peaks im Temperaturverlauf sind in der Troposphäre z.B. rund doppelt so hoch wie am Boden – was plausibel ist, da die warme Luft in den Tropen aufsteigt und sich mit den Hadleyzellen in der Troposphäre in die mittleren Breiten hinein ausbreitet. Wenn Sie also einen Troposphärentrend mit dem Extrem-El-Niño 1998 beginnen lassen, ist der logischerweise geringer als an der Oberfläche – nicht weil irgendwelche Daten falsch sind, sondern weil die Trends tatsächlich unterschiedlich sind.

Im übrigen sind wir hier eine Wissenschaftsseite, wo um die Sache diskutiert wird und nicht mit persönlichen Unterstellungen – dieser Kommentar verstößt gegen unsere Spielregeln. Bitte bleiben Sie künftig sachlich, sonst sind Sie draußen.

“Man beachte auch die vom IPCC angegebenen Unsicherheitsmargen.”

Zeigen dies Unsicherheitsmargen nicht an, dass keiner der Trends signifikant ist?

Richtig, weil Trends über solch kurzen Zeiträume nicht signifikant sind. Siehe das IPCC-Zitat und den zur Signifikanz verlinkten Artikel von mir.

“Richtig, weil Trends über solch kurzen Zeiträume nicht signifikant sind.”

Auch über kurze Zeiträume kann eine Regressionsanalyse doch einen signifikanten Trend ergeben. Etwas anderes ist es, ob man bei der Klimaanalyse einen kurzfristigen Trend für relevant halten will. Das ist doch wohl mehr oder weniger eine Frage der Konvention. Oder gibt die “richtige” Länge der Periode in der Klimaanalyse?

Für den hier in Frage stehenden Zeitraum war der errechnete Trend also nicht signifikant und überdies nicht relevant. Die Nichtrelevanz gilt aber dann doch auch für den von Karl et al. errechneten Trend über die korrigierten Daten. Was man doch von vornherein wissen konnte. Wieso meinte man denn, damit den Hiatus überprüfen zu können?

From Drijfhout et al 2013

The lesson learned from this study is that the climate system is capable of generating large, abrupt climate excursions without externally imposed perturbations. Also, because such episodic events occur spontaneously, they have limited predictability.

Ich schließe mich meinen Vorrednern an und frage mich, weshalb die Satellitendaten nicht so recht zu den “korrigierten” NASA-Daten passen wollen. Selbst bei den HadCRUT-Oberflächendaten ist die Pause noch immer gut erkennbar. Es gibt weitere Ungereimtheiten, die ich in einem Blogbeitrag zusammengefasst habe und die mich hinsichtlich der NOAA-Datenveränderungen stutzig machen:

http://www.kaltesonne.de/news7-8/

@Sebastian Luening

” Selbst bei den HadCRUT-Oberflächendaten ist die Pause noch immer gut erkennbar.”

Die “kalte Sonne” (ein Widerspruch in sich, nicht wahr?) ist tot, mausetot. Jeder Mensch der halbwegs lesen und schreiben kann wird sich im Zeitalter weltweiter Kommunikation durch derlei Lobbyarbeit für die fossile Industrie kaum noch beeindrucken lassen- ich habe für die “kalte Sonne” inzwischen nichtmal mehr ein müdes Grinsen übrig, es langweilt einfach nur noch.

Jenes übliche Lemmingverhalten der fossilen Industrie lässt sich übrigens derzeit auch wunderbar in den USA studieren:

Während Kalifornien, Washington State, Texas, Arizona, im Prinzip der gesamte Südwesten (Getreidegürtel!) der USA aufgrund des Klimawandels austrocknet, Waldbrände in Alska, Kanada, British Columbia ein Inferno verursachen ect ect ect, schiesst sich die republikanische Öl- und Kohlelobby erneut auf Obamas Pläne zur CO2- Reduktion ein. Ist Ihnen eigentlich bekannt, dass ua das World Ressource Institute, die UN, die Weltbank ect damit rechnen, dass bis 2030 45% der Weltbevölkerung nicht genügend Wasser haben wird ?!

Es muss offenbar erst richtig wehtun, bis eine gewisse Klientel endlich aufwacht und erkennt, wo der Hammer hängt- seien Sie versichert:

Es WIRD richtig wehtun.